XAIとCausal AIとは?ブラックボックスAIの限界を超える最新技術

人工知能(AI)の急速な発展は、社会のあらゆる領域で革新をもたらしています。

しかし、ディープラーニングなどの従来のAI技術は、その意思決定プロセスが不透明な「ブラックボックス」として機能することが多く、特に医療、金融、法律などの分野で大きな課題となっています。

そこで注目されているのが、AIの判断根拠を明確にし、透明性を向上させる「Explainable AI(XAI)」と、因果関係に基づいた説明を可能にする「Causal AI」です。

本記事では、XAIの進化と主要技術、Causal AIとの統合、具体的な応用事例、そして今後の展望について詳しく解説します。

Explainable AI(XAI)とは?

Explainable AI(XAI)は、AIがどのように判断を下したのかを、人間が理解できる形で説明する技術の総称です。

近年のAI、特に機械学習やディープラーニング、大規模言語モデル(LLM)によるチャットAIは、高精度な予測や自然な応答を実現していますが、その判断プロセスはブラックボックス化しており、「なぜその結果になったのか?」が分かりにくいという課題があります。

XAIはこの問題を解決し、AIの出力に透明性と説明責任を持たせることで、より信頼性の高いAIシステムの構築を目指します。

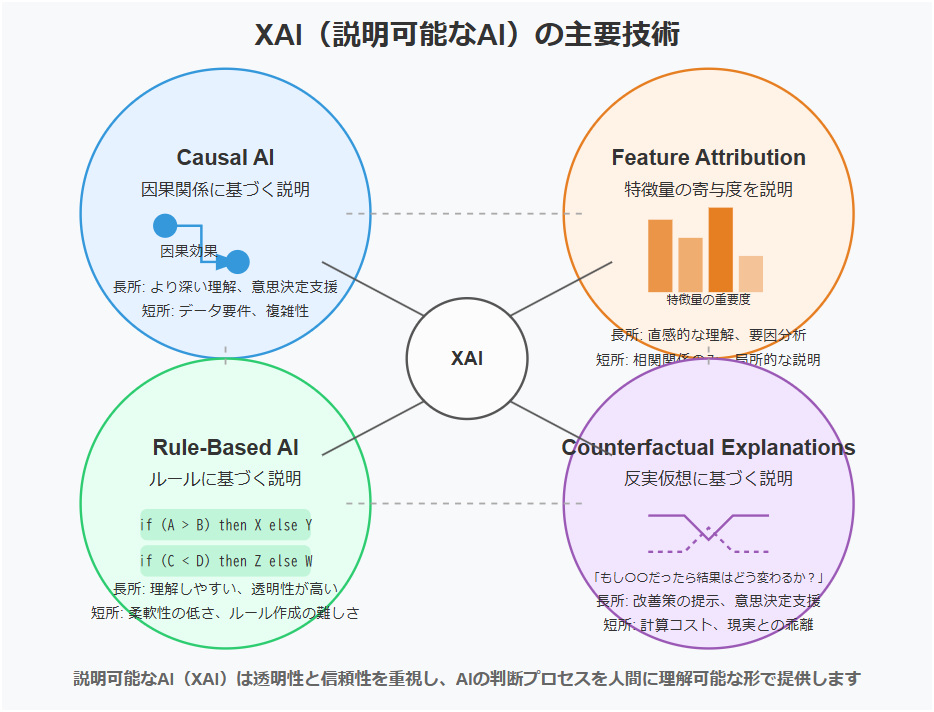

XAIの4つの主要アプローチ

XAIの実現には複数のアプローチが存在しますが、代表的な4つの技術が次のとおりです:

- Causal AI(因果推論)

- Feature Attribution(特徴量の寄与分析)

- Rule-Based AI(ルールベースAI)

- Counterfactual Explanations(反実仮想による説明)

図1では、中央に「XAI」を配置し、放射状に4つの技術を色分けして示しています:

- 青(Causal AI):因果構造を可視化

- オレンジ(Feature Attribution):特徴量の寄与度を表示

- 緑(Rule-Based AI):ルールに基づく判断を提示

- 紫(Counterfactual Explanations):反実仮想による改善案を提示

各技術の特徴や強み・弱みもアイコンや図形で表現されており、XAIの全体像を一目で把握できる構成になっています。

| 技術 | 目的 | 説明方法 | 長所 | 短所 |

| Causal AI | 因果関係に基づく説明 | 介入、反実仮想、因果グラフなど | より深い理解、意思決定支援 | データ要件、複雑性 |

| Feature Attribution | 特徴量の寄与度を説明 | 特徴量の重要度を算出 | 直感的な理解、要因分析 | 相関関係のみ、局所的な説明 |

| Rule-Based AI | ルールに基づく説明 | if-thenルールなど | 理解しやすい、透明性が高い | 柔軟性の低さ、ルール作成の難しさ |

| Counterfactual Explanations | 反実仮想に基づく説明 | シミュレーション | 改善策の提示、意思決定支援 | 計算コスト、現実との乖離 |

XAIの全体像と今後の展望

これら4つの技術は、それぞれ異なる視点からAIの判断を説明しますが、共通の目的は**「人が納得できるAIの判断」**を実現することです。

- ユーザーがAIを信頼しやすくなる

- 説明責任や透明性を確保できる

- 法規制や業務要件にも対応しやすい

実際のユースケースでは、1つの手法だけでなく複数のXAI技術を組み合わせることで、より実用的で柔軟なAI運用が可能になります。

Causal AI(因果AI)とは?

Causal AI(因果AI)は、AIの判断を「相関関係」ではなく「因果関係」に基づいて説明する技術です。

従来のAIモデルでは、「この症状がこの病気と関連している」というような統計的な相関に基づいた予測が一般的でした。しかし、Causal AIでは、「何が何を引き起こすのか」という因果構造に注目し、「なぜこの結果が生じたのか?」「もし別の選択をしていたらどうなっていたか?」といった深い問いに答えることが可能になります。

-

左側は因果グラフの例で、症状A・B、疾患X、治療Y、結果Zの間の因果関係を青い矢印で示しています。

例:疾患Xが症状を引き起こし、治療Yが疾患に作用して結果Zを変化させる。 -

右側では、Causal AIの医療応用プロセスが3ステップで表現されています:

- 「なぜこの薬が効くのか?」という疑問の提示

- 因果モデルによる効果の予測

- 最適な治療法の提案

これにより、Causal AIが単なる予測ツールではなく、意思決定支援の技術であることが伝わります。

技術概要:因果関係を導き出す仕組み

Causal AIは、以下の手法を用いて因果関係を明らかにします:

- 因果グラフ:変数同士の因果関係を可視化

- 介入(Intervention):特定の要因を操作したときの影響を評価

- 反実仮想(Counterfactual):別の選択肢を取った場合の結果を予測

このようなアプローチにより、単なる相関分析を超えた深い理解と、より効果的な意思決定が可能になります。

応用事例:医療における因果推論

医療現場では、「この症状は本当に病気の原因なのか?」「治療法を変えたら結果はどうなるか?」といった因果的な問いが日常的に発生します。

Causal AIは、こうした問いに対して:

- 症状と疾患の因果関係を明らかにし

- 複数の治療法がある場合には、それぞれの因果効果を比較し

- 最適な治療戦略の選択を支援します

従来の相関ベースのAIに比べ、より実用的で信頼できる意思決定支援ツールとしての役割を果たします。

代表的なライブラリと実装例

以下は、実際にCausal AIを実装する際に利用される代表的なツールです:

- DoWhy(Microsoft Research)

因果推論を統計的相関の先に拡張し、透明性の高い「なぜ?」の問いに応えるライブラリ。 - CausalML(Uber)

マーケティングや金融の分野で、施策の効果を因果的に評価するために開発されたライブラリ。ユーザーの行動変容や施策の影響を正確に測定できます。

今後の展望:多分野での活用可能性

Causal AIは、医療だけでなく以下のような分野で活用が進んでいます:

- マーケティング:広告や施策の因果効果の分析

- 金融:リスク評価や融資判断の透明化

- 教育・政策立案:施策の効果検証や改善

「なぜそれが起きたのか?」を説明できるAIは、社会におけるAIの信頼性と透明性を高める鍵となります。

Feature Attribution(特徴寄与)とは?

Feature Attribution(特徴寄与)は、AIがある意思決定を行う際に、どの入力要素がどの程度その判断に影響を与えたのかを定量的に示す手法です。

とくにディープラーニングなどのブラックボックス的なモデルにおいて、その出力の根拠を明確にする「事後的説明」として広く活用されています。

この手法により、ユーザーはAIが「なぜそのような判断を下したのか?」を具体的に理解でき、説明可能なAI(XAI)の中核技術として注目されています。

左側では、ローン審査に関わる特徴量の寄与度を視覚的に表現しています。

- 正の影響要因:年収(+35%)、教育(+20%)、雇用期間(+25%)、年齢(+10%)

- 負の影響要因:借入歴(−15%)、返済履歴(−25%)

オレンジ色のバーがポジティブな要因を、赤色のバーがネガティブな要因を示しており、各特徴量が最終判断に与えた影響をひと目で理解できます。

右側では、ローン審査への活用プロセスを3ステップで示しています:

- 「なぜ審査に落ちたのか?」という疑問の発生

- Feature Attributionによる要因の特定

- ユーザーへの具体的な説明の提供

技術的背景:どのように特徴の影響を評価するのか?

Feature Attributionは、各入力特徴量がAIの出力に与えた「寄与度」を算出します。

これにより、「年収はプラスの影響」「返済履歴はマイナスの影響」といった要因を数値で明示でき、モデルの透明性向上につながります。

応用事例:クレジットスコアリングへの実装

ローン審査などの金融領域では、「なぜ審査に落ちたのか?」というユーザーからの質問に答えることが重要です。

Feature Attributionを使えば、以下のように個別要因を具体的に提示できます:

- 年収が低い

- 雇用期間が短い

- 返済履歴に遅延がある

たとえば、審査に落ちた顧客に対して、AIは各要因の影響度を提示し、自分の信用状況を客観的に理解しやすくなります。

代表的な技術:SHAPとLIME

Feature Attributionを実現する代表的なアルゴリズムとして、以下の2つが広く使われています:

SHAP(Shapley Additive Explanations)

ゲーム理論に基づき、各特徴量がAIの出力に与えた寄与度を公平に評価する手法。正確性と理論的妥当性に優れる。

LIME(Local Interpretable Model-agnostic Explanations)

モデル非依存の局所的な説明を生成し、どのAIモデルにも適用可能。直感的な可視化が強み。

Rule-Based AI(ルールベースAI)とは?

Rule-Based AI(ルールベースAI)は、明確に定義されたif-thenルールに基づいてAIが意思決定を行うアプローチです。

人間が解釈しやすい形で推論の過程を可視化できるため、透明性と説明可能性に優れた手法として、医療や法務など説明責任が重視される分野で広く活用されています。

図4では、ルールベースAIを用いた診断ロジックが2つの視点で表現されています。

- 左側は、質問に沿って診断が進む「決定木モデル」。

例:熱が38℃以上 → 喉の痛み → インフルエンザの可能性 - 右側は、ルールベース診断の3ステップ:

❶ 明確なルールの定義

❷ ルールに基づいた診断

❸ 医師・患者への分かりやすい説明

このように、ルールベースAIは診断の根拠をそのまま提示でき、直感的に理解しやすいのが特徴です。

技術の仕組み:決定木による推論

ルールベースAIは、if-thenルールの集合で知識を構成し、判断を行います。

中でも決定木(Decision Tree)は代表的なモデルで、yes/noの条件分岐をたどることで判断の流れを追跡できます。

たとえば:

「熱が38℃以上」→「喉の痛みあり」→「インフルエンザの可能性が高い」

といったように、判断の根拠を明示的に可視化できます。

応用事例:医療診断AIにおけるルールベースの活用

医療現場では、診断結果の説明が欠かせません。

ルールベースAIは、「どのルールが適用されたか」をそのまま提示できるため、医師の説明や患者の理解を助けるツールとして有効です。

また、これらのルールは専門家の知識を反映して設計できるため、判断の妥当性や信頼性も高めることができます。

代表技術

- 決定木(Decision Tree): if-thenルールによる分類モデル。条件分岐の連続により複雑な判断を可視化でき、機械学習によって自動的に生成することも、専門家の知識をもとに手動で設計することも可能です。

- ファジーロジック(Fuzzy Logic): 連続的なデータを用いたルールベース推論。「高熱」や「軽度の痛み」といった曖昧な概念を数値的に扱えるため、より人間の直感に近い推論が可能になります。

課題と今後の展望:ハイブリッドAIの可能性

ルールベースAIは透明性に優れていますが、以下のような課題もあります:

- ルール設計に手間がかかる

- 柔軟性が低く、複雑な状況への対応が難しい

- メンテナンスが大変

そのため、最近ではディープラーニングとルールベースAIを組み合わせた「ハイブリッド型AI」の研究が進んでいます。これにより、「高度な学習能力」と「分かりやすい説明力」の両立を目指しています。

Counterfactual Explanations(反実仮想説明)とは?

Counterfactual Explanations(反実仮想説明)とは、AIの出した結果に対して、「もし入力条件が少し違っていたら、結果はどう変わったか?」をシミュレーションする説明手法です。

単に「なぜこの結果になったのか?」を説明するのではなく、「どうすれば望ましい結果に変えられるか?」という視点で、ユーザーにとって実用的な改善のヒントを提供する点が最大の特長です。

反実仮想

反実仮想とは、「もし過去の出来事が異なっていたら、結果はどうなっていたか?」を考える思考実験です。たとえば、「もしあの時、別の道を選んでいたら、今の私はどうなっていたか?」といった問いが該当します。AI分野では、反実仮想を用いて、AIの判断根拠の説明や、より良い結果を得るための改善策を検討します。

図5では、ローン審査における反実仮想の例を示しています。

- 実際の結果:年収350万円、信用スコア620 → 否決

- 反実仮想の例:年収を400万円に変更、または信用スコアを680に上げる → 承認

このように、どの要素をどう変えれば結果が改善されるかを視覚的に示します。

右側では、自動車ローン審査での活用プロセスを3ステップで表現:

- 審査結果の説明

- 反実仮想による改善案の提示

- 行動につながるアドバイスの提供

特徴とメリット

反実仮想説明は、以下の点で強みを発揮します:

- 「なぜこうなったか」だけでなく、「どうすれば変えられるか」を示す

- ユーザーが具体的な行動目標を持ちやすくなる

- 金融機関などが審査基準を透明に説明しやすくなる

応用事例:自動車ローン審査

例えば、ローン審査に落ちたユーザーに対し、AIが以下のように改善提案を行います:

- 「年収があと50万円高ければ承認されていた可能性があります」

- 「信用スコアを60ポイント改善すれば通過できる見込みです」

このような行動可能なフィードバックにより、ユーザーは次の一手を明確にできます。

また、金融機関側にとっても、AIによる判断がブラックボックスにならず、審査基準の透明性を保ちつつ顧客との信頼関係を構築できる利点があります。

代表的な技術とフレームワーク

- RecourseML: ユーザーがAIの判断を理解し、改善策を提案するシステム。最小限の変更で結果を変えるための最適な「recourse(救済策)」を計算し、ユーザーに提示します。

- DiCE (Diverse Counterfactual Explanations): 多様な反実仮想シナリオを生成するフレームワーク。単一の改善策ではなく、複数の選択肢をユーザーに提示することができます。

また、他のXAI技術と組み合わせることで、AIの透明性と信頼性をさらに高めることができます。

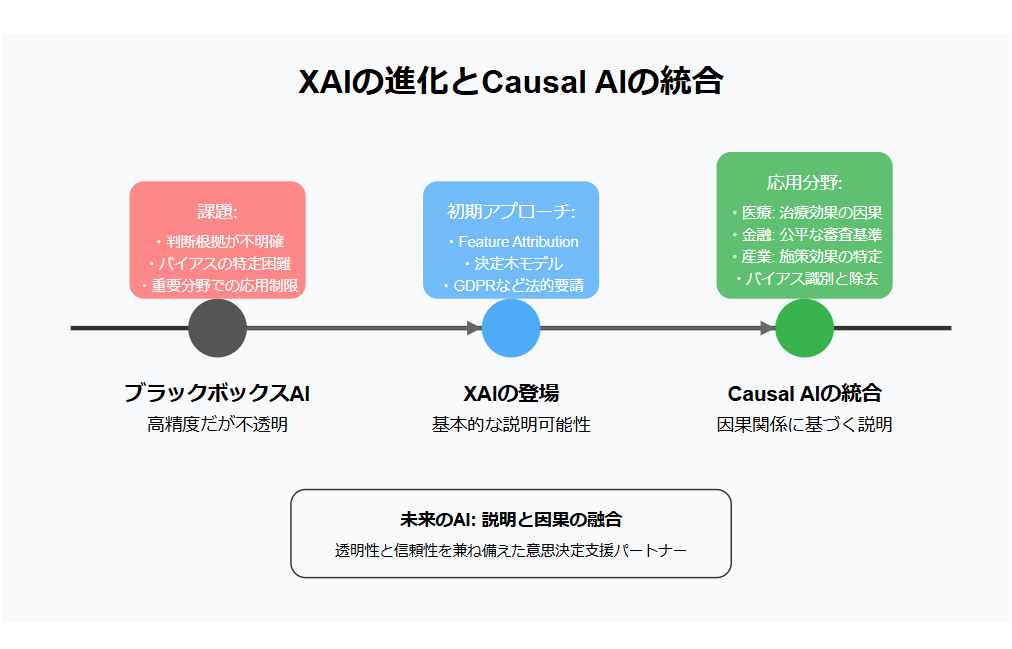

XAIの進化過程とCausal AIの統合

以下の図のようにAIの説明可能性は3つの主要な段階を経て進化してきました。

ブラックボックスAI(初期段階)

初期のAIは高い予測精度を持っていましたが、判断の根拠が不透明(ブラックボックス)という課題を抱えていました。

その結果、以下のような問題が生じました:

- なぜその判断に至ったのか分からない

- バイアスや誤判断の原因を特定できない

- 医療や金融など説明が求められる分野での活用が難しい

XAIの登場(第二段階)

AIの社会実装が進む中で、「AIが説明できること」が重要視されるようになり、XAI(説明可能なAI)の技術が登場しました。

- Feature Attributionや決定木モデルなど、特徴量の可視化による説明技術が発展

- GDPRなどの法的要請により「説明を受ける権利」も明確化

ただし、この段階では相関ベースの説明が中心で、因果関係の理解には限界がありました。

Causal AIの統合(現在)

現在では、XAIの中に**Causal AI(因果推論)**が統合され、説明の精度と実用性が大きく向上しています。

- 医療:個別の治療効果を因果的に分析 → 個別化医療の実現

- 金融:バイアスを考慮した公正な審査が可能に

- 産業:因果関係に基づいた戦略立案や改善策の提案が可能に

Causal AIは、データのバイアスや交絡因子も考慮できるため、より信頼性の高いAI構築に貢献しています。

交絡因子とは

交絡因子は、調査対象の二つの事柄両方と関連し、見かけ上の関係性を生み出す第三の要素です。たとえば、コーヒー摂取と心臓病のリスクを調査する際、喫煙は両方に関連する交絡因子となり得ます。交絡因子を考慮しないと、誤った結論に至る可能性があります。

XAIの具体的な活用事例:産業別に見る実装と効果

XAI(説明可能なAI)は、さまざまな業界で判断根拠の可視化や透明性の確保に貢献しています。

🏥 IBM Watson Health|医療AI:診断と治療の根拠提示

- 概要:医療データに基づき、AIが診断や治療提案を行う際に、その根拠やプロセスを医師に説明。

- 活用効果:医師の意思決定を支援し、患者への説明も明確に。

- 特徴:Causal AIとルールベース説明の活用による信頼性の高い診断支援。

🧬 DeepMind – AlphaFold|ライフサイエンス:タンパク質構造の説明可能な予測

- 概要:AIがタンパク質の3次元構造を予測し、その構造的根拠や因果的パターンを可視化。

- 活用効果:創薬や疾患理解を加速。科学的根拠に基づく説明が可能に。

- 特徴:高精度予測と透明性の両立。研究者にも信頼されるAI。

💳 Explainable AI in Credit Risk Management – ResearchGate

金融:信用スコアの説明と納得感

- 概要:AIによるクレジットスコアの算出に対し、LIMEとSHAPを用いて個別・全体の影響要因を可視化し、スコアの根拠を明示。モデルの判断過程を理解可能にする。

- 活用効果:ユーザーは自身の信用スコアの要因を把握しやすくなり、改善行動に活かせる。金融機関も説明責任を果たし、信頼性や規制対応の向上が期待できる。

- 特徴:LIMEとSHAPというモデル非依存のXAI手法を用い、Lending Clubのデータで実証。XGBoostなど複数モデルに対し、実例を通じて説明の比較・分析を実施している。

XAIは、今後ますます進化し、透明性・納得感・信頼性を兼ね備えたAIとして、医療・金融・産業などの重要領域で人間の意思決定を支える存在となっていくでしょう。

Causal AIとの連携により、「なぜ?」「どうすれば?」に答えるAIが、社会課題解決にも貢献していくと期待されています。

まとめ:信頼されるAIへ向けた進化

XAI(説明可能なAI)とCausal AI(因果推論AI)は、AIの判断根拠を明らかにし、透明性と信頼性を高める中核技術として急速に進化しています。

医療、金融、製造などの分野では、AIが出す判断を「なぜそうなるのか」と説明できることが、実用化の鍵となりつつあります。

今後は、法規制(例:GDPRやEU AI法案)に加え、自己説明型AI(Self-Explaining AI)の発展によって、ユーザーにリアルタイムで分かりやすい説明を提供する仕組みが主流になると考えられます。

また、最近ではAutoXAI(自動説明生成)という概念も登場し、AIモデル自身が自律的に最適な説明形式を選び、提示する研究も進んでいます。これにより、専門家でなくてもAIの判断を直感的に理解できる世界が見えてきました。

最終的に、XAIとCausal AIは、AIを単なるツールではなく、人間と協働する信頼できるパートナーへと進化させる基盤となるでしょう。

参照サイト

- DoWhy(Microsoft Research): DoWhyの公式ドキュメント。因果推論の概念やDoWhyの使い方について詳しく解説されています。

- CausalML(Uber): CausalMLのGitHubリポジトリ。CausalMLの概要や使い方、サンプルコードなどが掲載されています。

- SHAP(Shapley Additive Explanations): SHAPのGitHubリポジトリ。SHAPの理論や使い方、可視化例などが掲載されています。

- LIME(Local Interpretable Model-agnostic Explanations): LIMEのGitHubリポジトリ。LIMEの概要や使い方、サンプルコードなどが掲載されています。

- IBM Watson Health: IBM Watson Healthの公式サイト。AIを活用した医療ソリューションについて紹介されています。

- Google DeepMind’s AlphaFold: Google DeepMindのAlphaFoldに関するページ。タンパク質構造予測AIであるAlphaFoldについて詳しく解説されています。

- FICO Explainable AI: FICO Explainable AIの公式サイト。AIを活用した信用スコアリングについて紹介されています。

以上

ケニー狩野(中小企業診断士、PMP、ITコーディネータ)

キヤノン(株)でアーキテクト、プロマネとして多数のプロジェクトをリード。

現在、株式会社ベーネテック代表、株式会社アープ取締役、一般社団法人Society 5.0振興協会評議員ブロックチェーン導入評価委員長。

これまでの知見を活かしブロックチェーンや人工知能技術の推進に従事。趣味はダイビングと囲碁。

2018年「リアル・イノベーション・マインド」を出版。

の詳細.png)

.png)

.png)

.png)