※本記事は継続的に最新情報へアップデートしています。

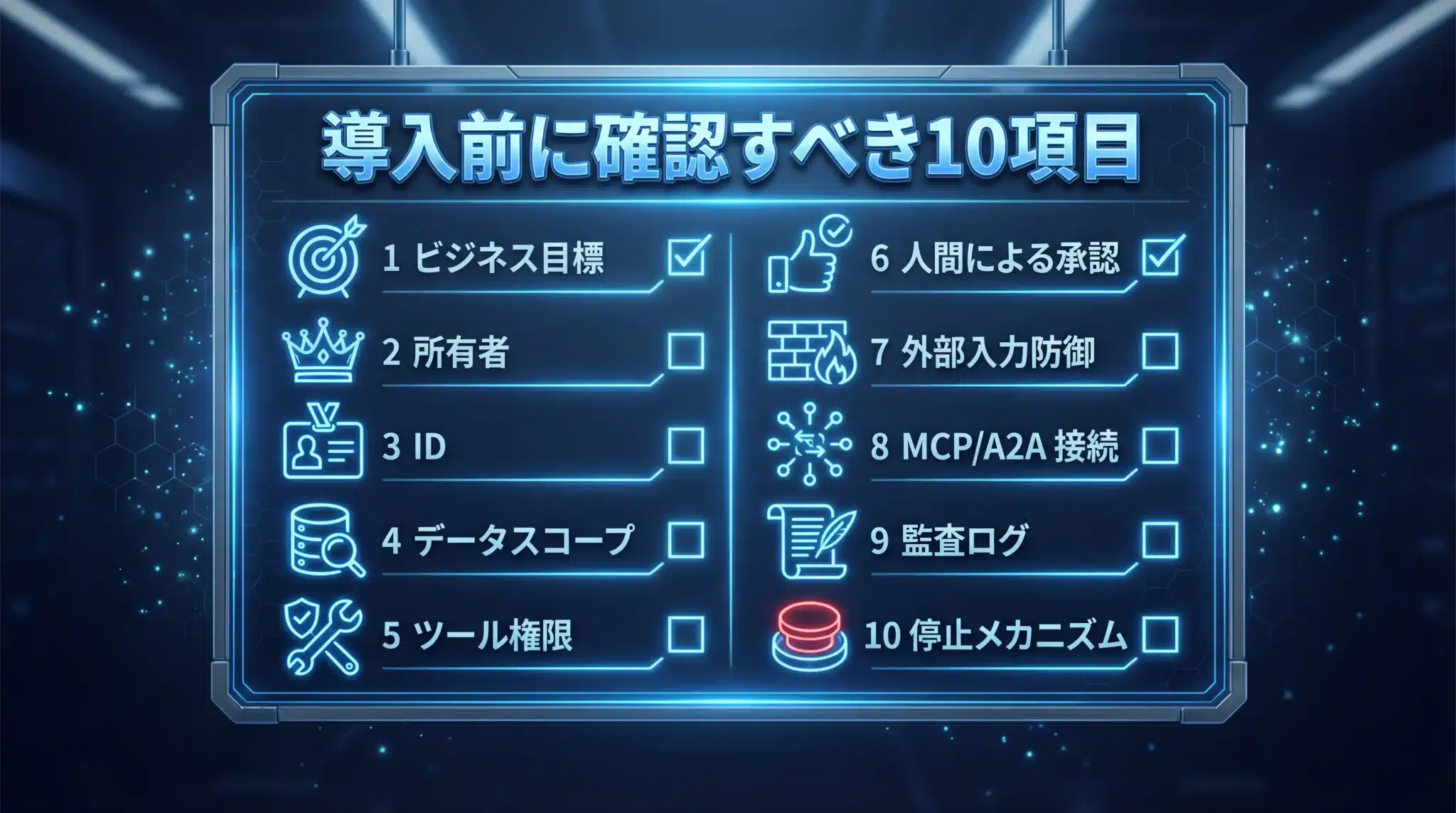

AIエージェント導入チェックリスト|経営者・CTO・情シス・現場責任者が確認すべき10項目

AIエージェントを本番導入できる企業とは、ベンチマーク結果を語れる企業ではない。どの業務をどこまで任せ、どこで止め、誰が責任を取るかを導入前に決め切れる企業である。AIがMCPでSaaSや社内システムに接続し、A2Aで他エージェントと連携する時代、PoC環境で「よく動いた」こと自体は、本番導入の根拠にならない。本記事では、AIエージェントを安全に導入するために、本番導入前にこれだけは確認したい10項目を、経営者・CTO・情シス・現場責任者向けの実務チェックリストとして整理する。

✅ 先に結論

- 結論:AIエージェント導入前には、業務目的・専用ID・データ範囲・ツール権限・人間承認・監査ログ・停止手段を必ず確認する

- 判断軸:PoCで「便利だったか」ではなく、本番環境で「説明できるか」「止められるか」「責任分界を示せるか」で判断する

- 注意点:広い権限のまま本番接続すると、AIエージェントは「新入社員の見た目で過大な権限を握る業務アカウント」と化す

何を確認するチェックリストなのか

AIエージェント導入チェックリストとは、PoCを本番導入に進めてよいかを判断するための経営・技術・運用の確認表である。

AIエージェント導入チェックリストとは、PoCを本番導入に進めてよいかを判断するための経営・技術・運用の確認表である。

ある製造業の企業で、AIエージェントのPoCが成功したとします。営業部門では資料作成が速くなり、カスタマーサポートでは一次対応の品質も改善する。社内からは「これは使える」という声が上がります。経営会議では、本番導入の話が始まります。

しかし、CISOが静かに問いかけます。

「このAIは、どのデータまで読めるのか」

「誰の権限で外部ツールを使うのか」

「誤って顧客データを送信しそうになったとき、誰が止めるのか」

その瞬間、会議室の空気が変わります。PoCの成功は、本番導入の許可証ではなかったのです。

ここに答えられないPoCは、どれほど便利でも本番導入には進めません。AIエージェントの導入判断は、性能評価だけではなく、統制できるかどうかで決まります。

第1回では、AIエージェントセキュリティとは何かを整理しました。第2回では、プロンプトインジェクション2.0として「見えない命令」の脅威を扱いました。第3回では、AIエージェントのゼロトラスト設計として、ID・権限・監査ログの考え方を整理しました。

第4回となる本記事では、それらを実務で使える導入前チェックリストに落とし込みます。

定義

AIエージェント導入チェックリストとは、AIエージェントを本番環境に接続する前に、業務目的・データ範囲・権限・承認・監査・停止手段を確認し、導入可否を判断するための実務フレームである。

なぜ今チェックリストが必要なのか

AIエージェント導入は、便利さが見えた瞬間に本番へ進めたくなる。だからこそ、導入前に立ち止まって確認する仕組みが必要である。

AIエージェント導入は、便利さが見えた瞬間に本番へ進めたくなる。だからこそ、導入前に立ち止まって確認する仕組みが必要である。

AIエージェント導入の事故は、AIが「動かなかった」ときに起きるのではありません。正規の権限で、想定外に動いてしまったときに起きます。

従来のチャットAIは、間違えても言葉で間違えるだけでした。AIエージェントは、データを読み、ツールを使い、他のエージェントと連携し、業務フローの一部を進めます。だから、間違いはそのまま外部送信、誤更新、権限濫用、監査の機能不全として現れます。

問題は、AIが間違えることそのものではありません。間違えたAIが、正規の権限で堂々と動き続けてしまうことです。

PoCの成功が、最大の落とし穴になる

AIエージェント導入で最も危ない瞬間は、PoCが失敗したときではありません。むしろ、成功したときです。

PoCでは、便利さを確認するために広いデータアクセスを許し、複数のSaaSを接続し、権限を広めに与えがちです。その結果、AIはよく動きます。経営層も現場も「これは使える」と感じます。

しかし、そのPoC設計を本番に持ち込むと、AIエージェントは一気にリスク要因になります。OWASP Top 10 for Agentic Applications 2026が指摘するTool Misuse and ExploitationやIdentity and Privilege Abuseは、まさにこのパターンから生まれます。

ここがポイント

PoCは「AIが動くか」を見る場ではなく、「本番に出しても危なくないか」を見る場である。便利さの確認だけでなく、権限・承認・ログ・停止手段まで検証する必要がある。

一次情報が示す方向性

NIST AI RMFは、AIリスク管理をGOVERN、MAP、MEASURE、MANAGEの4機能で整理しています。

本記事の10項目に当てはめると、業務目的・所有者・専用ID・停止手段はGOVERN、データ範囲とツール権限はMAP/MEASURE、監査ログと運用レビューはMANAGEに相当します。

NIST SP 800-207のゼロトラストは、防御の中心を静的なネットワーク境界から、ユーザー・資産・リソースへ移す発想を示しています。AIエージェントに当てはめるなら、「AIがどこからアクセスしたか」ではなく、「AIが誰として、何に、どの権限でアクセスしたか」を見るべきだということです。

OWASP Top 10 for Agentic Applications 2026は、Agent Goal Hijack、Tool Misuse and Exploitation、Identity and Privilege Abuse、Insecure Inter-Agent Communication、Rogue Agentsなど、AIエージェント特有のリスクを整理しています。

本記事のチェックリストでは、業務目的と外部入力対策でGoal Hijackを、ツール権限とMCP/A2A接続でTool MisuseとPrivilege Abuseを、監査ログと停止手段でRogue Agentsのリスクを抑え込む設計になっています。

つまり、AIエージェント導入チェックリストは、単なる社内確認表ではありません。NIST、OWASP、CISAなどの一次情報で示されるリスク管理の考え方を、企業の現場向けに翻訳したものです。

導入前に確認すべき10項目

AIエージェントを本番導入する前に、最低限10項目を確認する。目的・ID・データ・権限・承認・ログ・停止手段が曖昧なら、まだ本番に出してはいけない。

AIエージェントを本番導入する前に、最低限10項目を確認する。目的・ID・データ・権限・承認・ログ・停止手段が曖昧なら、まだ本番に出してはいけない。

以下の10項目は、AIエージェントを本番環境に接続する前に確認すべき基本チェックリストです。

| No | 確認項目 | 確認すること | 未確認の場合のリスク |

|---|---|---|---|

| 1 | 業務目的 | AIエージェントが何の業務を支援するのかを明文化する | AIが「何でも引き受ける汎用ツール」化し、誰も全体像を説明できなくなる |

| 2 | 所有者・責任者 | 業務オーナー、技術責任者、運用責任者を決める | 事故時に誰が判断するか分からない |

| 3 | 専用ID | 人間アカウントではなくAI専用IDで動かす | 操作主体が追跡できない |

| 4 | データ範囲 | AIが読めるデータ、読めないデータを分類する | 事故時の影響範囲が、最初から「全社」になる |

| 5 | ツール権限 | 読み取り、下書き、更新、削除、送信を分けて許可する | 誤実行、外部送信、Tool Misuse |

| 6 | 人間承認 | 外部送信、支払い、契約、削除などを承認必須にする | 重要操作がAIだけで完結し、人間が止める入口がない |

| 7 | 外部入力対策 | メール、Web、PDF、MCP、A2Aからの入力を命令として扱わせない | 間接プロンプトインジェクション |

| 8 | MCP/A2A接続 | 外部ツール、外部エージェント、委任先を検証する | サプライチェーン汚染、なりすまし、文脈汚染 |

| 9 | 監査ログ | 入力、参照データ、判断、ツール実行、承認、出力を記録する | 原因追跡・説明責任が果たせない |

| 10 | 停止手段・運用レビュー | 異常時の停止手段と、権限棚卸しの頻度を決める | 被害拡大、権限肥大化、運用の形骸化 |

1. 業務目的:AIに何を任せるのか

最初に決めるべきことは、AIエージェントの業務目的です。

「営業を支援する」「問い合わせ対応を効率化する」だけでは不十分です。どの業務プロセスの、どの範囲までをAIに任せるのかを明文化する必要があります。

- 問い合わせ内容の分類まで任せる

- 回答案の作成まで任せる

- 顧客への送信は人間が行う

- 契約条件の変更提案はAIに任せない

このように、AIに任せる範囲と任せない範囲を分けます。目的が曖昧なAIエージェントは、やがて何でも引き受ける汎用ツールと化し、権限も責任も膨張していきます。

2. 所有者・責任者:誰が運用責任を担うのか

AIエージェントには、所有者が必要です。

誰が業務要件を決めるのか。誰が権限を承認するのか。誰がログを見るのか。誰が異常時に止めるのか。これを決めないまま導入すると、事故時に責任の空白が生まれます。

| 役割 | 主な責任 |

|---|---|

| 業務オーナー | AIに任せる業務範囲、承認ルール、例外処理を決める |

| 技術責任者 | アーキテクチャ、MCP/A2A接続、ログ設計、セキュリティ実装を管理する |

| 運用責任者 | 日次・週次の監視、権限棚卸し、異常時対応を行う |

| 承認者 | 外部送信、支払い、契約、削除などの重要操作を承認する |

3. 専用ID:人間アカウントで動かさない

AIエージェントを人間のアカウントで動かしてはいけません。

人間アカウントを使うと、ログ上は人間が操作したように見えます。AIが判断したのか、人間が判断したのかが分からなくなります。これは監査上、非常に大きな問題です。

AIエージェントには、人間から独立したマシン・アイデンティティを付与します。単なる表示名ではなく、MCP接続時の認証鍵、A2A連携時の署名、ツール実行ログと紐づけることで、「どのエージェントが、どの権限で、どの操作を行ったのか」を追跡できるようにします。

実務ポイント

AIエージェントIDは、社員番号のように管理する。誰が所有し、何の業務に使い、どのデータとツールにアクセスできるのかを台帳化する。

4. データ範囲:AIに「全部読める」を許さない

AIの精度を上げるために、データを広く読ませたくなる場面があります。しかし、全社データを読めるAIは、事故時の影響範囲も全社になります。

データは、最低限次のように分類してください。

| 分類 | 例 | AI利用の考え方 |

|---|---|---|

| 公開情報 | Web公開済み資料、公開FAQ | 利用可能。ただし出典確認を行う |

| 社内情報 | 社内マニュアル、業務手順書 | 対象部門・対象業務に限定して利用 |

| 機密情報 | 顧客情報、契約情報、価格情報 | 最小権限、人間承認、ログ必須 |

| 高度機密情報 | 人事評価、M&A、経営戦略、未公開財務 | 原則アクセス不可。例外時は個別承認 |

5. ツール権限:読み取り・下書き・実行を分ける

AIエージェントのリスクは、使えるツールの種類で大きく変わります。

同じメールツールでも、「受信メールを読む」「返信案を作る」「実際に送信する」ではリスクがまったく違います。同じCRMでも、「顧客情報を参照する」「顧客情報を更新する」「外部へエクスポートする」では危険度が変わります。

ツール権限は、最低限次のように分けます。

- 読み取り

- 検索

- 候補作成

- 下書き作成

- 更新

- 削除

- 外部送信

- 他エージェントへの委任

本番導入時は、原則として「読み取り」「候補作成」「下書き作成」から始めるのが安全です。

6. 人間承認:どこで人間が止めるのか

AIエージェント導入では、どこまで自動化するかより、どこで人間が止められるかが重要です。

以下の操作は、原則として人間承認を必須にしてください。

- 外部メール送信

- 契約書の送付

- 支払い申請

- 顧客情報の更新

- 個人情報の出力

- ユーザー権限の変更

- 本番環境への反映

- 他エージェントへの機密情報共有

AIには下書きや候補作成までを任せ、重要操作は人間が承認する。この設計が、AIエージェント導入の基本です。

7. 外部入力対策:AIが読むものを信頼しすぎない

AIエージェントは、メール、Web、PDF、社内文書、MCPツール、A2A通信など、さまざまな情報を読みます。

しかし、それらは必ずしも安全な入力源ではありません。外部入力に紛れ込んだ指示をAIが命令として解釈すれば、プロンプトインジェクション2.0が成立します。

外部入力対策では、次の3点が重要です。

- 外部入力を「参考情報」として扱い、社内命令と混ぜない

- AIが外部入力を読んだ後に実行できる操作を制限する

- 重要操作の前に、参照元と実行内容を人間が確認する

8. MCP/A2A接続:つながる相手を検証する

MCPやA2Aは、AIエージェントを業務で使うための重要な接続基盤です。しかし、接続先が増えるほど攻撃面も広がります。

MCPでは、外部ツールや外部MCPサーバーの信頼性を確認する必要があります。A2Aでは、相手エージェントのID、権限、責任範囲、共有してよい情報を確認する必要があります。

MCP接続においては、接続先のサプライチェーン・トラストを評価します。サードパーティ製のMCPサーバーが、意図しないデータ転送を行っていないか、脆弱性対応や更新管理が行われているかを確認し、信頼できる接続先だけを許可リスト化します。

| 対象 | 確認項目 |

|---|---|

| MCPツール | ツールの提供元、権限スコープ、ログ取得、更新管理 |

| 外部MCPサーバー | 接続先の信頼性、許可リスト、サンドボックス検証 |

| A2A通信 | 相手エージェントの認証、メッセージ検証、共有情報の制限 |

| 他エージェントへの委任 | 委任範囲、戻り値検証、責任分界、監査ログ |

また、Palo Alto Networks Unit 42が示したAgent Session Smugglingの検証は、A2Aのようなエージェント間通信において、セッション文脈が引き継がれること自体が攻撃面になり得ることを示しています。これは、PoC段階から「相手エージェントをどこまで信頼するか」を確認すべき理由になります。

MCPの基本は、MCPとは?AIツール連携の仕組み・APIとの違い・安全な始め方を解説で整理しています。A2Aの考え方は、A2Aとは?MCPとの違いと日本企業が見落とす前提条件を参照してください。

9. 監査ログ:AIの行動をあとから説明できるか

AIエージェントの導入では、ログ設計が本番可否を左右します。

APIログだけでは不十分です。AIが何を読み、どのように判断し、どのツールを使い、誰が承認し、どの出力を行ったのかを追える必要があります。

| ログ項目 | 内容 | 目的 |

|---|---|---|

| 入力ログ | ユーザー指示、外部入力、参照文書 | 何を根拠に判断したか確認する |

| 判断ログ | AIの計画、選択した手順、推論要約 | 目的逸脱や誤判断を検証する |

| ツールログ | 呼び出したツール、引数、戻り値 | 誤実行や不正利用を追跡する |

| 承認ログ | 誰が、いつ、何を承認したか | 責任分界を明確にする |

| 出力ログ | 作成文書、送信内容、更新結果 | 外部影響を確認する |

10. 停止手段・運用レビュー:止められる設計になっているか

AIエージェントは、本番導入後も変化します。利用業務が増え、接続ツールが増え、参照データが増えます。最初は適切だった権限設定も、時間の経過とともに広すぎるものになることがあります。

したがって、導入前に以下を決めてください。

- 異常時にAIエージェントを停止する手順

- 外部送信やツール実行を一時停止する方法

- 権限棚卸しの頻度

- ログレビューの担当者

- インシデント発生時の連絡ルート

AIエージェントを止められない企業は、本番導入する準備ができていません。

導入可否をどう判断するか

AIエージェントは、便利だから導入するのではない。導入しても説明でき、止められ、改善できる状態になったときに本番へ進める。

AIエージェントは、便利だから導入するのではない。導入しても説明でき、止められ、改善できる状態になったときに本番へ進める。

10項目を確認したら、次に導入可否を判断します。おすすめは、各項目を「未対応」「一部対応」「対応済み」の3段階で評価することです。

| 評価 | 状態 | 判断 |

|---|---|---|

| 未対応 | ルール・責任者・ログ・承認が未定義 | 本番導入不可。PoC継続または再設計 |

| 一部対応 | 主要項目は決まっているが、例外処理や停止手段が弱い | 限定本番、読み取り専用、低リスク業務から開始 |

| 対応済み | 目的、権限、承認、ログ、停止手段が明文化されている | 段階的に本番導入可能 |

Go / No-Go 判断の考え方

本番導入の判断では、次の問いに答えられることが重要です。

- AIが何をするためのものか説明できるか

- AIが読めるデータを説明できるか

- AIが使えるツールと使えないツールを説明できるか

- AIが重要操作を実行する前に人間が止められるか

- 事故が起きたときにログから原因を追えるか

- 異常時にAIの権限や接続を止められるか

これらに答えられない場合、まだ本番導入のタイミングではありません。

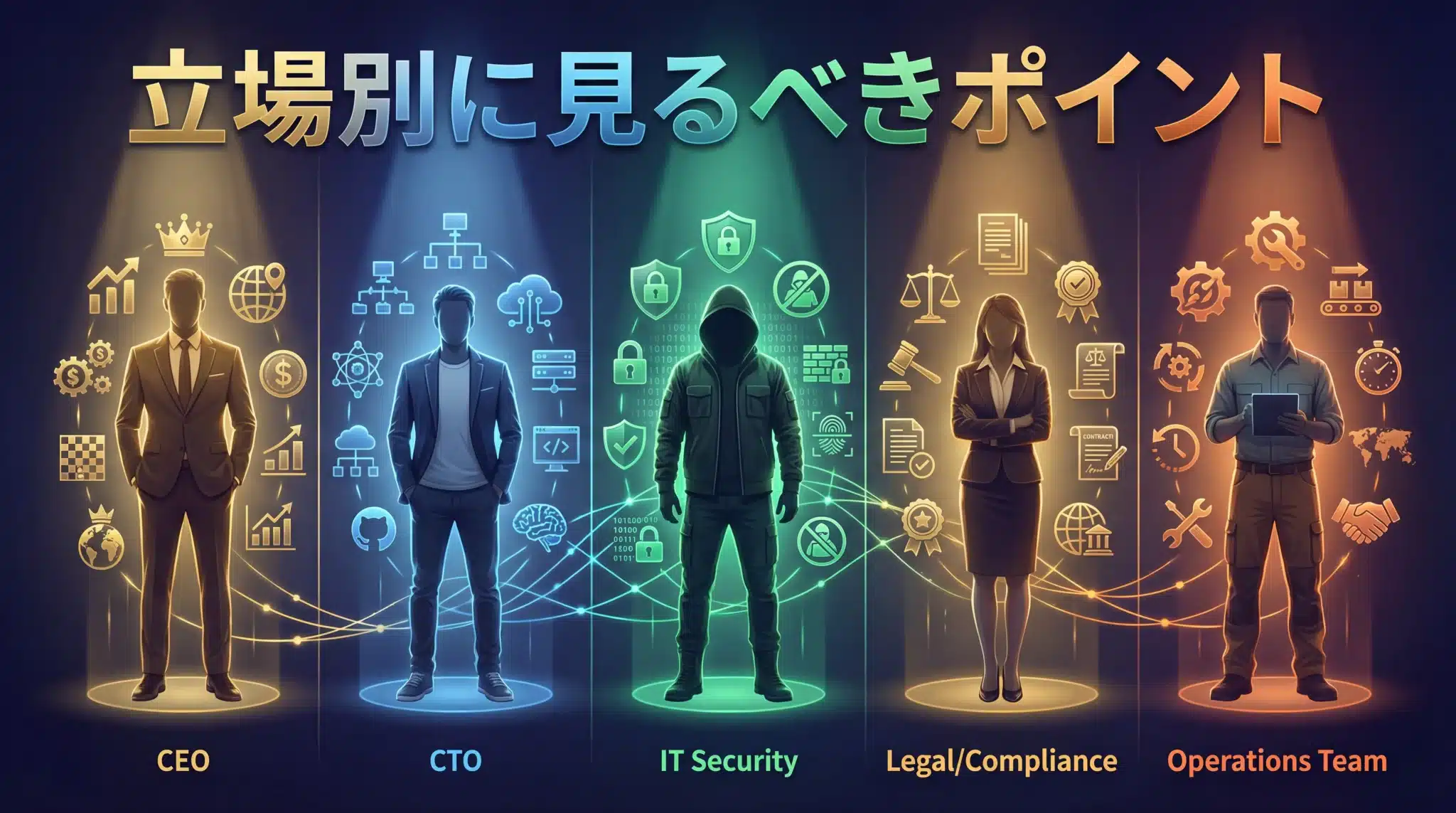

立場別に見るべきポイント

AIエージェント導入は情シスだけの仕事ではない。経営、事業部門、CTO、法務、現場がそれぞれの責任で確認する必要がある。

AIエージェント導入は情シスだけの仕事ではない。経営、事業部門、CTO、法務、現場がそれぞれの責任で確認する必要がある。

| 立場 | 見るべきポイント | 問い |

|---|---|---|

| 経営者 | 導入目的、事業リスク、責任分界 | AIに任せる業務と任せない業務を決めているか |

| CTO・開発責任者 | アーキテクチャ、MCP/A2A、ログ、停止手段 | 本番環境で安全に制御できる設計か |

| 情シス | ID管理、権限、SaaS連携、監査ログ | AIエージェントを管理対象に入れているか |

| 法務・コンプライアンス | 契約、個人情報、説明責任 | AIが行った操作の責任範囲を定義しているか |

| 現場部門 | 業務フロー、承認、例外処理 | AIが止まるべき場面を現場目線で定義しているか |

AIガバナンスや契約実務の責任分界については、Agentic AIの暴走とAIガバナンスも合わせて参照してください。

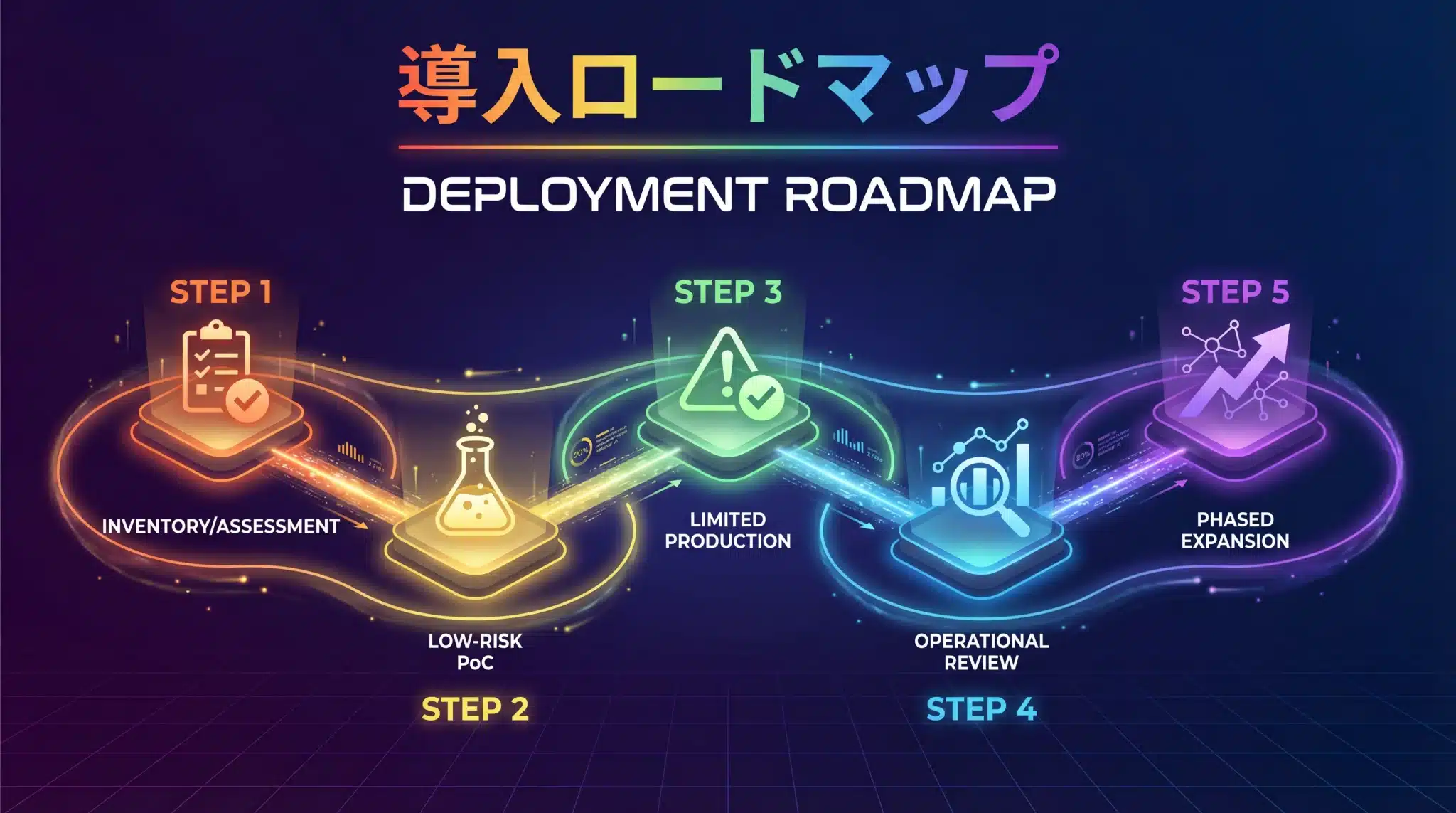

導入ロードマップ

AIエージェント導入は、一気に全社展開するものではない。低リスク業務から始め、権限と接続を段階的に広げる。

AIエージェント導入は、一気に全社展開するものではない。低リスク業務から始め、権限と接続を段階的に広げる。

ここで重要なのは、ガバナンスをAI活用のブレーキとして見るのではなく、安心してアクセルを踏むための安全装置として設計することです。

| 段階 | 目的 | 実施内容 |

|---|---|---|

| Step 1:棚卸し | 対象業務とリスクを把握する | 業務目的、データ、ツール、責任者を整理する |

| Step 2:低リスクPoC | AIの効果と危険な動きを観察する | 読み取り専用、ダミーデータ、下書き限定で検証する。この段階で、OWASP Top 10でいうTool MisuseやMemory & Context Poisoningに近い挙動が出ないかを、あえて観察する |

| Step 3:限定本番 | 小さく本番運用する | 対象部門・対象業務・対象ツールを絞って運用する |

| Step 4:運用レビュー | 権限肥大化と異常動作を防ぐ | ログ確認、権限棚卸し、停止手順の訓練を行う |

| Step 5:段階拡張 | 効果と統制の両方を確認しながら拡張する | 新ツール、新部門、新エージェント連携を段階的に追加する |

よくある失敗

AIエージェント導入の失敗は、技術選定よりも運用設計の甘さから起きる。特にPoCの権限をそのまま本番に持ち込むことが危険である。

- PoCの広い権限を本番に持ち込む:検証環境で「とりあえず全部読ませてみた」設計が、そのまま事故要因になる

- 人間アカウントでAIを動かす:操作主体が曖昧になり、監査できなくなる

- 承認ポイントを後付けにする:業務フローに組み込めず、形骸化する

- ログをAPI側だけに任せる:AIの判断経路が追えない

- 停止手段を決めていない:異常動作時に連携や権限を止められない

- 現場部門だけで導入する:情シス、法務、経営が関与せず、統制が後追いになる

想定ケース:PoCの広い権限がそのまま本番に持ち込まれた場合

たとえば、PoC時に「検証しやすいように」全社チャネルや社内文書への広い参照権限をAIエージェントに与えたとします。その設定のまま本番導入すると、AIは本来参照すべきでない人事情報や機密情報を業務回答に混ぜてしまう可能性があります。

問題は、AIが悪意を持っていることではありません。PoCで許した便利な権限が、本番ではそのまま漏洩リスクに変わることです。

AI導入が組織で失敗する構造については、AI活用はなぜ失敗するのか?「Agentic AI」時代の全社OS化と組織設計の教科書でも詳しく解説しています。

一次情報からどこまで言えるか

一次情報が示しているのは、AIエージェント導入を技術検証だけでなく、組織的なリスク管理として扱うべきだという流れである。

本記事のチェックリストは、現場感覚だけで作ったものではありません。以下の一次情報を、企業導入前の実務確認項目に翻訳しています。

- NIST AI Risk Management Framework:AIリスク管理をGOVERN、MAP、MEASURE、MANAGEの4機能で整理

- NIST SP 800-207 Zero Trust Architecture:ネットワーク境界中心ではなく、ユーザー・資産・リソース中心のゼロトラストを整理

- OWASP Top 10 for Agentic Applications 2026:ASI01 Agent Goal Hijack、ASI02 Tool Misuse and Exploitation、ASI03 Identity and Privilege Abuse、ASI07 Insecure Inter-Agent Communication、ASI10 Rogue Agentsなど、AIエージェント特有のリスクを体系化

- CISA Artificial Intelligence:AIを重要インフラや組織へ安全に統合するための考え方を整理

- Palo Alto Networks Unit 42:Agent Session Smugglingとして、A2Aのようなエージェント間通信における文脈リスクを解説

これらの資料に共通するのは、AIを「便利な機能」としてではなく、組織の業務とリスク管理に組み込む対象として扱うべきだという点です。

AIエージェントセキュリティ4本シリーズの地図

本記事は第4回である。第1回で全体像、第2回で脅威、第3回で設計を扱い、第4回で導入判断へ落とし込む。

| 回 | テーマ | 役割 |

|---|---|---|

| 第1回 | AIエージェントセキュリティとは? | MCP/A2A時代に、なぜAIエージェントをセキュリティ設計の対象にする必要があるのかを整理 |

| 第2回 | プロンプトインジェクション2.0 | 見えない命令によって、騙されたAIが権限を使って業務を実行してしまうリスクを解説 |

| 第3回 | AIエージェントのゼロトラスト設計 | 専用ID、最小権限、人間承認、監査ログでAIエージェントをどう統制するかを整理 |

| 第4回 | AIエージェント導入チェックリスト | 経営者・CTO・情シス・現場責任者が使える本番導入前の実務チェックリスト |

ここまでの4本で、「なぜ危ないのか」「何が起きるのか」「どう守るのか」「どう導入判断するのか」を一通り整理しました。

まとめ

AIエージェント導入の最後の判断は、「使えるか」ではない。「安全に使い続けられるか」である。

本記事の要点を整理します。

- AIエージェント導入前には、業務目的、所有者、専用ID、データ範囲、ツール権限、人間承認、ログ、停止手段を確認する

- PoCの成功は本番導入の十分条件ではない

- AIが読めるデータと使えるツールを最小限に絞る

- 重要操作はAIだけで完結させず、人間承認を必須にする

- 事故時に説明できるよう、入力・判断・ツール実行・承認・出力のログを残す

- 本番導入後も、権限棚卸しと運用レビューを継続する

AIエージェントは、企業に新しい生産性をもたらします。しかし、その力は、権限と接続によって初めて現実の業務へ流れ込みます。

だからこそ、AIエージェントを導入する企業に必要なのは、勢いではありません。任せる範囲を決め、止める条件を決め、説明できる記録を残すことです。

AIエージェント導入チェックリストは、AIにブレーキをかけるための書面ではありません。AIが企業の中で安心して力を発揮するための、本番導入の通行証です。

参考文献 / 出典

一次情報

次に読むならこの7本

補足Q&A

Q1.

AIエージェント導入前に最初に確認すべきことは何ですか?

A1.

まず業務目的と責任者を決めることです

AIに何を任せるのか、誰が業務オーナーなのか、誰が技術・運用責任を持つのかを決めなければ、権限設計もログ設計も曖昧になります。

Q2.

PoCで成功したAIエージェントを、その条件のまま本番導入してもよいですか?

A2.

PoCで使った権限・データ範囲をそのまま本番へ持ち込むのは危険です

PoCでは広いデータアクセスや緩い権限で試していることが多いため、本番導入前にデータ範囲、ツール権限、人間承認、監査ログ、停止手段を再設計する必要があります。

Q3.

AIエージェントに人間のアカウントを使わせてもよいですか?

A3.

推奨されません。AI専用IDを用意すべきです

人間アカウントを使うと、AIが実行した操作と人間が実行した操作の区別がつきにくくなります。事故時の原因追跡や責任分界が困難になるため、AIエージェント専用IDで管理するべきです。

Q4.

AIエージェント導入で最も重要なセキュリティ対策は何ですか?

A4.

最小権限と人間承認です

AIが読めるデータと使えるツールを必要最小限に絞り、外部送信、支払い、契約、削除、権限変更などの重要操作には人間承認を入れることが基本です。

Q5.

AIエージェント導入後も見直しは必要ですか?

A5.

必要です。権限や接続先は時間とともに肥大化します

利用業務、接続ツール、参照データ、連携エージェントが増えるほど、初期設計は古くなります。定期的な権限棚卸し、ログレビュー、停止手順の確認が必要です。

更新履歴

- 2026年4月27日:初版公開

以上