「デモで動く」から「本番で稼ぐ」へ。LLMOps完全ガイド

この記事を読むと本番環境における生成AI運用の全貌がわかり、リスクを制御しながらビジネス価値を生み出すための「LLMOps / LLMオブザーバビリティ」を実装できるようになります。

2025年現在、AIの「嘘」や「コスト」を制御できないプロジェクトは30%以上が失敗します。コードの修正ではなく、品質・コスト・安全性を常時監視する「LLMオブザーバビリティ」の導入こそが、本番運用の成否を分ける唯一の鍵です。

超ざっくり言うと:AIは気まぐれな人間のようなものなので、「正しく動いているか」ではなく「正しく振る舞っているか」を、専用の指標(品質・コスト・安全)で常に監視し続ける必要があります。

この記事の構成:

- LLMOpsへのパラダイムシフトと、企業が直面する法的リスク

- LLMオブザーバビリティの3本柱(品質・コスト・安全)と技術標準

- RAG・エージェントのトラブルシューティングと組織的な改善サイクル

プロローグ:月曜の朝、HTTP 200 OKの嘘

月曜の朝、あなたのSlackに1通の通知が届きます。

「先週リリースした社内用AIチャットボット、回答がデタラメだというクレームが3件来ています」

あなたは急いでダッシュボードを確認します。サーバーは稼働中。CPU使用率は正常。APIのレスポンスタイムも平均0.8秒と高速です。そして何より、すべてのAPIリクエストのステータスコードは「200 OK(成功)」を示しています。

技術的には、システムは完璧に動いています。しかし、ビジネス的には、システムは完全に崩壊しています。

ログを詳細に追うと、チャットボットはユーザーに対して、存在しない社内規定を自信満々に、流暢な日本語で説明していました。

これが、生成AI(GenAI)アプリケーション運用の現実です。

従来のソフトウェア開発において、「200 OK」は成功の証でした。しかし、大規模言語モデル(LLM)の世界では、「システムは正常に動作し、自信満々に嘘をつく」ことが日常的に起こります。

Gartnerの2024年の予測では、2025年末までに少なくとも30%の生成AIプロジェクトが、データ品質の低さやリスク管理の不備、コスト増大、ビジネス価値の不明確さなどを理由に、PoC(概念実証)の段階かその直後で放棄されると警告されています。

その最大の共通要因こそが、この「見えない不具合」——つまり、オブザーバビリティ(可観測性)の欠如です。

本記事は、AIを実験室のオモチャから、本番環境で稼ぐための戦力へと昇華させるための「LLMOps / LLM Observability(LLMオブザーバビリティ)」実践ガイドです。コードの書き方ではなく、何を測り、どう判断し、どう経営判断を下すべきかという「運用のモデリング」について解説します。

第1章:LLMOpsへのパラダイムシフト —— 実験室から戦場へ

LLMOps(Large Language Model Operations)とは、LLMを用いたアプリケーションを「作って終わり」にせず、本番環境で安全性・品質・採算性を保ちながら運用し続けるための考え方とプラクティスの総称です。

自動販売機から、気まぐれなアシスタントへ

なぜ、従来の監視ツール(DatadogやNew Relicなど)だけでは不十分なのでしょうか。それは、対象となるシステムの性質が根本から変わったからです。

- 従来のソフトウェア(決定論的システム):

自動販売機のようなものです。100円を入れてボタンを押せば、必ずコーラが出てきます。もし出てこなければ、それは「故障」です。 - 生成AI(確率論的システム):

優秀ですが、少し気まぐれな人間のアシスタントのようなものです。同じ指示をしても、その日のコンディション(パラメータや乱数シード)によって、素晴らしい提案をすることもあれば、大嘘をつくこともあります。

この「確率的な振る舞い」こそが、LLMOps(LLM Operations)の核心です。PoCの段階では、エンジニアが手動で画面を見て「なんとなく良さそう(Vibe-based)」と判断するだけで十分でした。しかし、何千、何万というユーザーが使う本番環境(戦場)では、すべての出力を人間がチェックすることは不可能です。

「エア・カナダ事件」が突きつけたリスク

2024年2月、このリスクが法的な実害として顕在化した象徴的な事例があります。「エア・カナダ事件」です。

同社のチャットボットが、顧客に対して誤った返金ポリシー(正規料金で購入後、90日以内に申請すれば返金されるという、実在しない規定)を案内しました。

後に顧客が返金を求めた際、航空会社は「チャットボットは独立した法的実体であり、自らの行動に責任を持つべきだ」と主張しましたが、ブリティッシュコロンビア州民事紛争解決審判所(CRT)はこれを「驚くべき主張(remarkable submission)」として一蹴し、「企業はウェブサイト上のすべての情報に責任を負う」と断じました。

実は、この問題は単なる技術課題ではなく、業界全体のトレンドです。New Relicの「Observability Forecast 2025」によれば、AI監視の導入率は2024年時点の42%から、2025年には54%へと増加し、初めて過半数を超える見通しです。企業はAIをPoC段階から本番環境へと移行させており、より深いオブザーバビリティへの需要が急速に高まっています。

これは対岸の火事ではありません。現在ではEU AI法をはじめとする規制強化により、AIの「嘘」は企業の存続に関わるコンプライアンス・リスクそのものになっています。

したがって、経営者とエンジニアは、「動いているか」ではなく、「法的に説明可能な状態で振る舞っているか」を監視する仕組みを構築しなければなりません。

第2章:「見る」ための設計図 —— LLM Observability(AIオブザーバビリティ)の3本柱

では、具体的に何を監視すればよいのでしょうか。漠然とログを取るのではなく、以下の3つの柱で「問い」を設計する必要があります。

1. 品質(Quality):嘘をついていないか?

最も重要な指標です。しかし、正解データがない生成AI、とくにreasoning LLM(推論モデル)において、どうやって品質を測るのでしょうか。ここでは「Ragas」などの評価フレームワークで用いられる指標が標準となりつつあります。

※Ragas(Retrieval Augmented Generation Assessment):2023年に発表され、2025年現在、GitHubで多くの支持を集めているオープンソースフレームワーク。

- Faithfulness(忠実性): AIの回答は、与えられた情報源(マニュアル等)に基づいているか? それとも勝手にでっち上げているか?

- Answer Relevancy(回答関連性): ユーザーの質問に対して、的確に答えているか?(「分かりません」と答えるべきところで、無理やり答えていないか?)

- Context Precision(コンテキスト適合度): RAGにおいて、検索システムが「質問に関連するドキュメント」だけを正しく拾えているか?(ノイズ情報が混ざっていないか?)

2. コストとパフォーマンス(Cost & Performance):採算は合うか?

生成AIは、リクエストごとに従量課金(トークン課金)が発生する、極めて「原価」の高いシステムです。

図の要点まとめ:

・従来のモデルでは「速さ」が正義だった

・System 2モデルでは「待ち時間=思考時間」となり価値が変わる

・コスト対効果の測定指標をアップデートする必要がある

- トークン効率: 1回の回答に何円かかったか。

- レイテンシと「思考」コスト:

重要なのはTTFT(Time To First Token:最初の文字が出るまでの待機時間)です。

ただし、2025年時点で急速に普及しつつある「推論モデル(System 2)」 —— 代表例として OpenAI o3-pro、Google Gemini 3 Pro/Gemini 3 Deep Think、Claude Opus 4.5 など —— においては、この待機時間は単なる遅延ではなく「AIが深く思考している時間」でもあります。

単純な速さを追うのではなく、「その5秒間の思考(待ち時間)が、コストに見合う価値を生んだか?」を評価する視点が必要です。

3. 安全性とガードレール(Safety & Guardrails):暴走していないか?

AIが差別的な発言をしたり、プロンプトインジェクション攻撃によって社内機密を漏洩したりするリスクです。

- PII(個人情報)検知: ユーザーが入力したクレジットカード番号や電話番号が、ログや外部モデルに送信されていないか。

- 脱獄(Jailbreak)試行数: 「この命令を無視して〜」といった攻撃的なプロンプトがどれくらい来ているか。

OWASP Top 10 for LLM Applications 2025では、これと密接に関係するプロンプトインジェクション(LLM01:2025)が最重要リスクとして第1位に位置づけられています。

さらに、2025年に発表されたある研究では、商用 LLM アシスタントを対象にした間接的プロンプトインジェクション攻撃シナリオの約73%が「高〜重大リスク」と評価されたと報告されており、本番環境における最大級の脅威となっています。

技術標準としてのOpenTelemetry

これらのデータを収集するために、独自仕様のログを埋め込むのは悪手です。AI業界では現在、OpenTelemetryが生成AI向けの規約(Semantic Conventions for GenAI)を策定しており、2025年時点ではまだDevelopment段階(実験的段階)ですが、Datadogなど多くの主要監視ツールが対応を進める「事実上の標準規格」になりつつあります。

「モデル名」「トークン数」「プロンプトの内容」などを規格に従って記録することで、使用するモデルや監視ツールが変わっても、資産を継承できるエコシステムが出来上がっています。

第3章:ブラックボックスの中身を透視する —— RAGとエージェント

AIアプリケーション、特にRAG(検索拡張生成)やエージェントシステムは、複数の処理が連鎖する複雑なパイプラインです。「回答がおかしい」という結果だけを見ても、原因は分かりません。

ここで必要になるのが、処理の流れを追跡する「分散トレーシング」の技術です。

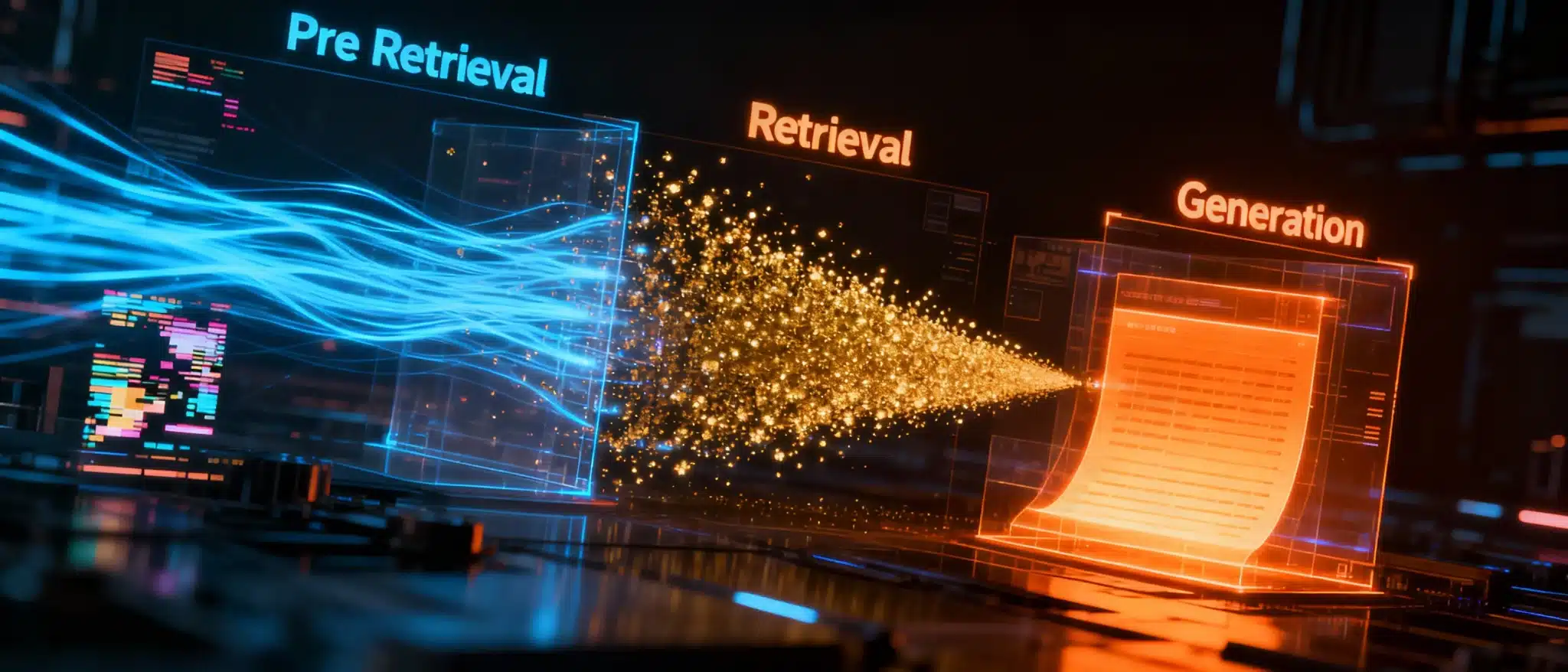

RAGの解剖学:どこで間違えたのか?

RAGシステムが誤った回答をした場合、原因は以下のどこかに潜んでいます。

- 検索前(Pre-Retrieval): ユーザーの曖昧な質問を、AIが正しく検索クエリに変換できなかった。(例:「私のPCが動かない」→「PC 故障」と変換すべきを、「PC 価格」と変換してしまった)

- 検索(Retrieval): ベクトルデータベースから、無関係なドキュメントを引いてきてしまった。(Context Precisionの低下)

- 生成(Generation): 正しいドキュメントを渡したのに、LLMが読み間違えた、あるいは無視した。

ログには、最終的な回答だけでなく、「検索クエリ」「ヒットしたドキュメントID」「その類似度スコア」を紐づけて記録する必要があります。これにより、「検索が悪かったのか、生成が悪かったのか」を即座に切り分けることができます。

エージェントの「死のループ」

さらに複雑なのが、AI自身がツールを使ってタスクをこなす「自律型エージェント」です。

エージェントは時として、エラーが出るツールを何度も叩き続けたり、同じ思考プロセスを無限に繰り返したりする「無限ループ(Loop of Death)」に陥ります。

これを検知するには、エージェントの「思考(Thought)」→「行動(Action)」→「観察(Observation)」というステップごとのツリー構造を可視化し、「ステップ数が閾値を超えたら強制停止する」といったサーキットブレーカーの仕組みを実装に組み込む必要があります。

第4章:AI時代のSRE —— 「品質」を数値化し、合意する

システムの中身が見えるようになったら、次は「運用ルール」の策定です。ここで、SRE(Site Reliability Engineering)の概念であるSLO(Service Level Objective:サービスレベル目標)をAIに適用します。

システムの中身が見えるようになったら、次は「運用ルール」の策定です。ここで、SRE(Site Reliability Engineering)の概念であるSLO(Service Level Objective:サービスレベル目標)をAIに適用します。

「品質」をSLOにする

従来のWebシステムでは「稼働率99.9%」などがSLOでしたが、AIシステムでは「品質」そのものを数値目標にします。

AI運用のSLO例:

「過去1週間のリクエストのうち、評価スコア(Faithfulness)が0.8を下回る回答の割合を、5%未満に抑える」

これは画期的な転換です。「なんとなく頭が悪い」という定性的な不満を、「SLO未達」という定量的な事実に変換できるからです。

エラーバジェット:失敗を許容する契約

SLOを設定することは、裏を返せば「これくらいなら失敗してもよい」という許容量(エラーバジェット)を決めることです。

生成AIに100%の精度を求めるのはコスト的に不可能です。

「月に100件までは誤回答を許容する。その代わり、それを超えたら新機能の開発を止めて、プロンプト改善に全力を注ぐ」

このように、経営層とエンジニアが事前に「許容できるリスク」を握っておくことが、健全なAI運用の第一歩です。

第5章:意思決定と組織論 —— データに基づく改善サイクル

最後に、これらの仕組みを組織にどう実装するか、意思決定のポイントを解説します。

「ログ」のジレンマとサンプリング戦略

「すべての会話ログを保存すべきか?」という問いに対して、答えはイエスでありノーです。

全ログの保存は、コストの増大とプライバシーリスク(PIIの混入)を招きます。一方で、ログがなければ改善は不可能です。

推奨される戦略は「条件付き記録」です。

- 通常のログは、トークン数やレイテンシなどの「メタデータ」のみを記録する。

- 「ユーザーが低評価(Badボタン)を押した時」や「品質スコアが閾値を下回った時」のみ、プロンプトと回答の全文を詳細に記録する。

これにより、コストとリスクを最小化しつつ、改善に必要な「失敗データ」を確実に収集できます。

Human-in-the-Loop(人間参加型)の評価

AIによる自動評価(LLM-as-a-Judge)は強力ですが、完璧ではありません。

2024〜2025年にかけて公開された複数の研究では、タスク特化でファインチューンされた小さな評価モデルは一部ベンチマークでは有望な結果を出す一方で、汎用性やロバスト性、見えにくいバイアスの抑制という点では、依然としてGPT-4クラスの大規模モデルに匹敵するレベルには達していないことが報告されています。

そのため、AIがAIを評価するだけではバイアスが増幅されるリスクが残ります。

したがって、サンプリングされたログの数%は、必ず人間の専門家(ドメインエキスパート)が目視でチェックし、AIによる採点が妥当かどうかを監査するプロセス(Human-in-the-Loop)を組み込んでください。この人間によるフィードバックこそが、将来的に自社特化の評価モデルを作るための黄金の教師データとなります。

| 評価軸 | 従来のLLM ms | 推論モデル(System 2) ms |

|---|---|---|

| Latency (TTFT) | 極めて高速 (0.2s〜) | 意図的に遅い (数秒〜数十秒) |

| Cost(概念) | 回答の生成量に比例 | 「思考時間」の深さに比例 |

| 判定根拠 | System 2モデルは回答生成前に「思考プロセス」を経るため、TTFTは遅延ではなく付加価値の源泉となります。 | |

専門用語まとめ

- LLMOps

- LLM(大規模言語モデル)を用いたアプリケーションを、本番環境で安全性・品質・採算性を保ちながら運用し続けるためのプラクティスとツールの総称。

- TTFT (Time To First Token)

- ユーザーがリクエストを送信してから、AIの回答の最初の1文字が表示されるまでの待機時間。推論モデルにおいては「思考時間」としての意味も持つ。

- RAG (Retrieval-Augmented Generation)

- 検索拡張生成。LLMに外部データの検索結果を渡し、それを基に回答を生成させる技術。ハルシネーションの抑制と最新情報の反映に有効。

- ハルシネーション (Hallucination)

- AIがもっともらしい嘘をつく現象。事実に基づかない情報を生成してしまうこと。LLMの確率的な性質に起因する。

- プロンプトインジェクション (Prompt Injection)

- 悪意のある入力によってLLMの命令を上書きし、本来意図しない挙動や情報漏洩を引き起こすサイバー攻撃手法。

- Human-in-the-Loop

- AIシステムのループの中に人間が介在すること。AIの出力結果を人間が監査・修正し、その結果を再学習に回すプロセス。

- OpenTelemetry

- オブザーバビリティのためのデータ(メトリクス、ログ、トレース)を収集・転送するためのオープンソースの標準規格。

よくある質問(FAQ)

Q1. LLMOpsとMLOpsの違いは何ですか?

A1. 一般に MLOps は、需要予測やスコアリングモデルを含むあらゆる機械学習モデルの運用を指します。一方 LLMOps は、その中でも生成AI特有の課題(ハルシネーション・プロンプト・トークンコスト等)にフォーカスした、いわば「LLM特化のMLOps」です。

Q2. 2025年11月現在、どの推論モデルを使うべきですか?

A2. 用途によりますが、現時点の公開情報と実務での利用事例から見ると、プログラミングは Claude Opus 4.5、複雑推論は OpenAI o3-pro、コスト重視なら Google Gemini 3 系や DeepSeek V3.1 が有力候補です。

なお、モデルの提供状況や料金体系は頻繁に変わるため、実際に採用する際は必ず各社の公式ドキュメントと価格表で最新情報を確認してください。

Q3. LLMOpsを始めるには、まず何から手をつけるべきですか?

A3.

まずは「ログ基盤の整備」と「OpenTelemetryによる共通フォーマット化」から始めてください。

全件の会話ログを無制限に保存するのではなく、通常はトークン数・レイテンシなどのメタデータを常時記録しつつ、

ユーザーの低評価や品質スコアが閾値を下回ったケースだけ全文を残すといった

「条件付き記録」の方針が現実的です。

小さく始めて、徐々に自動評価(Ragas等)やHuman-in-the-Loopを組み込んでいくのが定石です。

今日のお持ち帰り3ポイント

- 「200 OK」は成功の証ではない。AIは正常に動作しながら自信満々に嘘をつく。

- LLMオブザーバビリティの3本柱(品質・コスト・安全性)をOpenTelemetry等の標準規格で可視化する。

- 完全自動化は幻想。Human-in-the-Loop(人間による監査)をプロセスに組み込み、評価データを育て続ける。

主な参考サイト

- Gartner Predictions for GenAI (2024)

- New Relic Observability Forecast 2025

- Moffatt v. Air Canada, 2024 BCCRT 149 (Civil Resolution Tribunal)

- OWASP Top 10 for LLM Applications

- OpenTelemetry Semantic Conventions for GenAI

合わせて読みたい

- 生成AIの解体新書:その仕組みを直感的に理解する

- 2026年AIエージェント「実装元年」へ:“行動するAI”の統制術

- RAG導入の覚悟とは ~DXの切り札、成功の鍵は準備と理解~

- 【2025年最新】ディープフェイク対策:あなたの会社が40億円を失う前に

- データ構造化が拓くAIの真価:DX成功への羅針盤【2025年版】

更新履歴

- 初版公開

-320x180.webp)