【2026年】量子コンピューティングの転換点:エラーの壁を迂回した2つの戦略

量子コンピュータは、いつまで経っても“すごい研究”のまま終わるのか。

そう見えていた流れが、2025年から2026年にかけて大きく変わりました。実用化を阻んでいた最大の敵は「エラー」でしたが、GoogleとIBMはその壁を真正面から破壊するのではなく、まずは巧妙に「迂回」する道を見つけました。この記事を読むと、なぜ量子実用化が難しかったのか、2025年に何が起き、2026年にその意味がどう定まったのかを、経営視点と技術視点の両方から説明できるようになります。

✅ この記事の結論(TLDR)

- ポイント1:量子実用化の最大の壁はノイズによるエラーだったが、2025年はGoogleの「量子エコー」とIBMの「エラー軽減」により、QEC完成を待たずに価値を引き出すルートが明確になった。

- ポイント2:2026年の本質は「もっと速くなった」ことだけではない。検証可能性、量子×HPC×AIのハイブリッド運用、リアルタイム制御が揃い始め、量子計算は“測りながら前進できる技術”になりつつある。

- ポイント3:汎用FTQCはまだ先だが、金融・創薬・材料・最適化ではすでに前哨戦が始まっている。同時に、PQC移行は将来課題ではなく今の経営課題である。

なぜ量子コンピュータは「夢」だったのか? 越えられなかった「エラーの壁」

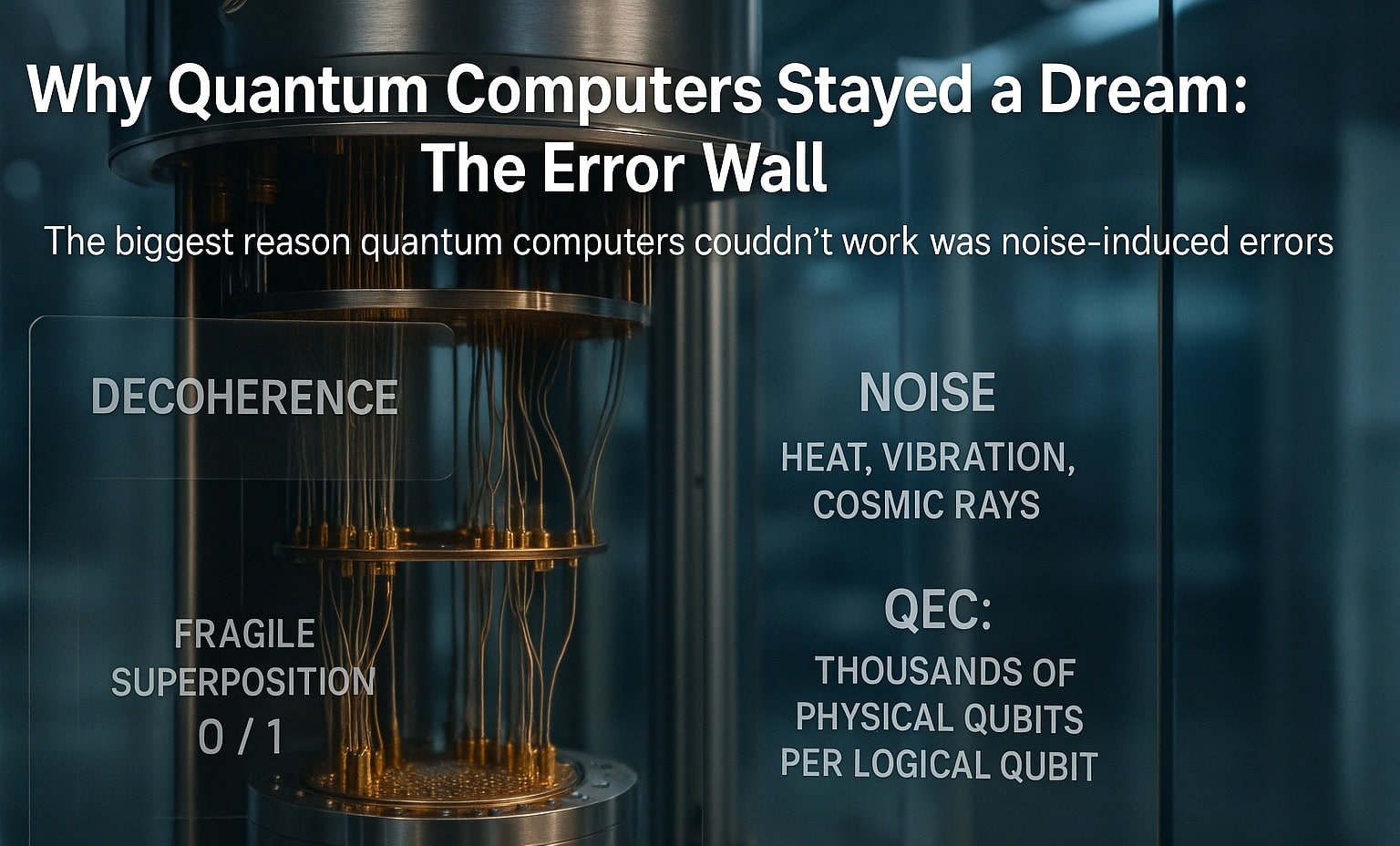

実用化を止めていた本当の敵は、演算能力不足ではなくノイズによるエラー。

「エラーの壁」とは、量子ビットが外部ノイズによって容易にデコヒーレンスを起こし、計算途中の量子状態が壊れてしまうため、計算が長くなるほど正しい答えに到達しにくくなる根本課題のことです。

量子コンピュータが従来のコンピュータと決定的に違うのは、「0と1を重ね合わせる」量子ビットを使う点にあります。ところが、この重ね合わせ状態は驚くほど壊れやすく、外部からのわずかな熱、振動、宇宙線、電磁ノイズに触れただけで、量子ビットは一気に古典的な状態へと崩れてしまいます。

これを「デコヒーレンス(量子状態の崩壊)」と呼びます。計算の途中でデコヒーレンスが起きると、それまで積み上げた情報は失われ、正しい答えに届く前に計算そのものが壊れてしまいます。これが何十年も量子実用化を阻んできた「エラーの壁」の正体です。

たとえるなら、これまでの量子コンピュータ開発は深い霧の中を羅針盤だけで進む航海に似ていました。目的地は分かっていても、どこで座礁するか分からず、どれだけ前進できたのかも正確には見えない。研究者たちは前に進んでいるはずなのに、計算の信頼性を確認する術が限られていたのです。

この壁を越えるために研究者たちが目指してきたのが量子誤り訂正(QEC)です。これは、多数の不安定な物理量子ビットを束ねて、たった1つの安定した論理量子ビットを作り出すという壮大な技術です。ですが、その実装には膨大なオーバーヘッドが必要で、「量子コンピュータの本格実用化は10年以上先」と語られ続けてきました。

2025年秋の地殻変動:壁を「迂回」した2つのブレークスルー

QEC完成ではない。だが、実用化を前倒しする「迂回路」が見えた。

要約: 2025年秋の成果は、QECを完成させたのではありません。 そうではなく、エラーを「打ち消す」アルゴリズムと、エラーを「後から差し引く」技術という、二つの巧妙な迂回策で実用化への扉を押し開いたのです。

2025年秋、量子業界に衝撃が走りました。IBMとHSBCが金融分野での成果を示し、続いてGoogleが科学計算において検証可能な量子優位性を打ち出したからです。重要なのは、これらの成果がQECを完全実装したFTQCの達成ではないという点です。むしろ意味があるのは、QECの完成を待たずに、今あるノイズまみれのマシンから価値を引き出したことにあります。

2026年の視点から見ると、この転換の意味はさらに明確です。量子計算は、霧の中を手探りで進む航海から、GPSと高精度レーダーで現在地を確認しながら進める航海へと変わりつつあります。Googleが示したのは単なる高速化ではなく、「その答えが意味を持つ」と検証できる量子優位性でした。そしてIBMが示したのは、ビジネス課題に対して量子ハードを含むワークフローが価値を出しうる可能性でした。

- 要点: 2025年秋の成果は、QEC完成ではなく「エラー制御」の進歩で実用的価値の前倒しを示した。

- 要点: Googleは検証可能性、IBM/HSBCは商業ワークフローでの性能改善を示した。

- 要点: 2026年にはこの流れが量子×HPC×AIのハイブリッド実装へ接続され始めている。

Googleの突破口:「量子エコー」がノイズを打ち消す

Googleが2025年10月に示した「Quantum Echoes(量子エコー)」の核心は、単なる高速化ではありません。 最大のポイントは、ハードウェア上で「検証可能な量子優位性」を実証したことです。これは「量子コンピュータの方が速かった」という話にとどまらず、その結果が意味のある計算として再現・検証できることを示した点で、2019年の量子超越性の議論から一歩進んだマイルストーンでした。

👨🏫 AI専門家が解説:なぜノイズが「打ち消される」のか?(やまびこの比喩)

この技術の核心は「やまびこ」です。

強風が吹き荒れる山の上で、友人に「こんにちは!」と叫んでも、その声は風の音にかき消されてしまいます。これが従来の量子コンピュータでした。信号はあるのに、ノイズが強すぎて見えないのです。

Googleの量子エコーでは、ここで意図的に「やまびこ」を発生させる操作を加えます。これが時間反転に相当する操作です。

観測される2つのデータ

- 直接音:信号 + ノイズ

- やまびこ:エコー信号 + ノイズ

ここが決定的に違う

- ノイズ:毎回ランダムで、互いに相関が弱い

- 信号:直接音とやまびこには明確な相関がある

この二つを統計的に比較すると、ランダムなノイズ成分は平均化で打ち消され、相関のある信号だけが浮かび上がってきます。つまり、QECが未完成でも、ノイズの海から意味ある答えを引き上げられるのです。

エンジニア向け技術解説:WillowとQuantum Echoesが何を変えたのか

Googleは2024年末に新型チップ「Willow」を発表し、2025年10月にはその上でQuantum Echoesを実行して、検証可能な量子優位性を示しました。重要なのは、Willowが単に量子ビット数を増やしただけのチップではなく、高いゲート忠実度によって「検証できる計算」を支えるハードウェア基盤として設計されている点です。

1.目的:「速い」だけではなく「検証できる」こと

2019年の量子超越性は象徴的な出来事でしたが、計算結果をどう検証するかが大きな論点として残りました。今回のGoogleの成果は、科学的に意味のある計算タスクで、しかも結果の妥当性を検証できることを示した点に本質があります。

2.手法:時間反転を含むエコー操作

量子系を順方向に進化させた後に、時間反転に相当する操作を加え、再び情報を比較することで、ランダムなデコヒーレンスの影響を統計的に抑え込みます。一方で、系が本来持つカオス性や相関情報は、むしろ抽出しやすくなります。

3.何がブレークスルーだったのか

Googleはこの手法により、古典計算では極めて困難な特定タスクに対して、量子ハードウェア上で大きな速度差を示しました。ここで重要なのは、「何年かかるか」という見出しの派手さではなく、検証可能な形で優位性を示したことです。量子計算が“速いかもしれない”から“速くて意味がある”へ進んだ。これが2025年の本当のインパクトです。

さらに、この成果は創薬や材料科学における分子シミュレーション、NMR系の解析タスクなど、実際の科学計算への接続可能性も示しました。抽象的なベンチマーク競争から一歩踏み出し、量子計算が「どこに効くのか」を見せ始めた点でも大きな意味があります。

IBM/HSBCの突破口:高忠実度ハードと「エラー軽減」技術

Googleがアルゴリズムでノイズを「打ち消した」のに対し、IBMとHSBCが示したのは、ハードウェアの進化とソフトウェアの補正を組み合わせて、ノイズを「推定して差し引く」アプローチでした。こちらは派手さよりも堅実さが際立つ路線です。

👨🏫 AI専門家が解説:なぜエラーを「後から差し引ける」のか?(体重計の比喩)

IBMのエラー軽減は、ズレのある体重計を補正する感覚に近い考え方です。

1.問題

エラーの多い量子コンピュータで計算すると、出てきた値が正しい信号なのか、ノイズ込みなのか区別しにくくなります。

2.解決策

- ハードの改善:まずIBMは、Heronのような高忠実度プロセッサで、そもそものズレを小さくしました。

- ソフトの改善:そのうえで、ノイズの癖を統計的に学び、結果から誤差分を差し引く処理を加えました。

3.結論

つまりIBMは、ノイズをゼロにしたわけではありません。ノイズがあることを前提に、その影響を見積もって答えを補正したのです。Googleが「ノイズを相殺する」なら、IBMは「ノイズを補正する」と言えます。

エンジニア向け技術解説:HeronプロセッサとError Mitigation

IBMの成果の技術的な核心は、高忠実度ハードウェアとエラー軽減ソフトウェアの相乗効果にあります。

1.ハードウェアの鍵:Heron

Heronは、単なる量子ビット数の拡大ではなく、ゲート忠実度や安定性の向上を重視した設計です。エラー軽減は、元のノイズが小さいほど推定精度が高まるため、ハードの質がソフト補正の前提になります。

2.ソフトウェアの鍵:Error Mitigation

量子誤り訂正がエラーをリアルタイムで検知・修正するのに対し、エラー軽減は複数条件での測定結果から「ノイズゼロに近い状態」を外挿推定する技術です。代表例にはZNEなどがあります。QECほどのオーバーヘッドなしに、NISQで使える精度を引き上げられる点が特徴です。

3.何がブレークスルーだったのか

IBMとHSBCは、このハードとソフトの組み合わせを金融分野の実課題に適用し、量子ハードを含むワークフローが古典手法に対して改善を示しうることを具体値で報告しました。もちろん、これをもって一般化された「量子優位」と読むのは早計です。比較条件やデータ設計、評価指標の読み解きは慎重であるべきです。

それでも、量子コンピュータが“研究室の中だけの存在”ではなく、実ビジネス課題で効く可能性を具体値で語り始めたこと自体に大きな意味があります。さらに2026年には、IBMが複雑な分子構造の理解でも量子計算の有用性を示し始めており、金融だけでなく量子化学・材料・創薬へと応用の重心が広がりつつあります。

結局、いつ実用化するのか? ロードマップはどう変わったのか

未来予測は一本線ではなくなった。今使える量子と、将来の汎用量子が分かれた。

今回のブレークスルーは、量子コンピュータのロードマップを根本から書き換えました。従来は「10年後に完璧なマシンが突然登場する」という語られ方が多かったのですが、今はそうではありません。まず使える領域が先に立ち上がり、その後に汎用FTQCへ進むという二段構えの未来が見えてきています。

トラック1:NISQアドバンテージ(今、始まっている)

高性能NISQマシンに、量子エコーやエラー軽減のようなエラー制御技術を組み合わせ、特定の専門問題で価値を出す段階です。金融、材料科学、創薬、最適化など、問題の性質が量子に合う領域では、部分的・条件付きであっても先行実用化が進みうることが見えてきました。

トラック2:FTQC(誤り耐性量子計算)(まだ先だが射程に入った)

QECを本格的に実装し、論理量子ビットを安定運用して、長大で複雑な計算を確実に回せる段階です。こちらが本丸であることに変わりはありませんが、2025年から2026年の進展により、「何も見えていない未来」ではなく、途中の工程と必要条件が見え始めた未来へと変わりました。

直感的に言えば、私たちは「完璧なF1エンジン」が完成するのを待つのではなく、まずは特定のレースで勝てる専用マシンを作り始めた段階にいます。これが2025年以降の量子ロードマップの本質です。

量子コンピュータは単独で勝たない── HPC・AIと組んで初めて価値が出る

2026年の主戦場は、量子単体の競争ではなく、量子をどう既存計算基盤に組み込むか。

2026年に入って明確になったのは、量子コンピュータが単独でスーパーコンピュータを置き換える存在ではないという点です。現在の主流は、HPCやAI基盤の中に量子プロセッサをアクセラレータとして組み込み、タスクに応じて最適配分するハイブリッド設計です。

NVIDIAが打ち出したNVQLinkは、その象徴的な構想です。QPU、GPU、CPUを低遅延で連携させ、量子制御、データ移送、エラー訂正補助、AI最適化といった処理を役割分担させることで、量子コンピュータを孤立した特殊装置ではなく、データセンターの一部として扱う設計思想が明確になりました。

👨🏫 AI専門家が解説:量子・古典ハイブリッドとは何か?(EVのパワーマネジメントの比喩)

量子・古典ハイブリッドは、最新のEVにたとえると分かりやすいです。

- スーパーコンピュータ:長距離を安定して走るためのメインバッテリー

- 量子コンピュータ:坂道や追い越しで大きな力を出す高出力モーター

- 制御ソフトウェア:どの場面でどちらを使うか判断する車載コンピュータ

どちらか一方だけではなく、状況に応じて知的に動力を配分することが、全体の性能を最大化します。2026年の量子コンピューティングは、まさにこの「スーパーハイブリッドマシン」の方向へ進んでいます。

2026年に重要になった3つのインフラ論点

1.量子は“アクセラレータ”として使う発想へ

量子コンピュータは万能CPUではありません。特定演算に強いアクセラレータとして組み込む方が、現実の導入像に近づきます。

2.マイクロ秒単位の制御が価値を左右する

量子誤り訂正やリアルタイム最適化では、遅延がそのまま性能劣化につながります。だからこそ、GPUやFPGAを含む周辺計算基盤との連携が重要です。

3.AIとの融合が前提になりつつある

量子回路の最適化、ノイズ推定、探索空間の絞り込みなど、AIが補助的に入ることで、量子計算の使い勝手は大きく改善します。量子、HPC、AIは競合ではなく補完関係です。

対立する「2つの開発戦略」:迂回か、正面突破か

2025年は進化的アプローチが前進し、2026年はその運用設計が深まった。

2025年の成果は、まず進化的アプローチの有効性を強く印象づけました。既存のNISQハードウェアを磨き込み、エラー制御技術を重ね、そこから価値を引き出す考え方です。Google、IBM、IonQ、富士通、理研などは、濃淡はあれこの路線に立っています。

戦略A:進化的アプローチ(迂回策 + QECへの接続)

この路線では、まず既存デバイスの忠実度を高めることが重要です。たとえばIonQは2量子ビットゲート忠実度99.99%を打ち出し、「質」の競争で大きなマイルストーンを示しました。IBMのHeronも同じく、量子ビット数の拡大以上に品質の向上を重視した設計です。

その上で、量子エコーやエラー軽減のような手法で今すぐ価値を出しつつ、最終的にはQECへ接続していく。今の成果を無駄にせず、その延長線上でFTQCへ向かうのがこの戦略の強みです。

戦略B:革命的アプローチ(正面突破)

これに対してMicrosoftが挑んでいるのが、トポロジカル量子ビットによる正面突破です。もしハードウェアの物理層そのものに高い耐性を持たせられれば、QECの巨大なオーバーヘッドを根本から減らせる可能性があります。

ただし、この路線はハイリスク・ハイリターンです。2025年から2026年にかけて話題性は高まりましたが、すぐに商業実績へつながる段階ではありません。したがって現時点では、商業応用の先行は戦略A、長期的なゲームチェンジの可能性は戦略B、という見方が自然です。

ハードウェア開発競争:「数」から「質」と「運用」へ

2026年の競争軸は、量子ビット数だけでは語れない。

2025年までは「何量子ビットか」という見出しが注目されがちでした。しかし2026年に入って本当に重要になってきたのは、どれだけ正しく動くか、どれだけ長く安定動作できるか、そして誤り訂正や制御を支える運用基盤がどこまで育っているかです。

【質】IonQやIBMが示した「忠実度」の勝負

イオントラップ方式はもともと忠実度の高さが強みでしたが、IonQの高精度指標は「質」の競争がいよいよ主役になったことを象徴しています。IBMもHeronやその後継ロードマップで、接続性や回路実行能力を含む総合的な品質を押し上げる方向へ進んでいます。

【規模】中性原子系が見せるスケーラビリティ

一方、中性原子方式は大規模配列に強く、量子ビット数の拡張では依然として魅力があります。ただし今後は、数が増えたこと自体より、その多数の量子ビットをどう安定的に制御し、どうQECへつなげるかが勝負になります。

【運用】リアルタイム監視と高速デコードの重要性

2026年に特に注目すべきは、量子ビットの性能変動をリアルタイムに追跡する研究や、FPGAを用いた高速デコードの進展です。ここでの進歩は地味に見えるかもしれませんが、実はFTQCに向けて極めて重要です。量子コンピュータは「すごいチップ」だけでは完成しないからです。

👨🏫 AI専門家が解説:量子ビットを安定させるのは、オーケストラの調律に似ている

量子ビットを安定させることは、大勢の演奏家がいるオーケストラを完璧に調律することに似ています。これまでは、誰かが音を外しても曲が終わるまで気づけないことが多かった。ですが2026年の技術は、演奏中の一音一音を監視し、音程が外れた瞬間に補正する方向へ進んでいます。

これは派手なブレークスルーに見えないかもしれませんが、長く複雑な量子アルゴリズムを最後まで走らせるには欠かせない進化です。FTQCは、単なる理論ではなく、こうした運用技術の積み上げで初めて成立します。

| 方式 | 主要プレイヤー | 近年の焦点 | 戦略的特徴 |

|---|---|---|---|

| 超伝導 | Google、IBM、富士通/理研 | 検証可能性、忠実度、QEC接続、HPC連携 | 成熟度が高く、NISQ応用からFTQCへの橋渡しが進む。 |

| イオントラップ | IonQ、Quantinuum | 高忠実度、制御精度 | 「質」で強みを持ち、誤り制御との相性が良い。 |

| 中性原子 | QuEra、Caltech系、Harvard/MIT系 | 大規模配列、スケーラビリティ | 「規模」で存在感を持ち、QEC候補としても有望。 |

| トポロジカル | Microsoft | 物理層での耐性 | ハイリスクだが、成功すれば正面突破の可能性がある。 |

| ※ 2026年3月時点の公開情報をもとに整理。重要なのは「数」だけでなく、「質」「制御」「運用基盤」へ評価軸が広がっている点。 | |||

もう一つの主軸:日本の「量子産業化」はどこまで進んだか

日本の勝ち筋は、国産機だけでなく、量子を既存産業基盤に埋め込む設計力にある。

日本の量子戦略は、いまや「国内開発」と「国際連携」の二層で進んでいます。国産ハードウェアの自律性確保はもちろん重要ですが、それだけでは足りません。2026年時点でより重要になっているのは、量子を既存の計算基盤・産業データ・現場知見とどう結びつけるかです。

柱1:理研をハブにしたエコシステム構築

理研は、量子コンピュータとスーパーコンピュータを接続するハイブリッド環境の整備を進めています。これは単なる研究環境の整備ではなく、企業や研究機関がトラック1の実証を回すための土台になります。

柱2:国産ハードウェアとサプライチェーンの強化

大阪大学の国産超伝導量子コンピュータや、富士通・理研の量子開発は、技術自律性という観点で重要です。チップそのものだけでなく、冷凍機、制御系、ソフトウェア、周辺部材まで含めて国内の裾野を広げることが、量子産業の持続性を左右します。

柱3:量子HPCハイブリッドの国際協調

2026年3月には、理研とシンガポールのNQCHが量子HPCハイブリッド基盤に関する協力を進めるMoUを締結しました。ここが象徴的です。日本の強みは「全部を自前で抱え込むこと」ではなく、自国の製造・材料・医療・計算基盤の強みを、国際的な量子エコシステムの中で接続することにあります。

つまり日本の勝ち筋は、量子マシン単体で世界一を目指すことだけではありません。日本が得意な現場と量子をどう噛み合わせるか。そこに本当の差別化余地があります。

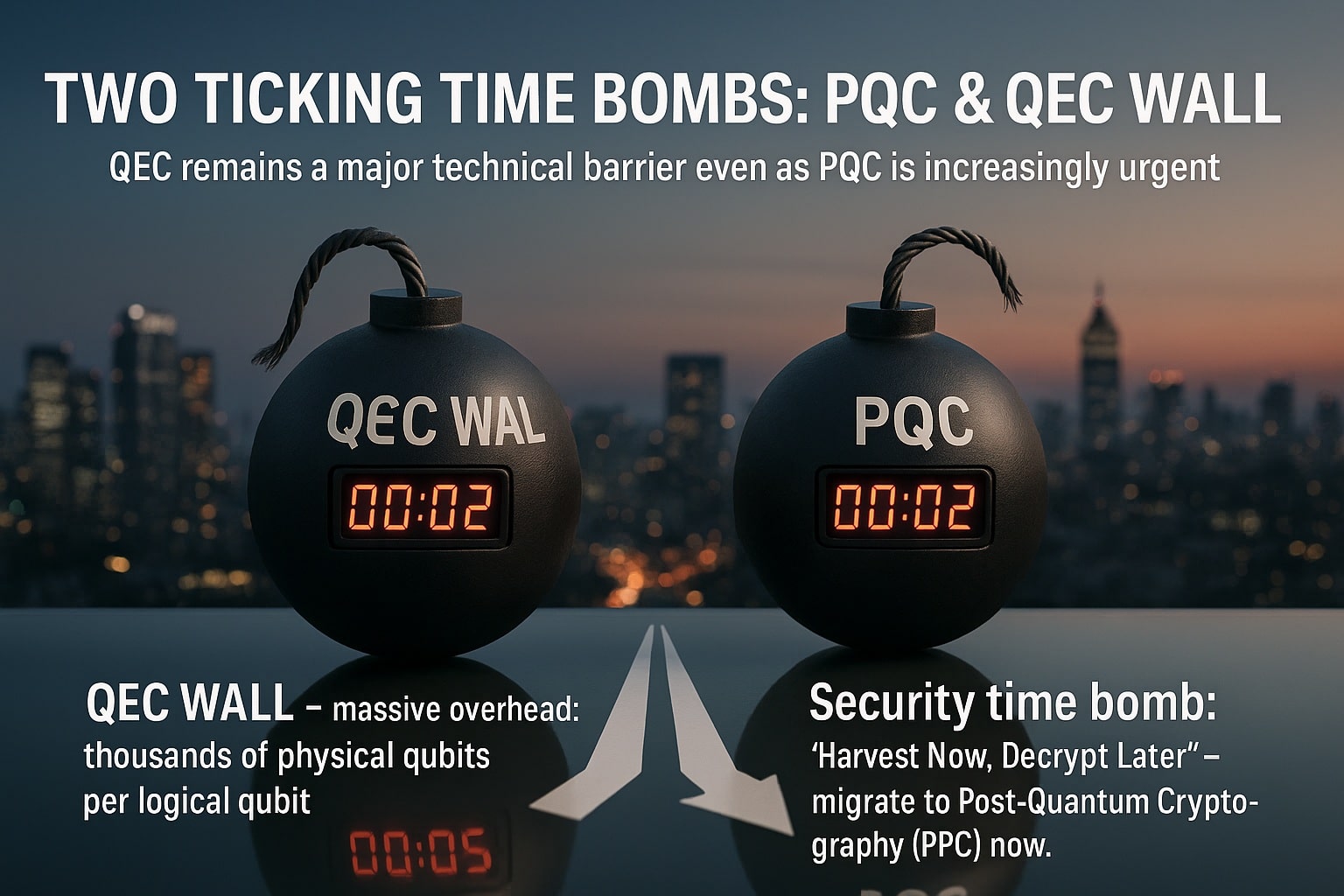

未来への「2つの時限爆弾」:QECの壁とPQC移行

実用化が近づくほど、技術課題とセキュリティ課題はむしろ重くなる。

2025年から2026年にかけて量子コンピューティングは大きく前進しましたが、問題が解決し尽くしたわけではありません。むしろ前進したからこそ、残された本丸がよりはっきり見えるようになりました。

QECの壁:最後の本丸

FTQCを本格的に実現するには、QECを大規模・長時間・安定的に回す必要があります。これは多数の物理量子ビットを束ね、リアルタイムで誤りを検出し、復号し、補正し続けるという極めて難しい課題です。進化的アプローチが成果を出した今でも、最終ゴールとしてのQECの重みはまったく変わっていません。

量子ビットを安定させる作業は、たとえるなら大人数のオーケストラを演奏中に調律し続けるようなものです。1人でも音程を外せば全体が崩れるのに、誰がいつ外れるかは一定ではありません。2026年の技術進歩は、この“演奏中の異変”をより細かく捉え、すぐに補正する方向へ進んでいます。

PQC移行:量子脅威は「いつか」ではなく「今」

もう一つの時限爆弾が、現在の暗号基盤への影響です。特にHNDL(Harvest Now, Decrypt Later)は、今盗んでおいた暗号化データを、将来の量子計算機で解読するという脅威であり、すでに現実のリスクとして語られています。

2026年、PQC移行は「いつか必要になる対策」ではなく、すでに始めていなければ遅れかねない移行テーマへ変わりつつあります。量子計算の進歩によって、2048ビットRSAの破壊に必要な推定リソースは長期的に減少してきたと指摘されており、論点は「量子コンピュータが本当に来るのか」ではなく、その前にCrypto-Agilityを確保できるかへ移っています。

CxO向け:PQCで今日から着手すべき3ステップ

- 1) 暗号資産の棚卸し:どのデータが、どの暗号方式で、どこに保存・流通しているかを可視化する。

- 2) 長期秘匿データの優先度付け:10年以上守る必要がある情報を最優先で洗い出す。

- 3) Crypto-Agilityの設計:暗号を差し替え可能なアーキテクチャにし、移行を継続的な運用課題として扱う。

まとめ:2025年は転換点、2026年は「意味が定まった年」

量子コンピューティングは、夢を語る時代から、どこに効くかを測る時代へ入った。

2025年は、量子コンピューティングの物語が大きく動いた年でした。長年の悪役であった「エラーの壁」に対して、Googleの量子エコーとIBMのエラー軽減が、QEC完成を待たずに使える価値を引き出す道を示したからです。

そして2026年は、その意味がさらに明確になった年です。重要なのは、量子が単に「速くなった」ことではありません。検証可能性、量子×HPC×AIのハイブリッド設計、リアルタイム制御という三つの軸が揃い始め、量子コンピューティングは“未知の可能性”から“測りながら使い始める技術”へ変わりつつあるのです。

もちろん、FTQCはまだゴールではありません。QECの壁は依然として大きく、PQC移行も待ったなしです。それでも、もはや量子は「もし来るなら」ではなく、「どの領域から先に現実化するか」を考えるべきフェーズに入りました。量子コンピューティングの未来は、遠い夜明けではありません。すでに朝日は昇り始めている。そう言える段階に来ています。

専門用語まとめ

- デコヒーレンス(Decoherence)

- 量子ビットの重ね合わせ状態が、外部ノイズによって壊れてしまう現象。量子計算エラーの最大要因であり、「エラーの壁」の中核。

- 検証可能な量子優位性(Verifiable Quantum Advantage)

- 量子コンピュータが古典計算を上回るだけでなく、その結果が意味ある計算として検証可能である状態。2025年のGoogleの成果で強く注目された。

- エラー軽減(Error Mitigation)

- 計算結果に含まれるノイズを統計的に見積もり、後から差し引くことで精度を高める手法。QECとは異なり、NISQ時代の現実的な精度向上策として重要。

- 量子誤り訂正(QEC)

- 量子ビットのエラーを検知・修正しながら計算を継続するための基盤技術。FTQC実現の本丸であり、膨大なオーバーヘッドが課題。

- PQC(耐量子暗号)

- 将来の量子コンピュータによる攻撃を前提に設計された新しい暗号方式群。移行は「将来対策」ではなく、すでに進めるべき実務課題になりつつある。

- HNDL(Harvest Now, Decrypt Later)

- 今は解読できない暗号化データを盗み、将来量子コンピュータが実用化した時点で解読する攻撃シナリオ。

- 量子HPCハイブリッド

- 量子コンピュータを単独で使うのではなく、HPCやAI基盤と組み合わせてアクセラレータとして運用する設計思想。2026年以降の実装の主戦場。

よくある質問(FAQ)

Q1.

エラー訂正とエラー軽減は何が違うのですか?

A1.

エラー訂正は計算中に誤りを検知・修正する技術で、エラー軽減は誤りがある前提で結果からノイズ成分を差し引く技術です。

- QECはFTQC実現の本丸であり、膨大なオーバーヘッドが必要です。

- エラー軽減はNISQ時代に使いやすい現実的な手法です。

関連:2025年秋の地殻変動へ

Q2.

2025年の成果は本当に「実用化」と言えるのですか?

A2.

全面的な実用化ではありませんが、特定分野で価値を出し始めた前哨戦とは言えます。

- Googleは検証可能な量子優位性を示しました。

- IBM/HSBCはビジネス課題で量子ワークフローの改善可能性を示しました。

関連:ロードマップへ

Q3.

2026年時点で量子コンピュータはどこまで現実になったのですか?

A3.

汎用FTQCは未完成ですが、量子とHPCとAIのハイブリッド運用を前提に、特定用途での現実味が大きく増しました。

- ポイントは「速さ」だけでなく「検証可能性」と「運用基盤」です。

- 2026年は量子単体競争より、組み込み方の競争が強まっています。

関連:量子は単独で勝たないへ

Q4.

量子コンピュータはスーパーコンピュータを置き換えるのですか?

A4.

少なくとも当面は置き換えるのではなく、スーパーコンピュータの中で使われるアクセラレータとして組み込まれていくと考えるのが自然です。

- 量子は得意な演算に集中し、HPCやAIが周辺処理を担います。

- このハイブリッド化が2026年の主流設計になりつつあります。

関連:量子とHPCの融合へ

Q5.

PQC対策は何から始めればよいですか?

A5.

まずは暗号資産の棚卸しを行い、長期秘匿データから優先してCrypto-Agilityを確保することが第一歩です。

- どのデータがどの暗号方式で守られているかを把握します。

- 10年以上守るべき機密情報を優先的に移行計画へ乗せることが重要です。

関連:QECの壁とPQC移行へ

参考サイト・出典

- Nature – Google’s demonstration of verifiable quantum advantage

- Google Blog – Quantum Echoes on Willow and verifiable quantum advantage

- Google Blog – Quantum hardware progress and verifiable advantage

- IBM Quantum Blog – IBM and HSBC demonstrate commercial quantum advantage in finance

- NVIDIA Newsroom – NVQLink and hybrid quantum-GPU computing

- RIKEN – Collaboration on hybrid quantum-HPC platform with Singapore NQCH

- Google Blog – The quantum era is coming: are we ready to secure it?

- IonQ News – Two-qubit gate fidelity milestone

あわせて読みたい

更新履歴

- 2025年1月15日:初版公開

- 2025年10月24日:Google Quantum Echoes、IBM/HSBC、IonQなどの情報を反映

- 2026年2月12日:数値表現・評価指標・FTQCの射程に関する記述を精緻化

- 2026年3月11日:量子×HPC×AIハイブリッド、理研NQCH連携、PQC移行の緊急性を追記し全体再構成

以上