※本記事は継続的に最新情報へアップデートしています。

SO-101で理解するNVIDIA Isaac|Sim2Realに渡す3つの情報とは?

ロボット開発の競争軸は、ハードウェア単体から「学習できるソフトウェア基盤」へ移りつつあります。しかし多くの人は、模倣学習で得たデータをそのままシミュレーターに入れればSim2Realができる、と誤解しがちです。

実際には、Sim2Realの入口はデータ投入ではありません。ロボットの身体、作業タスク、成功基準を定義し、学習可能な仮想世界を設計することです。

本記事では、安価なSO-101アームロボットを使って、NVIDIA Isaac型のPhysical AI設計思想を理解するための3つの情報を整理します。

✅ 先に結論

- Sim2Realの入口:BCデータの投入ではなく、学習可能な仮想世界の設計です。

- 渡すべき3情報:身体情報、タスク定義、成功基準をSim環境へ翻訳します。

- SO-101の価値:NVIDIA Isaac型のPhysical AI設計思想を安価に体験できる教材です。

何が変わったのか:ロボット開発は「書く」から「学ばせる」へ

変化の本質は、ロボットをプログラムする発想から、学習可能な環境を設計する発想への転換である。

従来のロボット開発では、人間が関節角度、条件分岐、動作シーケンスを細かく設計してきました。もちろん、今後も制御工学やシステム統合の知識は不可欠です。

しかし、Physical AIの世界では、ロボットがデータ、シミュレーション、評価基準を通じて動作を獲得する方向へ進みつつあります。ロボット企業の競争軸も、ハードウェア単体から、仮想空間で学習・検証・改善できるソフトウェア基盤へ移り始めています。

NVIDIAは2026年3月、ファナック、ABB Robotics、安川電機、KUKAがNVIDIA OmniverseライブラリとNVIDIA Isaacシミュレーションフレームワークを仮想コミッショニングへ統合し、物理的に正確なデジタルツインでロボットアプリケーションや生産ラインを開発・検証していると発表しました。

この変化は、ロボットを「どう動かすか」だけでなく、ロボットが「どう学べる世界を作るか」を問う時代への移行です。

従来型のロボット開発

従来型のロボット開発では、ロボットの動作を人間が明示的に設計します。対象物の位置、搬送経路、停止条件、安全条件を人間があらかじめ決め、想定どおりの環境で正確に動かします。

この方法は、安定した工場環境では強力です。一方で、対象物の位置が少しずれた、照明が変わった、摩擦が違った、対象物の形が微妙に異なった、といった変化には弱くなります。

Physical AI型のロボット開発

Physical AI型の開発では、ロボットにすべての動作を手続き的に書き込むのではなく、ロボットが学習できる環境を作ります。現実でデータを取り、仮想世界を定義し、シミュレーション内で大量に試し、最後に現実へ戻して補正します。

Physical AIの基本プロセス

- 現実で観察する:SO-101で模倣学習データを集める

- 仮想世界を作る:身体・タスク・成功基準をSim環境へ定義する

- 仮想世界で鍛える:Domain Randomizationや強化学習で汎化性能を高める

- 現実へ戻す:Fine-tuningで実機との差分を補正する

この流れを小さく体験するために、アープでは安価なSO-101アームロボットを活用しています。プロジェクト全体の背景は、AIロボット制作プロジェクト 正式キックオフで詳しく整理しています。

なぜ今重要なのか:SO-101で産業級Physical AIの設計思想を体験する

SO-101の価値は、安価な実機で産業級Physical AIの設計思想を小さく体験できる点にある。

SO-101は、Hugging Face LeRobot系で扱われる安価なアームロボットです。NVIDIAがSO-101というハードウェアを提供しているわけではありません。一方、NVIDIA Isaacは、Isaac Sim、Isaac Lab、Isaac GR00T、Cosmos、HALOSといった複数の要素を含む、産業級のPhysical AI開発スタックです。

つまり、SO-101とNVIDIA Isaacは同じものではありません。規模も、対象も、想定される利用環境も違います。

それでも、SO-101を学ぶ価値は大きいと考えています。なぜなら、ロボットに学習させる考え方そのものは共通しているからです。

| 比較項目 | SO-101 | NVIDIA Isaac型スタック |

|---|---|---|

| 位置づけ | 安価な実験・学習用アームロボット | 産業級のPhysical AI開発基盤 |

| 主な目的 | 模倣学習、Sim2Real、FTの設計パターンを小さく体験する | ロボットアプリケーションや生産ラインを仮想空間で開発・検証する |

| 学習上の価値 | 現実のデータ収集からSim環境設計までを手元で理解できる | 産業ロボット、デジタルツイン、合成データ、安全検証まで扱える |

| 共通点 | 現実で観察し、仮想世界を作り、仮想世界で鍛え、現実へ戻して補正する | |

| ※ SO-101はNVIDIA製ハードウェアではなく、NVIDIA Isaac型の設計思想を学ぶための実験教材として位置づけています。 | ||

アープがSO-101を使うのは、ロボットを遊びで動かすためではなく、これから主流になるPhysical AIの設計パターンを体験するためです。

実験環境の準備やPC、Ubuntu、Isaac Lab周辺の整理は、SO-101で始めるAIロボット制作の準備編で扱っています。本記事では、その次に多くの人が悩む「Sim2Realに何を渡すのか」に絞ります。

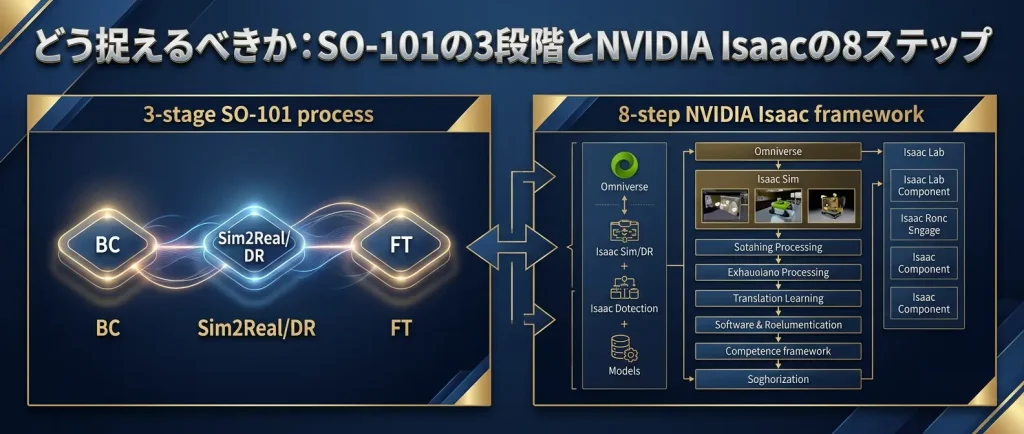

どう捉えるべきか:SO-101の3段階とNVIDIA Isaacの8ステップ

SO-101の3段階は、NVIDIA Isaac型の8ステップを学習しやすく圧縮した理解モデルである。

SO-101では、学習プロセスを大きく次の3段階で理解できます。

SO-101で体験する3段階

- BC:Behavior Cloning。人間の操作を模倣し、初期動作を学ぶ段階です。

- Sim2Real / DR:仮想世界で環境差分に強いポリシーを育てる段階です。

- FT:Fine-tuning。最後に実機へ戻し、現実との差分を補正する段階です。

Sim2Realとは、シミュレーションで学習・検証したモデルや制御方策を、現実世界のロボットで動作させるための技術体系です。

一方、NVIDIA Isaac型の開発スタックは、より産業実装に近い細かなステップで整理できます。本稿では、社内整理で用いている8ステップを、SO-101の3段階と対応させて理解します。

ここで登場するIsaac GR00Tはロボット向け基盤モデル、CosmosはPhysical AI向けの世界モデル群、HALOSは実機投入前後の安全検証・認証に関わる枠組みとして理解するとよいでしょう。本記事では、それぞれの詳細解説ではなく、SO-101の学習ステップとどう対応するかに絞って整理します。

| NVIDIA Isaac型の8ステップ | SO-101で体験する3段階 | 学習思想 |

|---|---|---|

| 要件定義 | BC前の設計 | 何を成功とし、何を危険とするかを決める |

| Omniverse | Sim2Real準備 | 作業空間・仮想工場・デジタルツインの土台を作る |

| Isaac Sim | Sim2Real準備 | ロボット、物理、センサー、接触、対象物を再現する |

| Isaac GR00T | 学習モデル・頭脳の導入 | SO-101ではBCポリシーや学習済みモデルに相当する理解でよい |

| Isaac Lab | Sim2Real中核 | 強化学習、模倣学習、Domain Randomization、評価を回す |

| Cosmos | Sim2Real拡張 | 世界モデルとして合成データや想定外条件を生成し、視覚差分・環境バリエーション・行動シミュレーションを通じてSim環境を強化する |

| HALOS | 安全検証 | 実機投入前後の安全性、監視、停止条件を確認する |

| 本番投入と改善ループ | FT | 実機へ戻し、現実差分を補正し続ける |

| ※ 出典:NVIDIA公開情報およびアープ社内整理をもとに作成(2026年5月時点)。 | ||

SO-101は安価なアームロボットですが、そこで学ぶのは産業ロボット企業が進めるPhysical AI開発の縮小版です。この前提を押さえることで、以降の「Sim2Realに渡す3つの情報」の意味が見えてきます。

実務ではどう判断するか:Sim2Realに渡す3つの情報

Sim2Realに渡すべきものはBCログそのものではなく、身体情報・タスク定義・成功基準である。

SO-101でBehavior Cloningを行うと、人間がリーダーアームを動かし、その動きをフォロワーアームが追従します。このとき、カメラ映像、関節状態、グリッパー操作、動作タイミングなどが時系列データとして記録されます。

ここで、多くの人が次のように考えます。

このBCデータをシミュレーターに入れれば、Sim2Realが始まるのではないか。

しかし、これは大きな誤解です。シミュレーターは、単なる学習モデルではありません。重力、摩擦、接触、関節、センサー、作業台、対象物、成功判定を持つ仮想の現実世界です。

BCデータをそのまま流し込んでも、シミュレーターは動きの「結果」しか受け取れません。しかし、シミュレーターが必要としているのは、「どの物理条件で」「どの環境で」「何を成功とするか」という世界の定義です。

BCデータは行動ログであって、学習可能な世界そのものではありません。Sim2Realで必要なのは、その行動ログから身体情報、タスク定義、成功基準を抽出し、仮想環境へ翻訳することです。

シミュレーターが学習できるためには、最低限3つの要素が必要です。

- 身体がなければ、ロボットは動けない。

- タスクがなければ、何をすべきか分からない。

- 成功基準がなければ、良い動作と悪い動作を判断できない。

この3つがそろって初めて、シミュレーション環境は「学習できる世界」になります。

| Sim2Realに渡す情報 | 役割 | 一言でいうと |

|---|---|---|

| 身体情報 | SO-101というロボットの身体を仮想空間に再現する | ロボットの身体 |

| タスク定義 | 何を、どこから、どこへ、どう動かすのかを定義する | 作業の舞台 |

| 成功基準 / Ground Truth | 何をもって成功・失敗と判定するのかを定義する | 学習の審判 |

| ※ BCデータは、この3情報へ翻訳するための材料であり、Sim環境へそのまま投入するものではありません。 | ||

身体情報:仮想SO-101を物理的に動かす

身体情報とは、SO-101を仮想空間の中で物理的に動かすためのロボット定義です。関節構成、リンク構造、可動域、グリッパー、質量、重心、カメラ配置、制御周期などを含みます。

ここで注意すべきなのは、身体情報はBCデータから直接生まれるものではないという点です。身体情報の基本は、SO-101そのものの物理仕様、組み立て情報、キャリブレーション、URDF/USDなどのロボットモデルから定義されます。

NVIDIA Isaac Simでは、URDFを取り込み、USDへ変換してシミュレーションパイプラインで使う流れが公式ドキュメントで説明されています。URDFはロボットモデルを表現する形式であり、仮想空間内で関節やリンクを扱うための入口になります。

| BCデータから確認できること | Sim環境での使い方 |

|---|---|

| 実際によく使う関節角の範囲 | 関節可動域や初期姿勢の妥当性を確認する |

| グリッパーの開閉タイミング | 把持動作やアクション空間の設計に使う |

| 動作周期や遅延の傾向 | 制御周期、シミュレーションステップ、実機との差分確認に使う |

| カメラに映るアームと対象物の関係 | センサー配置、視野角、観測空間の設計に使う |

Sim2Realで最初に必要なのは、BCで学んだモデルではなく、仮想空間の中に物理的に意味のあるSO-101を立ち上げることです。

タスク定義:何をどこからどこへ動かすか

タスク定義とは、ロボットが何を、どこから、どこへ、どの制約の中で動かすのかを決める設計情報です。

たとえば、SO-101で「キューブを掴んで箱に入れる」タスクを行うなら、シミュレーター内には、対象物、初期位置、目標位置、作業台、カメラ、初期姿勢、制限時間、禁止条件などが必要になります。

| BCで観察するもの | タスク定義への翻訳 |

|---|---|

| 対象物の位置 | 初期位置とランダム化範囲 |

| 手先の移動経路 | 作業空間と危険領域 |

| 把持のタイミング | グリッパー操作の条件 |

| 置く場所 | 目標領域 |

| 失敗しやすい動作 | 禁止条件、失敗条件 |

タスク定義がなければ、仮想空間に「何を学習すべきか」が存在しません。ロボットの身体だけがあっても、机も物体も目標もなければ、学習は始まりません。

成功基準:良し悪しを判断する審判

成功基準とは、ロボットの行動をシミュレーターが自動評価するための審判です。3つの情報の中で、ここがSim2Realにおける最大の山場です。

強化学習では、ロボットに「この動きを真似しなさい」と動画を渡すだけでは不十分です。必要なのは、ロボットの行動を評価するルールです。

| 判定項目 | 例 |

|---|---|

| 成功条件 | キューブが箱の中に入った |

| 中間評価 | グリッパーがキューブに近づいた、把持した、持ち上げた |

| 失敗条件 | キューブを落とした、机から落とした、時間切れになった |

| 危険条件 | 関節限界、過大接触、禁止領域侵入 |

| 終了条件 | 成功、失敗、タイムアウト |

ここで必要になるのがGround Truthです。Ground Truthとは、シミュレーターが内部的に持っている真の状態です。たとえば、対象物の3D座標、箱の中に入ったかどうか、グリッパーとの接触状態、机外へ落下したかどうかなどです。

BCの成功例は、シミュレーターに再生する正解動画ではありません。何を成功と呼ぶべきかを設計するための参照基準です。

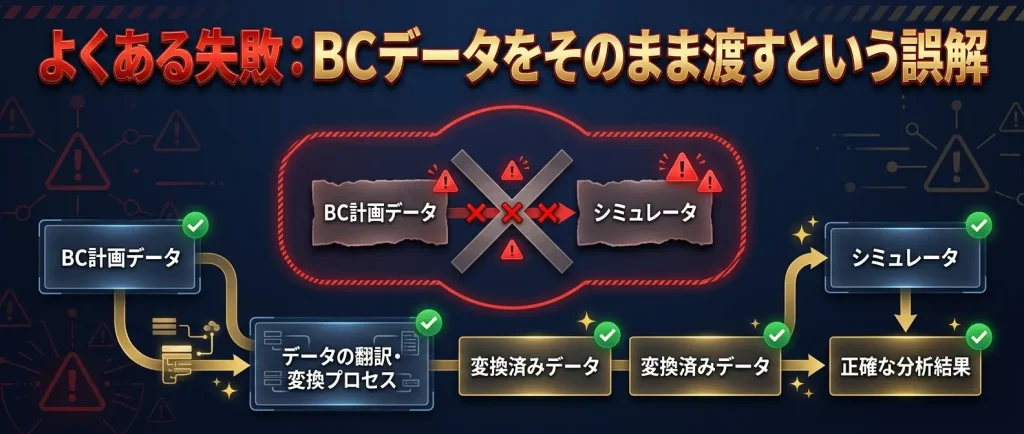

よくある失敗:BCデータをそのまま渡すという誤解

最大の失敗は、BCデータを学習可能な世界そのものだと誤解することである。

BCデータは重要です。ただし、BCデータは行動ログです。行動ログには、ある環境で人間がどう動かしたかという結果が記録されています。

一方、シミュレーターが必要としているのは、結果だけではありません。ロボットの身体、作業空間、物理条件、対象物、成功条件、失敗条件、報酬設計が必要です。

この違いを理解しないままSim2Realへ進むと、次のような失敗が起きます。

| 失敗パターン | 原因 | 回避策 |

|---|---|---|

| BCログをそのまま再生しようとする | シミュレーターを学習器と誤解している | BCログを身体・タスク・成功基準へ翻訳する |

| ロボットモデルだけ作って学習が進まない | タスク定義や成功条件が不足している | 対象物、目標位置、終了条件を明確にする |

| Domain Randomizationだけ先に行う | ランダム化すべき世界が未定義である | 机、物体、カメラ、摩擦、成功条件を先に定義する |

| FTの位置を前段に置いてしまう | Sim2Real後の現実補正という役割を誤解している | FTは実機へ戻した後の補正工程として扱う |

Sim2Realの入口は、データ投入ではありません。ロボットが学習できる世界を設計することです。

Behavior Cloning、Sim2Real、Fine-tuningの全体像は、SO-101で学ぶPhysical AI|Behavior CloningからSim2Real・Fine-tuningまでで整理しています。

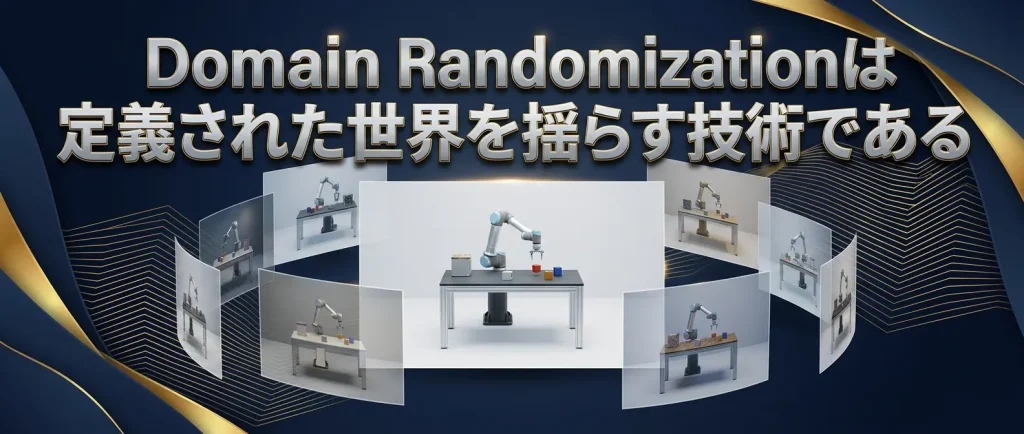

Domain Randomizationは定義された世界を揺らす技術である

Domain RandomizationはSim2Realそのものではなく、定義済みの仮想世界を揺らす代表的な手段である。

Sim2Realと聞くと、多くの人はDomain Randomizationを思い浮かべます。Domain Randomizationとは、シミュレーション内で照明、物体の位置、色、背景、スケール、摩擦などを意図的に変化させることで、現実世界の変化に強いモデルを作る方法です。

ただし、ここでも大切な前提があります。

ランダム化できるのは、先に定義された世界だけです。

机が定義されていなければ、机の摩擦は変えられません。カメラが定義されていなければ、視野角や照明条件は変えられません。対象物が定義されていなければ、初期位置をランダム化できません。成功条件が定義されていなければ、どのランダム環境で成功したのか評価できません。

したがって、Sim2Realの入口はDRではありません。Sim2Realの入口は、身体情報、タスク定義、成功基準をそろえた仮想世界の設計です。DRは、そのあとに行う汎化性能強化の手段です。

CosmosやHALOSはどこに入るのか

SO-101でPhysical AIの基本を学ぶ段階では、まずBC、Sim2Real、FTの3段階で十分です。ただし、NVIDIA Isaac型の産業級ワークフローを理解するなら、CosmosやHALOSの位置づけも押さえておく必要があります。

Cosmosは、単に背景や照明を増やすだけのデータ拡張ツールではありません。NVIDIAはCosmosを、Physical AI向けのWorld Foundation Modelsとして位置づけており、合成データ生成、物理世界の理解、行動シミュレーションを支える基盤として展開しています。2026年3月には、合成世界生成、Physical AI reasoning、action simulationを統合するCosmos 3も予告されています。

一方、HALOSはFTではありません。HALOSは、実機投入前後の安全検証、監視、停止条件、認証の考え方に関わるレイヤーです。

Cosmosは仮想世界をより豊かにし、HALOSは現実投入時の安全性を支えるものです。どちらもSim2Realを実運用へ近づけるために重要ですが、SO-101で最初に理解すべき核心は、身体情報・タスク定義・成功基準の3つです。

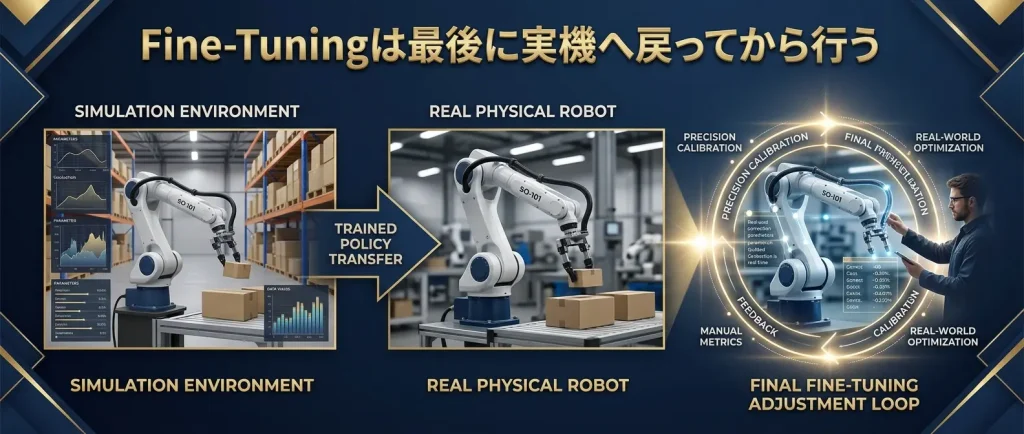

Fine-tuningは最後に実機へ戻ってから行う

Fine-tuningはSim2Real前の準備ではなく、実機へ戻して現実差分を補正する工程である。

FTは前段ではありません。FTは、シミュレーションで鍛えたポリシーを実機へ戻したあとに行う現実補正です。

どれだけ精密に仮想世界を作っても、現実とのズレは残ります。カメラの癖、モーター遅延、関節の遊び、摩擦、照明、対象物の微妙な違い。これらは、完全には消せません。

だからこそ、最後に実機へ戻し、少量の実機データで補正します。これがFTです。

FTの正しい位置づけ

- BC:人間の成功動作を観察し、初期ポリシーや設計材料を得る

- Sim環境構築:身体情報、タスク定義、成功基準を定義する

- Sim2Real / DR:仮想世界で汎化性能を高める

- 安全検証:実機投入前に危険動作や停止条件を確認する

- FT:実機へ戻し、現実との差分を補正する

FTはSim2Realの前にあるのではなく、Sim2Realで鍛えたものを現実へ戻したあとにあります。この位置づけを間違えると、Sim2Real全体の理解が崩れます。

一次情報からどこまで言えるか

SO-101とNVIDIA Isaacは同一ではなく、共通するのはロボット学習の設計思想である。

一次情報で確認できること

NVIDIAは、主要ロボット企業がOmniverseライブラリとIsaacシミュレーションフレームワークを仮想コミッショニングへ統合していると発表しています。また、Isaac SimはURDFの取り込み、Isaac Labはロボット学習ワークフローを扱う公式フレームワークとして公開されています。

Hugging FaceのLeRobotドキュメントでは、SO-101がリーダーアームとフォロワーアームを使うロボットアームとして説明されています。テレオペレーション、記録、評価といった模倣学習の実践に使える構成です。

本記事における解釈

本記事の独自視点は、SO-101をNVIDIA Isaacそのものとして扱うことではありません。SO-101を、NVIDIA Isaac型のPhysical AI設計思想を小さく体験する教材として位置づけることです。

一次情報から言える事実と、本記事の解釈を分けることが、Physical AI記事の信頼性を高めるうえで重要です。

まとめ

読者が持ち帰るべきなのは、Sim2Realの入口はデータではなく世界設計であるという理解である。

SO-101で学ぶ価値は、安価なロボットアームを動かすことではありません。Physical AI時代の設計パターンを、手元の小さな実機で体験できることです。

本記事では、SO-101を使ってNVIDIA Isaac型のPhysical AI開発を理解するために、Sim2Realへ渡す3つの情報を整理しました。

| 3つの情報 | 意味 | Sim環境での役割 |

|---|---|---|

| 身体情報 | SO-101の関節、リンク、可動域、グリッパー、カメラなど | 仮想SO-101を物理的に動かす |

| タスク定義 | 何を、どこから、どこへ、どの制約で動かすか | ロボットが学ぶ作業舞台を作る |

| 成功基準 | 何をもって成功・失敗と判定するか | 報酬関数、終了条件、評価指標になる |

BCデータは、Sim2Realに流し込む燃料ではありません。BCから抽出した「身体」「タスク」「成功基準」を、シミュレーション環境に翻訳するための材料です。

身体情報があるから、仮想SO-101が動きます。タスク定義があるから、ロボットが何をすべきか分かります。成功基準があるから、強化学習が良い行動と悪い行動を区別できます。

この3つがそろって初めて、Domain Randomizationも、Isaac Labでの学習も、Fine-tuningも意味を持ちます。

SO-101とNVIDIA Isaacでは、規模もツールも違います。しかし、ロボットに学習させる考え方は同じです。現実から学び、仮想世界を作り、仮想世界で鍛え、最後に現実へ戻して補正する。この流れを理解することが、Physical AI時代のエンジニアにとって重要な第一歩になります。

専門用語集

本記事で使う専門用語は、Sim2Realの理解に直結するため、意味と役割を簡潔に整理しておく。

Physical AIやSim2Realでは、似た用語が多く登場します。ここでは、SO-101でNVIDIA Isaac型の学習思想を理解するうえで、特に重要な用語を整理します。

| 用語 | 意味 | 本記事での位置づけ |

|---|---|---|

| Physical AI | 現実世界の物体、環境、身体を扱いながら動作するAIの総称 | SO-101やNVIDIA Isaacで学ぶロボットAI開発の大きな枠組み |

| SO-101 | Hugging Face LeRobot系で扱われる安価なアームロボット | NVIDIA Isaac型の設計思想を小さく体験するための教材 |

| LeRobot | ロボットのデータ収集、模倣学習、評価などを扱うオープンソース系ライブラリ | SO-101を使った模倣学習や実機評価の基盤 |

| BC / Behavior Cloning | 人間の操作データを手本にして、ロボットの行動を学習する模倣学習手法 | SO-101で最初に行う「成功動作を見せる」工程 |

| Sim2Real | シミュレーションで学習・検証したモデルや制御方策を、現実世界のロボットで動作させるための技術体系 | 本記事の中心テーマ。BCデータを直接流すのではなく、仮想世界を設計する工程 |

| DR / Domain Randomization | シミュレーション内の照明、摩擦、物体位置、カメラ条件などを意図的に揺らす技術 | Sim2Real Gapを縮める代表的な手段。ただしSim2Realそのものではない |

| FT / Fine-tuning | 学習済みモデルを、少量の実機データで現実環境に合わせて微調整する工程 | Sim2Real後に実機へ戻して行う現実差分の補正作業 |

| URDF | ロボットのリンク、関節、可動域、質量などを記述するロボットモデル形式 | SO-101の身体情報をSim環境へ渡すための基礎データ |

| USD / OpenUSD | 3Dシーン、ロボット、環境、物理情報などを表現・交換するためのデータ形式 | Isaac SimやOmniverseで仮想環境を構築する際の中核的な表現形式 |

| Isaac Sim | NVIDIA Omniverse上で動作するロボットシミュレーション環境 | 仮想ロボット、物理、センサー、接触、対象物を再現する場 |

| Isaac Lab | Isaac Sim上で強化学習、模倣学習、タスク設計、評価を扱うロボット学習フレームワーク | Sim2Realの中核となる学習・評価ループを回す基盤 |

| Isaac GR00T | NVIDIAが展開するロボット向けビジョン言語行動モデル群(GR00T N1.7が商用公開済み) | ロボットの「頭脳」に相当するモデル層として理解する |

| Cosmos | Physical AI向けのWorld Foundation Models群 | 合成データ、想定外条件、視覚差分、行動シミュレーションを通じてSim環境を強化する |

| HALOS | NVIDIAが展開するPhysical AI向けの安全検証・認証に関わる枠組み | 実機投入前後の安全性、監視、停止条件を考えるレイヤー |

| Ground Truth | シミュレーター内部で取得できる真の状態情報 | 成功・失敗判定、報酬設計、評価指標を作るための基準 |

| 報酬関数 | ロボットの行動に点数を与え、良い行動へ誘導するための評価式 | 強化学習で「何を良い動作とするか」を教える仕組み |

| Sim2Real Gap | シミュレーション環境と現実世界の差分 | DRやFTで縮めるべきズレ。摩擦、照明、遅延、カメラ差分などが含まれる |

| ※ 本用語集は、本記事内での理解を助けるための簡易整理です。厳密な仕様や実装詳細は各公式ドキュメントを確認してください。 | ||

特に重要なのは、BC、Sim2Real、DR、FTを混同しないことです。BCは成功動作を観察する工程、DRは定義済みの仮想世界を揺らす工程、FTは最後に実機へ戻して現実差分を補正する工程です。

参考文献 / 出典

一次情報

- NVIDIA – NVIDIA and Global Robotics Leaders Take Physical AI to the Real World

- Hugging Face LeRobot Documentation – SO-101

- Hugging Face LeRobot Documentation – Imitation Learning on Real-World Robots

- NVIDIA Isaac Sim Documentation – Import URDF

- NVIDIA Isaac Lab

- NVIDIA Cosmos

- NVIDIA – NVIDIA Expands Open Model Families to Power the Next Wave of Agentic, Physical and Healthcare AI

- NVIDIA – Halos Certification

関連記事・社内実践記事

次に読むならこの3本

補足Q&A

Q1.

SO-101はNVIDIAのロボットですか?

A1.

SO-101はNVIDIAが提供するロボットではありません。

本記事では、Hugging Face LeRobot系で扱われる安価なアームロボットとしてSO-101を使い、NVIDIA Isaac型のPhysical AI設計思想を理解する教材として位置づけています。

Q2.

BCデータはSim2Realでまったく使わないのですか?

A2.

BCデータは使いますが、そのままシミュレーターへ流し込むわけではありません。

BCデータから、身体情報の検証、タスク定義、成功基準、失敗条件、初期位置、目標領域などを抽出し、Sim環境を設計する材料として使います。

Q3.

Domain RandomizationとSim2Realは同じですか?

A3.

Domain RandomizationはSim2Realそのものではなく、Sim2Real Gapを縮める代表的な手段の一つです。

Sim2Real全体には、仮想環境の構築、タスク定義、報酬設計、学習、評価、安全検証、実機でのFine-tuningまでが含まれます。

更新履歴

- 2026年5月14日:初版公開。