※本記事は継続的に「最新情報にアップデート」を実施しています。

SO-101で始めるAIロボット制作の準備編|機材購入・PC・Ubuntu・Isaac Lab環境構築

SO-101でAIロボット制作を始めたいが、何を買い、どんなPCを用意し、UbuntuやIsaac Labをどう整えればよいか迷っていませんか?

2026年、LeRobot系の低コストアーム SO-101(国内ではSO-ARM101とも呼ばれます) とNVIDIA Isaac Labの組み合わせにより、AIロボット制作は個人でも現実的に挑戦できる領域へ近づいてきました。

この記事では、機材購入、ホストPC要件、Ubuntu 24.04環境、NVIDIA Driver/CUDA、Isaac Sim / Isaac Lab導入まで、挫折しにくい準備の最短ルートを整理します。

本記事の最初の到達点は、SO-101を安全に動かせる機材を揃え、ホストPCにUbuntuとIsaac Sim / Isaac Labの土台を整え、次の学習編へ進める状態を作ること。

✅ この記事の結論(TLDR)

- 最重要結論:SO-101を起点に、機材・PC・Ubuntu・Isaac Sim / Isaac Labの土台を整えれば、個人でもAIロボット制作の出発点に立てます。

- 機材の要点:Raspberry Pi 5は「8GB版」が必須。 SO-101(SO-ARM101)系はコントローラ基板を介してPCへ直接USB接続する構成のため、XIAO等のマイコンを別途購入する必要はありません。

- 環境の黄金律:Windowsを壊さず専用SSDに「ネイティブUbuntu環境」を構築し、Isaac Sim / Isaac Labを公式のpipルートで導入することが成功の最短ルートです。

1. この準備編でわかることと到達点

SO-101でAIロボット制作を始める前に、何を買い、どこまで環境を整えれば次の学習編に進めるかを整理する章です。

【導入:まず必要なのは「学習」より「土台」】

現代のロボティクスでは、学習アルゴリズムそのものに注目が集まりがちです。

しかし実際には、その前段階である「機材の揃え方」「PC環境」「OS」「GPUドライバ」「シミュレーション基盤」の整備が不十分だと、後続の学習工程は簡単に止まります。

本記事は、AIロボット制作シリーズの準備編です。

10万円前後の低コストな実機から出発し、まずは再現性のある実験環境を作るために必要な機材と学習基盤を整えます。

本記事では、Hugging Faceが公開したオープンアーム SO-101(国内流通ではSeeed Studio製の SO-ARM101 として知られるモデル)を対象とします。 以降は名称を SO-101 に統一して解説します。

【結論:ここで整えるべきもの】

この準備編で整えるべき成果物は、単なる購入リストではありません。

安全に使える実機構成、安定して動くホストPC、Windowsを壊さずに共存できるUbuntu環境、そしてIsaac Labへ進めるGPU学習基盤です。

ここまで整えば、次の学習編であるBehavior Cloningや、その先のSim2Realへ進むための土台が完成します。

2. 機材購入と初期セットアップの全体像

まずは、SO-101を安全かつ再現性高く動かすための最小構成を揃えることから始めます。

1. 目的

本記事の最優先事項は、実機での高度な学習成果を急ぐことではなく、SO-101を安全かつ再現性高く動かすための初期環境を整えることです。

まずは、実機・カメラ・電源・固定具・ホストPCという土台を崩れない形で揃えます。

- 最初の到達点:SO-101を組み立て、安全に固定し、視覚入力と制御が行える最小構成を作ること。

- 成功の定義:次の学習編であるBehavior Cloningへ無理なく進める環境が整っていること。

2. 基本セットとして揃える購入機材一覧(詳細)

※記載の商品コードをクリックすると、秋月電子通商等の販売ページへ移動できます。

※記載の価格は2026年時点の通販価格の一例(税込)です。為替や販売代理店により変動するため、最新価格は必ずリンク先の販売ページをご確認ください。

.jpg)

① アームの「骨格と筋肉」:SO-101システム

本プロジェクトの主役となるロボットアーム一式です。リーダーとフォロワーの両方を含む構成は、Behavior Cloningによるデータ収集と、その後の自律動作検証の出発点になります。特に3Dプリントパーツは、このシステムの骨格を支える必須要素です。在庫があるうちに確保しておくと、後工程の停滞を避けやすくなります。

| 商品コード | 品名 | 価格 (目安) | 役割・確保すべき理由 |

|---|---|---|---|

| [131228] | SO-101 ロボットアームキット Pro版 | ¥43,800 前後 | 最重要。 リーダーとフォロワー両方のモーター、基板、電源アダプタ一式。 |

| [131222] | SO-101 3Dプリントパーツ | ¥7,280 前後 | 必須。 モーターを固定するプラスチック骨格。これが売り切れると自作の手間が激増します。 |

② 並行して確保すべき「脳」と「目」

| 商品コード | 品名 | 価格 (目安) | 役割 |

|---|---|---|---|

| [130282] | Raspberry Pi 5 / 8GB | ¥25,190 前後 | メインの脳。 8GBを推奨。AI推論とロギングをラグなく実行するための「必須スペック」です。 |

| [118451] | Pi 5用 電源アダプター (27W) | ¥2,310 前後 | 脳の電源。 安定した動作(5V 5A供給)に必須です。 |

| [OBTS42] | Raspberry Pi カメラモジュール V3 | ¥5,940 前後 | 目。 これがないと「見て動く」視覚入力が成立しません。※エレショップ等で確保推奨 |

SO-101(SO-ARM101)系は、基本的にキットに同梱される制御基板(バスサーボドライバーボード)とUSB接続で始められるのが基本です。

旧世代(SO-100等)では追加でXIAOマイコン周りを揃えるケースがありましたが、本記事の構成では別途購入する必要はありません(※同梱物は販売ページで要確認)。

また、AI推論とデータロギングを同時に行う際、メモリの余裕が制御のリアルタイム性に直結するため、Raspberry Pi 5は8GB版を「必須構成」として指定しています。

③ 安全と運用のための「最小構成」仕上げ

| 商品コード | 品名 | 価格 (目安) | 理由 |

|---|---|---|---|

| [100657] | 非常停止スイッチ (E-Stop) | 約¥1,000 | 必須項目。 万が一の暴走時に物理的に止めるための装備。 |

| [105315] | 強力クランプ (×2個) | ¥440 前後 | 精度確保。 アームを机にガッチリ固定するために不可欠です。 |

まずは [131228] と [131222] を秋月電子のカートに入れて確保してください。

特に 3Dプリントパーツ [131222] は、一度売り切れると入荷に時間がかかる傾向があります。

3. 購入後すぐに進める初期セットアップ手順

AIロボット制作の成否は、学習アルゴリズムだけでなく、最初にどれだけ安定した作業環境を作れるかで大きく決まります。

ここでは、購入後すぐに着手すべき順番を整理します。

❶まずやること:機材確保と標準化

秋月電子等でコア機材を確保します。 特に「3Dプリントパーツ」は欠品するとすべての工程がストップするため、最優先のアクションとなります。

この期間に、ネジの締め具合やケーブルの取り回しといった「物理的な標準」を策定します。

また、デスクに固定したカメラ(三人称視点)で全体を捉える「視覚の確保」を行い、「何がどこにあるか」をAIに教え込む準備を整えます。

❷次にやること:カメラ・PC・アームの接続確認

Behavior Cloning(模倣学習)を用いた、データ収集から推論までの最小構成動作を確認します。

教示(デモ収集)では、人間がリーダーアームを手で動かし、AIにお手本を見せます。

ここで重要なのが「50回の魔法」です。 たった50回〜100回の動作でも、1秒間に20枚の写真を撮るカメラ(目)のおかげで、AIにとっては数万コマの貴重な学習データ(ステップ数)になります。

この段階では高い精度を求めるのではなく、システム全体(カメラ→PC→アーム)のパイプラインが正常に「通る」ことを最優先のマイルストーンとします。

❸余裕があれば:初回動作確認と失敗要因の洗い出し

意図的に照明の明るさを変えたり、アームの初期位置を数センチずらしたりすることで、「AIがなぜ失敗するのか」を分析します。

この「あえて失敗させる」プロセスを通じて得られるデータこそが、AIモデルを強固にするための重要な資産となります。

➍仕上げ:再現用メモとトラブルシュートの整備

誰でも再実行できる詳細な手順書と、トラブルシューティング表を整備します。

合格試験として「同一条件で3回連続成功」を達成し、この実績を次のシミュレーション構築フェーズにおける「正解データ(Ground Truth)」として確定させます。

3. ホストPC・Ubuntu・Isaac Labの環境構築

自宅PCを「ロボット専用GPUワークステーション」に変えるための実践ガイド。

すべての始まりは、強力な学習基盤(ホストPC)の構築です。

ここから先は、自宅PCを「ロボット専用GPUワークステーション」に変える儀式です。

E2E学習およびシミュレーション(Isaac Lab)を実行するためのPCは、既存のWindows資産を流用しますが、Windowsを壊さずに、Isaac Labがフルパワーで回るネイティブUbuntu環境を構築します。

ロボット制御はUSBシリアル等を含むI/Oが密接に絡むため、USBデバイス認識・GPUドライバ・リアルタイム性の観点で、ネイティブUbuntuが黄金律となります。

WSL2や仮想環境ではハードウェアへのダイレクトアクセスが制限され、デバッグ不能なトラブルを招く恐れがあるため、専用環境の構築を強く推奨します。

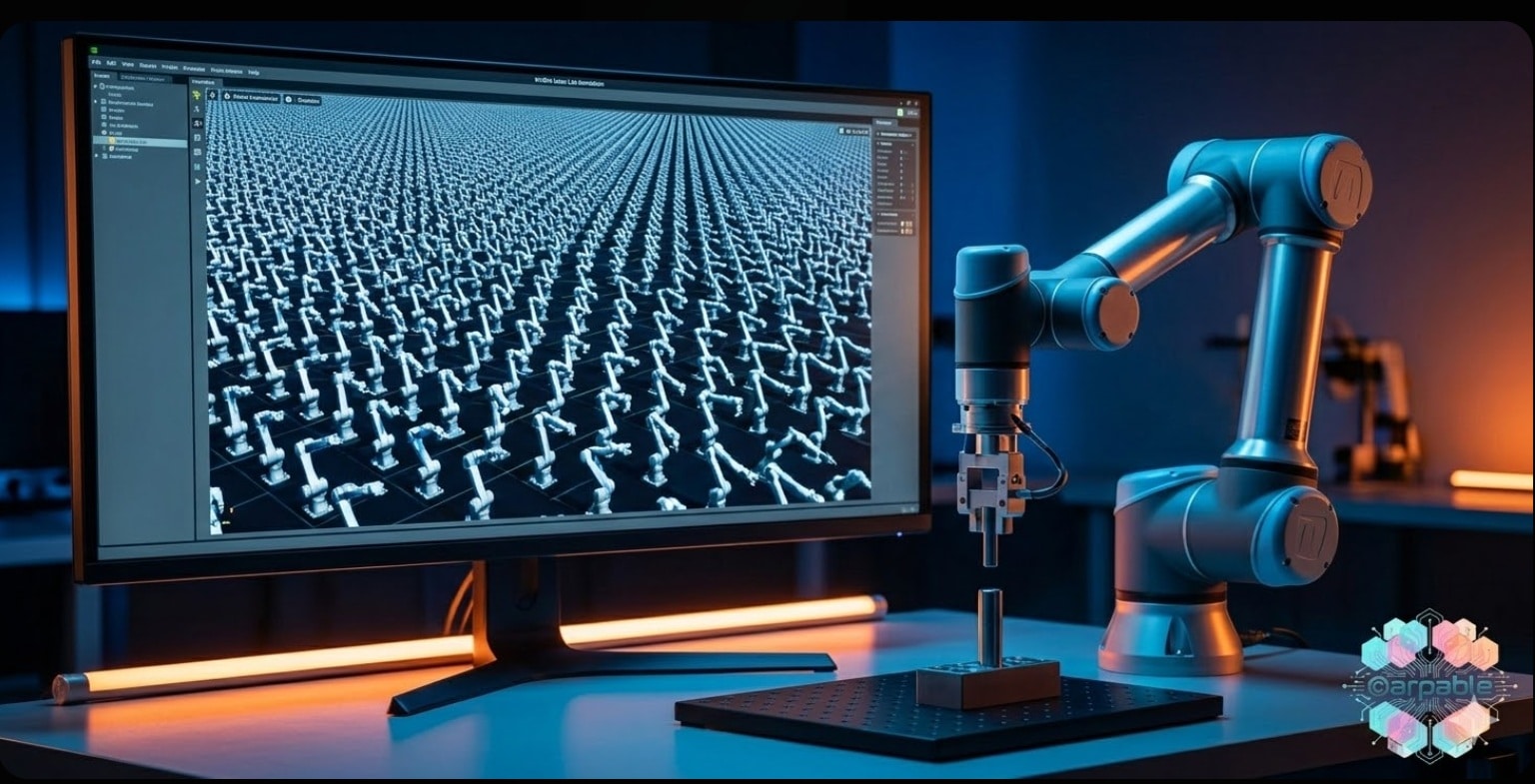

Isaac Simは、NVIDIA Omniverse上で動くロボット向け3Dシミュレータ本体です。高精度な物理演算、センサーシミュレーション、3Dシーン表現を担当します。

Isaac Labは、そのIsaac Simを土台として、強化学習や模倣学習などでロボットの「ポリシー(挙動ルール)」を鍛えるための学習フレームワークです。

本記事では、現実のSO-101をIsaac Simでデジタルツイン化し、その上でIsaac Labを用いて知能を育てるという2段構えを前提に、環境構築のステップを解説していきます。

Isaac Sim 5.x 系をpipで導入する場合、Python 3.11の仮想環境を先に用意する必要があります。Python 3.10や3.12では、Isaac Lab実行時にエラーとなる可能性があります。

また、pipルートでの導入はGLIBC 2.35以上が前提です。本記事でUbuntu 24.04を推奨しているのは、この互換性要件も踏まえています。

なお、2026年3月時点ではIsaac Sim 6.0 Early Developer Releaseが公開されていますが、現時点ではGA版未公開のため、本記事では安定した公開手順が整っているIsaac Sim 5.1系を前提に進めます。

① ハードウェア構成比較:最小構成 vs 推奨構成

予算が限られた個人開発者向けに最小構成も紹介しておきます。

そこで、まずは始めたい方向けの「最小構成(なんとか動く)」と、Sim2Realを完遂するための「推奨構成(ストレスなく回る)」の比較表を提示します。

| 項目 | 最小構成(まずは始めたい方向け) | 推奨構成(Sim2Realを完遂したい方向け) |

|---|---|---|

| GPU | NVIDIA RTX 3060 / 4060 (VRAM 12GB以上) | NVIDIA RTX 4080 / 5080 (VRAM 16GB以上) |

| CPU | 6コア / 12スレッド 以上の近代的なCPU | 8コア / 16スレッド 以上の高性能CPU |

| メモリ | 32GB (DDR4 / DDR5) | 64GB (DDR5 推奨) |

最小構成を選択する際の注意点(制約事項)

RTX 3060クラス(VRAM 12GB前後)の最小構成でも、小〜中規模の単一タスク検証であれば、AIロボット制作の出発点として十分に現実的です。

一方で、家庭内の複数タスクや高難度操作、大きめの並列学習まで本格的に回したい場合は、VRAM 16GB以上(RTX 4080 / 5080クラス)の推奨構成を前提にした方が、開発サイクルのストレスが大きく減ります。

❶並列学習数の制約

最小構成では、Isaac Labの強みである大規模並列をフル活用するには限界があります。多数並列を前提にするほど、VRAM容量の差が学習速度と試行回数に直結します。

❷物理演算と周辺処理の余裕

CPUコア数やメモリ容量に余裕がない構成では、ROS2の複数ノード、センサー処理、シミュレータの物理演算が競合しやすくなります。結果としてFPSが下がり、学習・検証サイクル全体が鈍くなることがあります。

② CPU選定のポイント:Intel CPUでも良いのか?

CPU選択のキーポイントは「マルチコア/スレッド性能」です。

「Ryzen 7 9700X」以外に、IntelのCPU(Core i7-13700K / i9 等)でも、第13世代以降の近代的なモデルであれば全く問題ありません。

推奨は「8コア / 16スレッド以上」を確保することです。

物理シミュレーションの計算と、ROS 2の複数ノードによる非同期通信をラグなく回すためには、スレッド数の余裕が安定性に直結します。

③ ハイブリッド開発:自宅と職場の使い分け

読者の「自宅でデータ収集、会社で学習」というニーズは非常に現実的です。

シミュレーション学習は、必ずしも実機アームと常時接続されている必要はありません。

自宅で収集した「生データ(画像と関節角度)」を高性能な計算資源(会社のPCやクラウド)へ持ち込み、そこで鍛え上げた知能を再び自宅の実機に持ち帰る。

この「知能の輸出入」こそが、個人開発におけるSim2Realの現実的な勝利条件です。

④ Ubuntu 24.04 LTS 構築ステップ

最も安全で推奨される方法は、「学習専用のSSDを増設し、そこにUbuntuを入れる」ことです。

既存のWindows環境を完全に切り離して保持できるため、最高レベルのパフォーマンスと安定性を維持できます。

ステップ1:インストールメディアの作成

- ISOの準備:Ubuntu公式サイトより「Ubuntu 24.04 LTS Desktop」をダウンロード。

- 書き込みツールの使用:Rufus 等を使用し、USBメモリにISOを書き込みます。

ステップ2:BIOS/UEFIの設定変更

- Secure Bootの無効化:[Disabled] に設定。ドライバ認識の障害を防ぎます。

- 起動順序:USBメモリを1番目に設定。

ステップ3:Ubuntuのインストール実行

- インストールの種類:Windowsを残す場合は「alongside Windows Boot Manager」を選択。

- サードパーティ製ソフトウェア:インストール中のドライバ導入チェックを必ず入れます。

⑤ インストール後の重要設定(NVIDIA Driver & CUDA)

インストール完了後、ターミナルで以下のコマンドを実行し、環境が整ったことを確認しましょう。

# 推奨ドライバの確認 sudo ubuntu-drivers devices # 推奨(recommended)されたドライバをインストール # RTX 50シリーズ等の最新GPUでは推奨版が変わるため、適宜番号を選択 sudo apt install nvidia-driver-[番号] # 再起動後に正常動作を確認 sudo reboot nvidia-smi

再起動後、ターミナルで nvidia-smi を叩き、画面に「RTX 5080(または4080)」の文字が出たら第1章クリアです。

この時点で、あなたのデスクトップはすでに“ロボット研究所”へと昇華されています。

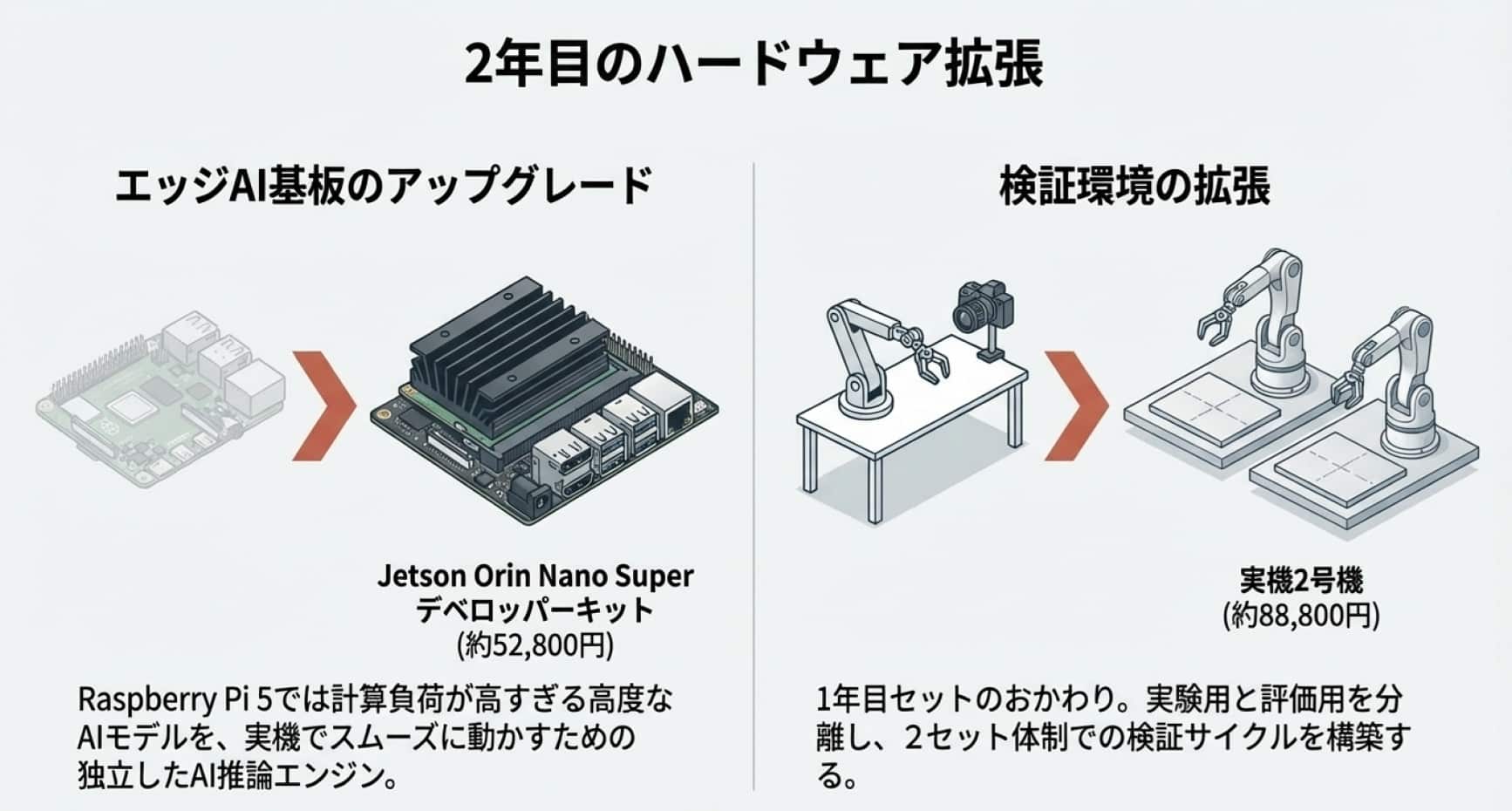

4. 将来の拡張オプション|Jetson・Isaac Lab・Sim2Realに進む前に知っておくこと

ここから先は、今日すぐ手を出す必要はないものの、準備が整ったあとに見えてくる拡張領域です。

この記事のゴールはあくまで、SO-101を安全に動かせる実機構成と、Ubuntu+Isaac Sim / Isaac Labが安定して動く学習基盤という「土台」を固めることです。Jetson Orinや2セット体制、Domain Randomizationなどは、その土台ができたあとに順番に検討する次のステップとして紹介しています。

1. この章の位置づけ

準備編を終えたあとに見えてくる次の拡張先が、Jetsonによる推論強化や、Isaac Labを活用したSim2Real実装です。

本章では、その将来像だけを簡潔に整理します。

SO-101による初期環境が安定して初めて、シミュレーションによる並列学習や、Sim-to-Real Gapの補正といった本格的なテーマに進めます。

したがって、ここは「今すぐ全部やる章」ではなく、「今後の発展先を見通す章」として読んでください。

- Sim2Real Transfer:シミュレーションで学習したモデルを実機に転送します。

- 成功率目標:微調整後の実機成功率85%を目指します。

2. 将来の拡張候補

| カテゴリ | 製品名・内容 | 価格 (目安) | 役割・機能 |

|---|---|---|---|

| 実機2号機 | 1年目セットのおかわり | ¥88,800 前後 | 2セット体制(評価用・実験用)での検証用。 |

| エッジAI基板 | Jetson Orin Nano Super デベロッパーキット | ¥52,800 前後 | (推奨)為替や販売代理店により変動あり(2025–26年時点の目安価格) |

Jetson Orin Nano Superは、Raspberry Pi 5に代わる「より強力なAI推論エンジン」です。

ラズパイに接続するパーツではなく、それ単体でOSを動かしロボットを制御する独立したコンピュータ(SBC)です。

ラズパイでは計算負荷が高すぎる高度なAIモデルを、実機でスムーズに動かすためのアップグレード先として導入します。

3. 今後の発展イメージ:仮想世界での「猛特訓」

現実では数年かかる試行回数を、NVIDIA Isaac Sim上の物理世界でわずか数時間に圧縮して学習させます。

❶ デジタルツインの構築

現実のSO-101と全く同じ重さ・摩擦・形状を持つ「分身」をシミュレータ内に作成します。

実機のCAD/URDFデータを、まず Isaac Sim側のシーン(物理世界) にインポートし、現実に限りなく近づけます。

この「物理的に正しい3Dモデル」の再現こそが、Sim2Real成功の最初の、そして最大のハードルとなります。

❷ Domain Randomization(領域ランダム化)

シミュレーション内のテクスチャや照明、摩擦係数をランダムに変化させます。

これにより、現実世界の「多少の汚れ」や「環境光の変化」に動じない、汎化性能の高い頑健な知能を育てます。

❸ 仮想での並列学習

現実では1回ずつしかできない練習を、シミュレータ内で数千台同時に、24時間休まず実行します。

これにより、どんな場所にコップがあっても掴める「一般常識」をAIに身につけさせます。

❹ Fine-tuning(微調整)の手順と「魂の転送」

の4ステップ.jpg)

シミュレーションですでに「基本」を学んでいるAIを、現実世界のルールに合わせ込むFine-tuningが必要です。

Fine-tuning(微調整)の4ステップ

- ベースモデル作成:Isaac Labで仮想の練習を行い、「コップの掴み方」を学んだモデル(base_model.pth)を作ります。

- 現実データ収集:実機のSO-101で、50回〜100回程度の完璧なお手本を教示します。これだけで数万コマの学習用データが手に入ります。

- 微調整の実行:ベースモデルの「目(画像認識)」の部分は固定し、「筋肉(出力)」に近い層だけを現実のデータで上書きします。

- 実機デプロイ:完成した知能を自宅のRaspberry Pi 5にデプロイし、現実のノイズに対応させます。

4. シミュレーション環境(Isaac Sim / Isaac Lab)の構築手順

Omniverse Launcherは2025年10月1日に正式に廃止され、今後はNGCコンテナやpip経由のIsaac Simパッケージなど、よりオープンな開発ルートが公式に推奨されています。

そのため本記事では、Launcherに依存せず、標準的なPython開発環境(pipインストール)だけでIsaac Sim / Isaac Labを構築する流れに統一しています。

- Python 3.11仮想環境の作成:まずPython 3.11で仮想環境を作成し、有効化します。

- Isaac Simの導入:Isaac Lab公式ドキュメントの「pip installation」セクションを開き、そこに記載されているIsaac Simのバージョンとコマンドをそのまま使用してください。

本記事執筆時点では、公式手順はpip install "isaacsim[all,extscache]==5.1.0" --extra-index-url https://pypi.nvidia.comを案内しています。

ただし、将来の更新に備え、実行前に必ず公式ドキュメントを確認してください。 - Isaac Labのクローンとビルド:

git clone https://github.com/isaac-sim/IsaacLab.git cd IsaacLab ./isaaclab.sh --install

- 実機モデルの統合:Isaac Simに取り込んだURDF設定をIsaac Labの学習ループ(RL/IL)に紐付けます。

5. 成功のためのフィードバックサイクル

- 月次の「失敗分析」:初期フェーズは実機の物理的ズレ、拡張フェーズでは「なぜシミュレーションと現実が違うのか」という Sim-to-Real Gap をデータに基づいて言語化します。

- ドキュメント駆動開発:「THE PACKAGE(引き継ぎ資料)」は常に最新の状態を保ってください。プロセスを透明化し、ノウハウを資産化します。

まとめ:AIロボット制作は「準備の質」で決まる

AIロボット制作では、学習アルゴリズムだけでなく、その前段階である環境整備が成否を大きく左右します。

安全に使える実機、安定した電源、再現性のある固定方法、そしてGPUを活かせるUbuntu環境が揃って初めて、次の学習工程に進めます。

まずは機材を揃え、PCとUbuntu環境を整えましょう。

準備ができたら、次は学びの連載ハブでBehavior CloningやSim2Realの実践へ進みます。

📚 次に読む記事

専門用語まとめ

- Sim2Real(シム・トゥ・リアル)

- シミュレーションで学習させたAIモデルを、現実世界のロボットに転送して動作させる技術。データ収集コストを劇的に下げることが可能。

- Isaac Sim(アイザック・シム)

- NVIDIAの物理・描画の土台となるシミュレータ本体。物理的に正しい3D世界を構築するために使用する。

- Isaac Lab(アイザック・ラボ)

- Isaac Sim上で動作する、ロボット学習用フレームワーク。シミュレータ上で効率的な学習を実行するためのエンジン。

- URDF(ユー・アール・ディー・エフ)

- ロボットの形状や物理特性を記述するXML形式。CADデータをシミュレータに読み込ませる際の共通言語となる。

- Sim-to-Real Gap(シム・トゥ・リアル・ギャップ)

- シミュレーション内の物理挙動と現実の挙動との間に生じる「わずかな差」。これを埋めることが最大の難関となる。

- Fine-tuning(微調整)

- シミュレーションで得た一般解に対し、現実の少量のデータを用いて最適化を施し、特定の環境に適応させる作業。

よくある質問(FAQ)

Q1.

最小構成のPCでもSim2Realの学習は可能ですか?

A1.

可能です。ただし、シミュレーション内の並列数が制限されるため、推奨構成に比べて数倍の学習時間を要します。

- VRAM 12GB程度あれば、Isaac Lab自体は起動します。

- 複雑なタスクになるほど、推奨構成(VRAM 16GB以上)との効率差が顕著になります。

関連:学習基盤の要求スペックへ

Q2.

学習データを集めるために、手で1000回も動かす必要がありますか?

A2.

いいえ。Fine-tuningであれば、50〜100回程度の高品質なお手本(約1時間の作業)で十分です。

- 1回の動作(5秒)で、約100コマ(20fpsの場合)の画像データが自動生成されます。

- 合計で数万コマのデータポイントになるため、AIの仕上げには十分な量となります。

Q3.

XIAO RP2040というマイコンは別途購入しなくて良いのですか?

A3.

はい。本記事で扱うSO-101(SO-ARM101)キットは、同梱の基板でPC接続が完結するため別途購入は不要です。

- 旧世代モデル(SO-100)で必要だったパーツですが、現行機では構成が刷新されています。

- ただし、キット内にXIAO向けアダプタが含まれる場合があるため、同梱物は必ず確認してください。

Q4.

Isaac SimとIsaac Labの違いは何ですか?

A4.

Isaac Simがシミュレータ本体、Isaac Labがその上でポリシーを回す学習用エンジンです。

- Isaac Simで「物理的に正しい3D世界」を定義します。

- Isaac Labを使ってロボットの「知能(ポリシー)」を学習させます。

関連:用語集へ

Q5.

公式手順にあるOmniverse Launcherが見つかりません。

A5.

Omniverse Launcherは2025年10月に廃止されました。最新のpip導入ルートを使用してください。

- 2025年10月以降、Launcher経由のインストールはサポートされていません。

- 本記事のセクション4に最新の導入コマンドを記載しています。

関連:参考サイト・出典へ

参考サイト・出典(本プロジェクト推進のバイブル)

📚 合わせて読みたい

- AIロボット制作プロジェクト 正式キックオフ:実行計画の全容:この準備編が、プロジェクト全体のどこに位置づくのかを確認する

- ロボットアームSO-101でわかるPhysical AI|Behavior CloningからSim2Realまで:Behavior CloningやSim2Realの設計原理を学ぶ

- AIロボットは「世界をどう見て」「どう学ぶ」のか?|Cosmos・Omniverse・Isaac Sim入門:Isaac SimやOmniverseの役割を理解する

- 次世代身体性AIロボットの開発と制御:LLMが拓く脳と反射神経【2026年版】:身体性AIロボット全体の実装思想を広くつかむ

- Physical AI 2026:ロボット産業の覇権を決める「双方向ループ」と4レイヤーの勝ち筋:Sim↔Realループを産業視点で俯瞰する

更新履歴

- 2026年3月5日:初版公開(10万円からのSim2Real完全実装ロードマップ)

- 2026年3月6日:PCスペックの「最小・推奨」比較、ハイブリッド開発戦略、Fine-tuning 4ステップを詳細追記。

以上

-640x360.jpg)