※本記事は継続的に最新情報へアップデートしています。

生成AIロボット革命:フィジカルAIは「真のパートナー」へ進化する

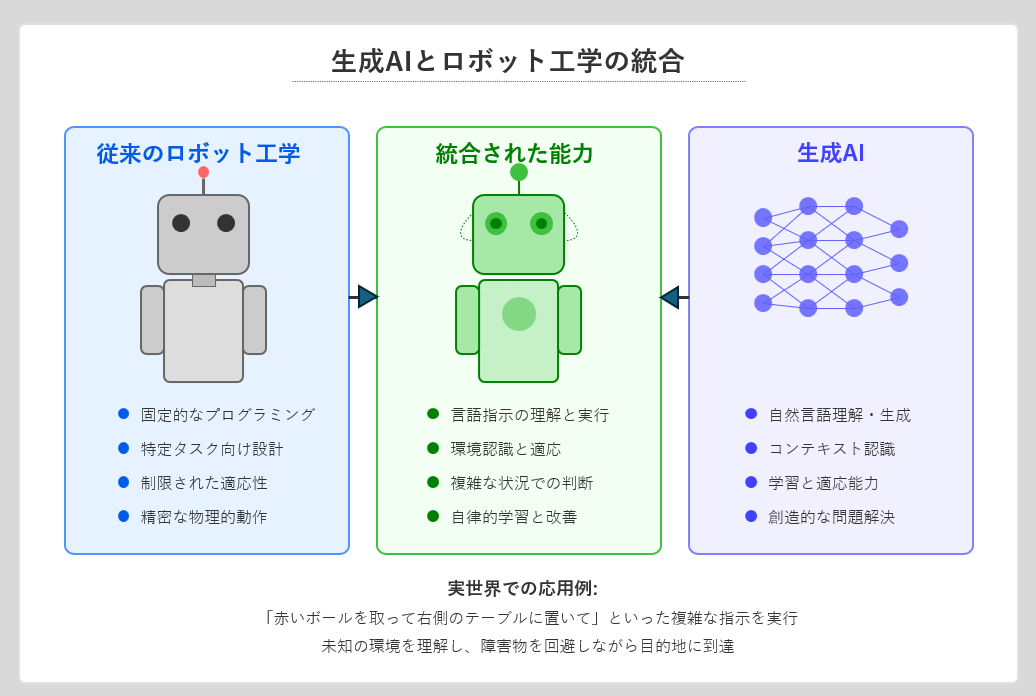

これまでのロボットは、決められた動作を正確に繰り返すことは得意でも、状況を見て判断し、柔軟に振る舞うことは苦手でした。ところが生成AIの登場によって、ロボットは「命令を理解し、周囲の状況を読み取り、適切な行動を選ぶ」方向へ進化し始めています。この記事では、生成AIがロボットをどう変えたのか、その本質を技術と事例の両面から整理します。

✅ この記事の結論

- 最大の変化:生成AIにより、ロボットは固定動作の自動機械から、状況理解と推論を伴う存在へ進化し始めています。

- 技術の中核:RT-2やCosmosのように、言語・視覚・行動を結びつける基盤モデルが転換点になっています。

- この記事の役割:本記事は入口として全体像をつかむための橋渡し記事であり、技術体系や実装深掘りは関連記事で補完します。

生成AIがロボットにもたらす「知性の革命」

生成AIがもたらした最大の変化は、ロボットが固定手順をこなすだけの存在から、状況を理解して行動を選ぶ存在へ近づいたことです。

生成AIは、ロボットに「状況を理解し、未知の課題を解決する能力」を与えます。これは、プログラムされた動きを繰り返すだけの機械から、自律的に思考・行動する「真のパートナー」への質的な大転換です。

従来の産業用ロボットは、決められた動作を高速かつ正確に繰り返すことに長けていました。しかし、それは裏を返せば「指示されたことしかできない」ということ。少しでも環境が変わったり、予期せぬ事態が起きたりすると、途端に機能不全に陥ります。しかし、生成AI、特に大規模言語モデル(LLM)や視覚言語モデル(VLM)の登場が、この前提を根底から覆しました。ロボットは今や、人間の言葉を理解し、目で見たものを解釈し、自ら「考えて」動く能力を手に入れようとしているのです。

「料理」に例えると違いは明確です。従来のロボットは「塩を3g入れ、10回混ぜる」という詳細なレシピ通りにしか動けません。一方、生成AIロボットは「冷蔵庫にあるもので、何か健康的なものを作って」という曖昧なリクエストに応えられます。冷蔵庫の中身を見て(視覚)、メニューを考案し(思考)、調理を実行する(行動)。これが「知性の革命」です。

フィジカルAI全体の潮流を俯瞰したい方はフィジカルAI元年2026:AIが現実世界を動かし始める、ロボットを支える基盤技術を体系的に押さえたい方はAI×ロボット革命:3つの核心技術と未来展望もあわせてご覧ください。

革命の心臓部 – GoogleとNVIDIAの最新技術

生成AIロボットの転換点は、言語・視覚・行動を分断せずにつなぐ基盤モデルが現れたことです。

この革命は、Googleの「RT-2」やNVIDIAの「Cosmos」といった具体的な技術によって牽引されています。これらのモデルが、どのようにしてロボットに知性を与えているのか、その仕組みの核心に迫ります。

Google DeepMind RT-2:Webの知識で世界を動かす

Google DeepMindが開発したRT-2(Robotic Transformer 2)は、「Web上の膨大な知識を使って、現実世界のタスクをこなす」という壮大な問いへの答えです。このモデルの核心は、Web上のテキストと画像を学習した「視覚言語行動(VLA)モデル」にあります。これにより、ロボットは「見る」「話す」そして「行動する」を一つのモデルで繋げられるようになりました。RT-2の真価は、一度も教えられていないタスクさえ実行できる「ゼロショット学習」能力にあります。「ゴミを拾って」という抽象的な指示で、AIが「ゴミ」という概念を理解し、空き缶を認識してゴミ箱へ捨てる動作を自律的に生成した事例は、ロボットが「推論」を始めたことを示す象徴的な成果です。

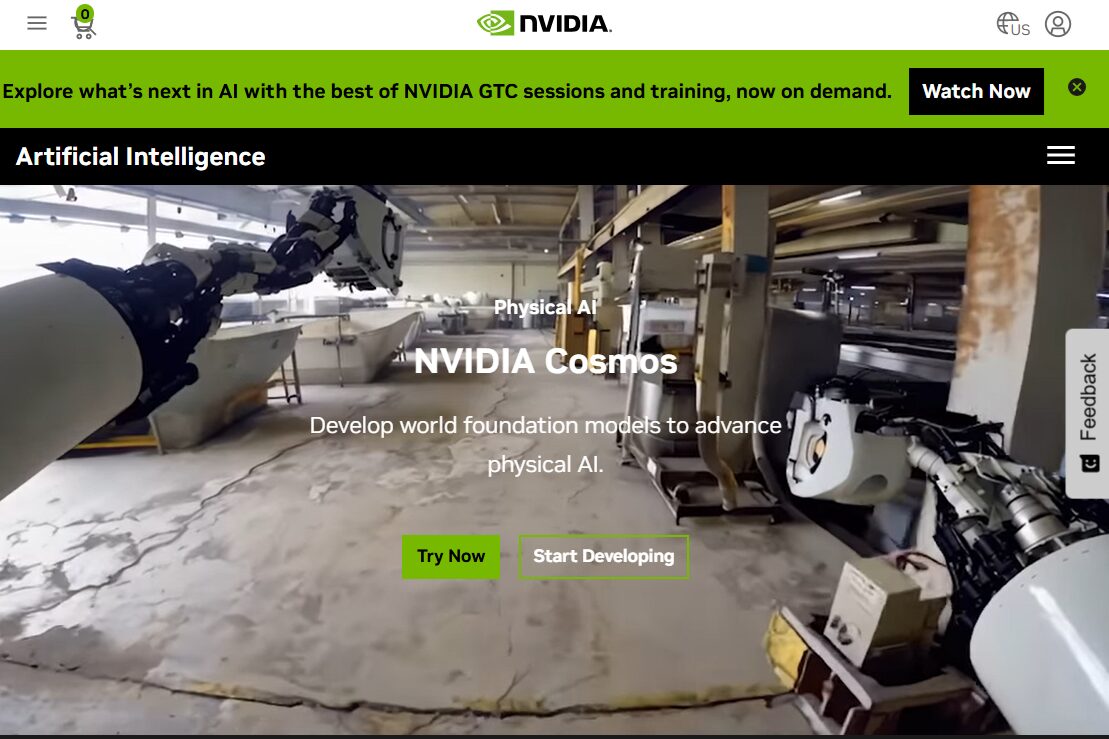

NVIDIA Cosmos:ロボットのための汎用基盤モデル

NVIDIAが提唱する「Cosmos」は、「ロボット版ChatGPT」とも言える、多様なロボットに適用可能な汎用基盤モデルです。特定のロボットやタスクに依存せず、言語指示と物理的な操作を結びつける汎用的な「脳」を提供することを目指しています。例えば「この部品をワークステーションに運んで」という指示に対し、Cosmosは視覚情報から対象物を識別し、安全な経路を計画し、適切な把持方法を判断して実行します。NVIDIAの強みであるシミュレーション技術(Isaac Simなど)と連携し、仮想空間で膨大な訓練を積むことで、現実世界での適応能力を高めている点が特徴です。

ここで押さえておきたいのは3点です。 生成AIロボット研究の最前線は、単一タスクの自動化から、あらゆるタスクに応用可能な「汎用知能」の開発へとシフトしています。GoogleはWebの知識、NVIDIAはシミュレーションと、各社のアプローチは異なりますが、「言語・視覚・行動」の統合というゴールは共通しています。さらに、こうした基盤モデルの登場により、企業はロボットごとにAIを開発する手間から解放され、AIの導入が加速する可能性があります。

こうした「言語・視覚・行動」を統合するロボット知能を、実際の制御アーキテクチャとしてどう組み上げるかは、次世代身体性AIロボットの開発と制御:LLMが拓く脳と反射神経の概要で詳しく解説しています。

フィジカルAIロボットの初級サンプルコード解説

この章の目的は実装そのものではなく、「自然言語の指示がどのように行動計画へ変わるか」をイメージとして掴むことです。

本章では、フィジカルAIの動作原理を簡単なPython風コードで解説します。このコードは実際のロボットを動かすものではなく、フィジカルAIの基本的な考え方を示す概念モデルです。

class PhysicalAIRobot:

def __init__(self, name):

self.name = name

self.knowledge_base = {

"objects": {

"bottle": {"position": (5, 1), "properties": ["recyclable"]},

},

"locations": {

"recycle_bin": [(8, 8)],

}

}

def process_command(self, command_text):

"""自然言語コマンドを処理し実行可能なアクションに変換"""

# 実際はLLMが担当する複雑な自然言語理解

intent = self._understand_intent(command_text)

# 意図に基づいたアクションプランの生成

action_plan = self._generate_action_plan(intent)

# アクションプランの実行

return self._execute_action_plan(action_plan)

def _understand_intent(self, text):

# 簡易的な意図理解

if "bottle" in text and "recycle" in text:

return {"task": "recycle", "object": "bottle"}

return None

def _generate_action_plan(self, intent):

if not intent:

return None

# "ボトルをリサイクルして"という指示から生成されるアクションプラン例

return {

"steps": [

{"action": "move_to", "target": "bottle"},

{"action": "pick_up", "object": "bottle"},

{"action": "move_to", "target": "recycle_bin"},

{"action": "place", "object": "bottle"},

{"action": "report_success", "message": "ボトルをリサイクルしました"}

]

}

def _execute_action_plan(self, plan):

if not plan:

return "指示を理解できませんでした。"

for step in plan['steps']:

print(f"実行中: {step['action']}, 対象: {step.get('target') or step.get('object')}")

return plan['steps'][-1]['message']

# 実行例

robot = PhysicalAIRobot("Assistant")

result = robot.process_command("ボトルをリサイクルして")

print(result)

このコードは、ロボットが「ボトルをリサイクルして」という自然言語の指示を受け、それを「ボトルの場所へ移動 → 掴む → ゴミ箱へ移動 → 置く」という具体的な行動計画に分解し、実行する流れを模擬しています。実際のフィジカルAIでは、この各ステップがより高度な認識・判断技術によって支えられています。

シミュレーションで学習して現実世界へ橋渡しする考え方を深掘りしたい場合は、Physical AIの核心はなぜsim-real loopにあるのかや、AIロボット×デジタルツイン:学習する現実世界フィードバックループも参考になります。

ビジネスはどう変わる?- 次世代の自動化が拓く3つの領域

生成AIロボットの価値は、単なる省人化ではなく、変化に強い自動化を実現できることです。

生成AIロボットの登場は、ビジネスの現場を根底から変えます。「製造」「物流」「サービス」の3つの領域で、具体的にどのような変革が起こり、どのような新しい価値が生まれるのかを予測します。

製造業:変種変量生産への完全対応

従来は困難だった少量多品種の生産ライン(変種変量生産)において、生成AIロボットは絶大な効果を発揮します。製品ごとにプログラムを書き換える「ティーチング」作業が不要になり、新しい製品の設計図を読み込ませるだけで、ロボットが自ら組み立て手順を理解し、作業を開始します。これにより、マスカスタマイゼーションが現実的なコストで実現可能になります。

物流業:予測不能な事態に動じない倉庫

物流倉庫では、日々さまざまな形状や大きさの荷物が扱われます。生成AIロボットは、荷崩れやイレギュラーな形状の荷物といった予測不能な事態に直面しても、状況を判断して最適なピッキングや梱包方法を自ら編み出します。これにより、倉庫全体の自動化率が飛躍的に向上し、人手不足の解消とリードタイムの短縮に貢献します。

サービス業:人間に寄り添うパーソナルアシスタント

最も大きな変革が期待されるのがサービス業です。高齢者介護施設での食事や移動の介助、店舗での複雑な問い合わせ対応や商品提案など、状況に応じた細やかなコミュニケーションと物理的な作業が求められる場面で、生成AIロボットは「人間に寄り添う」アシスタントとして活躍します。人間とロボットの協働が、新たなサービス価値を生み出すでしょう。

すでにどのようなロボットが現実の市場で存在感を高めているのかを知りたい場合は、フィジカルAIのビジネス最前線:常識を覆す最新ロボット5選を併読すると、導入イメージがつかみやすくなります。

将来展望:フィジカルAIの進化ロードマップ

本記事では、将来展望を「入口としての見取り図」までに留め、より広いフィジカルAI全体像は総論記事へ接続します。

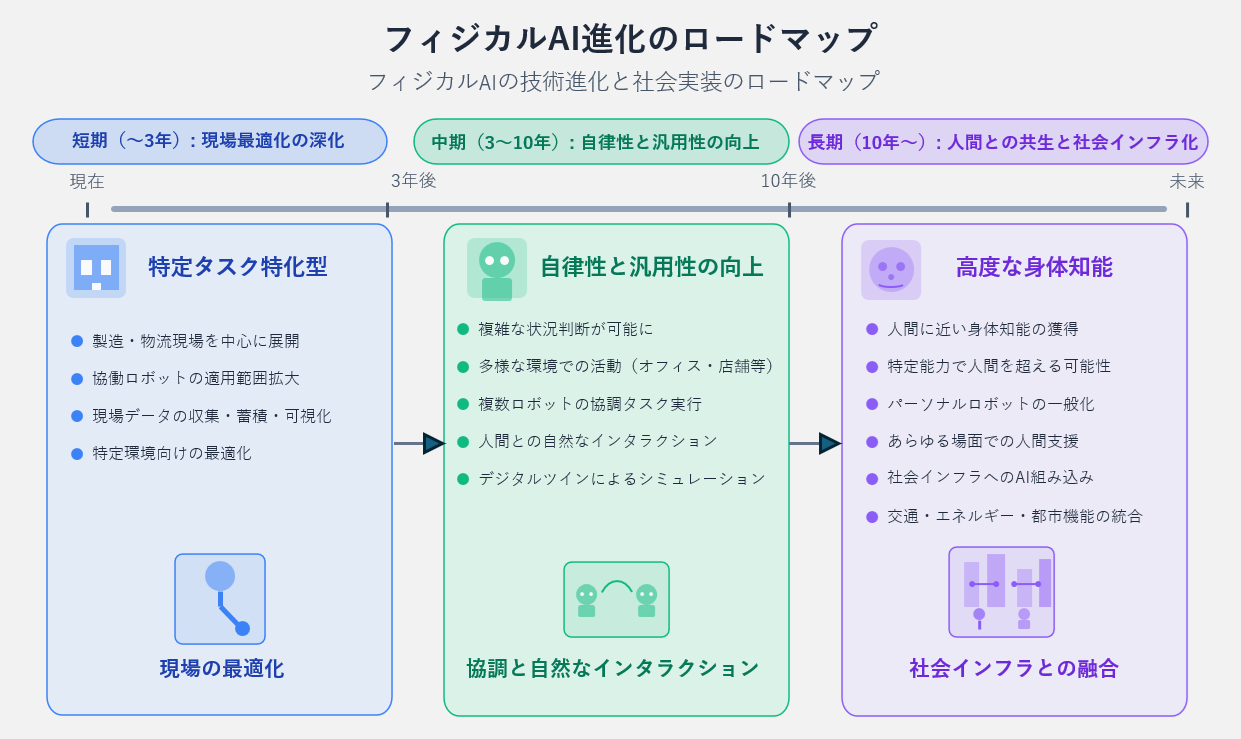

本章では、フィジカルAIが描く未来の進化図を短期〜長期で展望します。技術の進化と社会実装は段階的に進んでいくと考えられます。

- 短期(~3年): 現場最適化の深化

現在は、製造・物流といった特定の産業現場を中心に、特定タスク特化型のAI・ロボット導入が進むフェーズです。協働ロボットの適用範囲も広がります。ここでは、現場データの収集・蓄積・可視化による「現場の最適化」が主要テーマとなります。 - 中期(3~10年): 自律性と汎用性の向上

次のフェーズでは、AIの自律性と汎用性が向上し、より複雑な状況判断や多様な環境(オフィス、店舗、屋外等)での活動が可能になります。複数のロボットが協調してタスクを実行し、人間との自然なインタラクションも進化するでしょう。 - 長期(10年~): 人間との共生と社会インフラ化

長期的には、人間に近い、あるいは特定の能力で人間を超える身体知能を持つAIロボットが登場する可能性があります。あらゆる場面で人間を支援するパーソナルロボットが普及し、交通や都市機能といった社会インフラそのものにAIが組み込まれていく未来が想定されます。

まとめ

本記事の役割は、生成AIによってロボットがどう変わったのかを理解する入口になることです。

生成AIとロボットの融合は、単なる作業の効率化ではありません。それは、機械を「プログラムされた通りに動く道具」から、「自ら考え、未知の課題を解決するパートナー」へと進化させる知性の革命です。GoogleやNVIDIAが示す最前線では、汎用的な知能をロボットに与える研究が加速しており、その波は製造・物流・サービスといったあらゆるビジネスの現場に押し寄せています。

本記事は入口として全体像を整理する橋渡しページです。フィジカルAI全体の地図を見たい方はフィジカルAI元年2026:AIが現実世界を動かし始めるへ、コア技術を体系的に学びたい方はAI×ロボット革命:3つの核心技術と未来展望へ、実装と制御を深掘りしたい方は次世代身体性AIロボットの開発と制御:LLMが拓く脳と反射神経の概要へ進んでください。

専門用語まとめ

- VLA (視覚言語行動) モデル

- 視覚情報(Vision)と言語(Language)を統合し、ロボットの行動(Action)を生成するAIモデル。GoogleのRT-2が代表例です。

- 基盤モデル (Foundation Model)

- 大規模データで事前学習された、多様なタスクに適応可能な汎用AIモデル。ロボットの「脳」として機能し、個別のタスクごとにAI開発する手間を省きます。

- ゼロショット学習 (Zero-shot Learning)

- AIが一度も直接学習したことのない、全く新しいタスクや概念に推論して対応できる能力です。汎用知能の重要な指標とされます。

- ティーチング (Teaching)

- 産業用ロボットに特定の動作を教え込むプログラミング作業のことです。専門知識が必要で、生産ライン変更時の大きなコスト要因となります。

- フィジカルAI

- AIが物理世界を認識し、推論し、実際に行動へ移す領域の総称です。ロボット、デジタルツイン、自律機械などを含む広い概念として使われます。

よくある質問(FAQ)

Q1.

生成AIロボットと、従来の産業用ロボットの最大の違いは何ですか?

A1.

最大の違いは、自律的な判断能力と適応性です。

- 従来のロボットは事前にプログラムされた動作を繰り返すのが中心です。

- フィジカルAIは言語や映像から状況を理解し、未知のタスクにも推論を働かせて対応できます。

Q2.

フィジカルAIはすぐに家庭で使えるようになりますか?

A2.

すぐには難しいでしょう。まずは工場や物流倉庫など、管理された環境から実用化が進みます。

- 家庭のような複雑で予測不可能な環境に対応するには、安全性やコストなど、まだ解決すべき課題が多く残っています。

- 専門家は5年〜10年スパンでの普及を予測しています。

Q3.

フィジカルAIを学ぶには何から始めればいいですか?

A3.

まず、基本的なプログラミング(特にPython)と、機械学習・ディープラーニングの基礎知識を習得することをお勧めします。

- その後、ロボット工学の入門(運動学や制御工学)や、画像認識、自然言語処理(NLP)といった専門分野へ進むのが一般的な学習パスです。

Q4.

RT-2とは何ですか?

A4.

RT-2は、視覚・言語・行動を統合してロボットの動作を生成するGoogle DeepMindのVLAモデルです。

- Web上の知識を現実世界のタスクへ転用できる点が特徴です。

- ゼロショットで未学習タスクに対応できることが象徴的な成果です。

Q5.

NVIDIA Cosmosは何を目指しているのですか?

A5.

Cosmosは、多様なロボットに適用できる汎用的な「脳」を提供することを目指しています。

- 特定ロボット専用ではなく、言語指示と物理操作をつなぐ共通基盤として設計されています。

- シミュレーション基盤と組み合わせることで現実適応力を高めます。

参考サイト・出典

一次情報

- Google DeepMind – RT-2: New model translates vision and language into action

- NVIDIA Blogs – Generative AI for Robotics: Language Models for Robot Control

二次情報

あわせて読みたい

更新履歴

- 2025年4月14日:記事を公開。

- 2025年7月22日:情報アップデート、専門用語、FAQ等のセクションを追加。

- 2026年3月14日:最新版テンプレ v10.2.1 に調整、記事の役割を橋渡し型スポーク記事として再整理、内部リンクとFAQを更新。