※本記事は継続的に最新情報へアップデートしています。

AI Evalsとは?生成AIを本番投入する前に必要な評価設計の全体像【2026年版】

2025年、企業はAIをつなぎ始めました。 MCPでツールと結び、A2Aでエージェント同士を連携させ、ガードレールやゼロトラストで暴走を防ぐ。ここまでは、AIを業務の中に「参加」させるための整備です。けれど2026年、問いは次の段階へ進みます。そのAIは、毎日の本番業務で、本当に任せられるのか。そこで主役に浮上してきたのが、AI Evals(イーバルズ)です。OpenAIとAnthropicが示すように、Evalsとは面白いAIを見つけるための仕組みではなく、任せられるAIを選び、育てるための仕組みです。

✅ 先に結論

- ポイント1:AI Evalsとは、生成AIの品質を再現可能な方法で測る仕組みです。

- ポイント2:2026年は「つなぐ」「守る」の次に、「本番投入できるかを測る」ことが競争力になります。

- ポイント3:正答率だけでは足りません。業務成功率、誤実行、安全性、再現性、コストまで含めて見る必要があります。

何が変わったのか

変わったのはモデル性能だけではありません。AIを本番に出す前に「測る」工程そのものが主役になり始めたのです。

ここ数年、企業はAIをつなぐことに注力してきました。A2Aとは?MCPとの違いで接続の前提を整理し、2026年、AIエージェント「実装元年」へで実装と統制の全体像を描き、さらにAIエージェントセキュリティやAIエージェントのゼロトラスト設計で安全性を担保する流れが進んできました。

しかし、接続できることと、任せてよいことは別問題です。OpenAIは evals を、見た目にはよく動くデモと、毎日頼れる本番システムの差を埋めるための仕組みとして説明しています。Anthropicも、eval を「AIシステムに入力を与え、その出力に grading logic(採点ロジック)を適用して成功を測るテスト」と定義しています。つまり2026年に入って起きているのは、単なるモデル競争ではなく、「AIをどう測るか」が製品力そのものになりつつある変化です。

変化の起点

変化の起点は、AIが「答えるだけ」の存在から、「ツールを呼び、複数ステップを進め、時に長時間タスクをまたいで動く」存在へ変わったことです。回答の見た目が自然でも、途中で誤ったツールを使ったり、確認が必要な場面で勝手に進めたりするなら、本番では危険です。ここで必要になるのが、最終回答だけでなく途中の判断や行動も含めて評価する設計です。

従来との違い

従来のソフトウェアテストは、同じ入力に対して同じ出力が返ることを前提にしやすいものでした。ところが生成AIは、同じ問いでも表現が揺れ、推論経路も一定ではありません。だからこそ、固定的な期待値テストだけでは足りません。OpenAIは評価のベストプラクティスとして、目的の明確化、データセットの整備、指標の定義、比較実行の反復を重視しています。Evalsは、従来のテストを置き換えるものではなく、生成AIの不確実さを扱うために追加で必要になった品質管理レイヤーです。

「つなぐ」「守る」の次に、なぜ「測る」が来るのか

ここで重要なのは、AI導入の難しさが「動くかどうか」から「任せてよいかどうか」へ移っていることです。MCPやA2Aで接続が整っても、ガードレールや権限制御を入れても、それだけで本番品質が保証されるわけではありません。現場で本当に問われるのは、そのAIが、どの条件下で、どの程度の精度と安全性で働くのかを説明できるかです。

たとえば営業要約AIなら、文章が自然かどうかだけでは足りません。重要な論点を落としていないか、誤った次アクションを提案していないか、長い商談ログでも一貫性を保てるか、レビュー工数は本当に下がるのかまで見なければなりません。問い合わせ分類AIなら、分類精度だけでなく、誤分類した場合の業務影響や、再分類にかかる人手コストまで含めて判断すべきです。

つまり、AI導入の主戦場は「賢いモデルを選ぶこと」から、「その賢さをどこまで信じてよいかを、継続的に証明すること」へ移っています。ここにEvalsの本質があります。測ることは、単なる品質確認ではなく、AIに仕事を委ねるための信頼のインフラなのです。

この背景をより広い実装の流れで捉えたい場合は、LLMOps完全ガイドも合わせて読むと、測ることと運用することの関係がつかみやすくなります。

なぜ今重要なのか

重要なのは、その新しさゆえではありません。つないだAIを本当に業務に乗せるための最後の関門であることが、その理由です。

企業がいま直面している問いは、「AIが賢いかどうか」ではなく、そのAIをどこまで任せてよいかを説明できるかどうかです。

事業への影響

PoCでは盛り上がった。デモでは通った。けれど本番に入れると、誤判定、誤実行、ツール呼び出しミス、長いやり取りによる応答の崩れ、想定外のコスト増が一気に噴き出す。この構図は、多くのAI導入で共通して見られます。Evalsが重要なのは、こうした失敗を「運が悪かった」で終わらせず、再現可能な改善対象へ変換できるからです。

開発への影響

開発現場でも、最終回答だけ見ていては品質がわからない場面が増えています。OpenAIは agent workflows の評価ガイドを公開し、エージェント評価を独立した実践領域として整理しています。Anthropicも、AI agents 向け evals では harness と model を一体で見る必要があると説明しています。つまり開発の主戦場は、モデル選定だけではなく、データセット、grader(グレーダー)、eval harness をどう設計するかに移っています。

運用への影響

本番運用に入ると、評価は一度やって終わりではありません。OpenAIが production flywheel として整理しているように、本番で見つかった失敗を新しい評価ケースへ戻し続ける必要があります。ここで Evals は、LLMOps / LLM Observability と直結します。測ることと見続けることは概念として区別しつつも、実運用では循環させなければ意味がありません。

制度やガバナンスの観点は、Agentic AIの暴走とAIガバナンス、組織設計の観点は「Agentic AI」時代の全社OS化と組織設計の教科書も合わせて読むと全体像がつかみやすくなります。

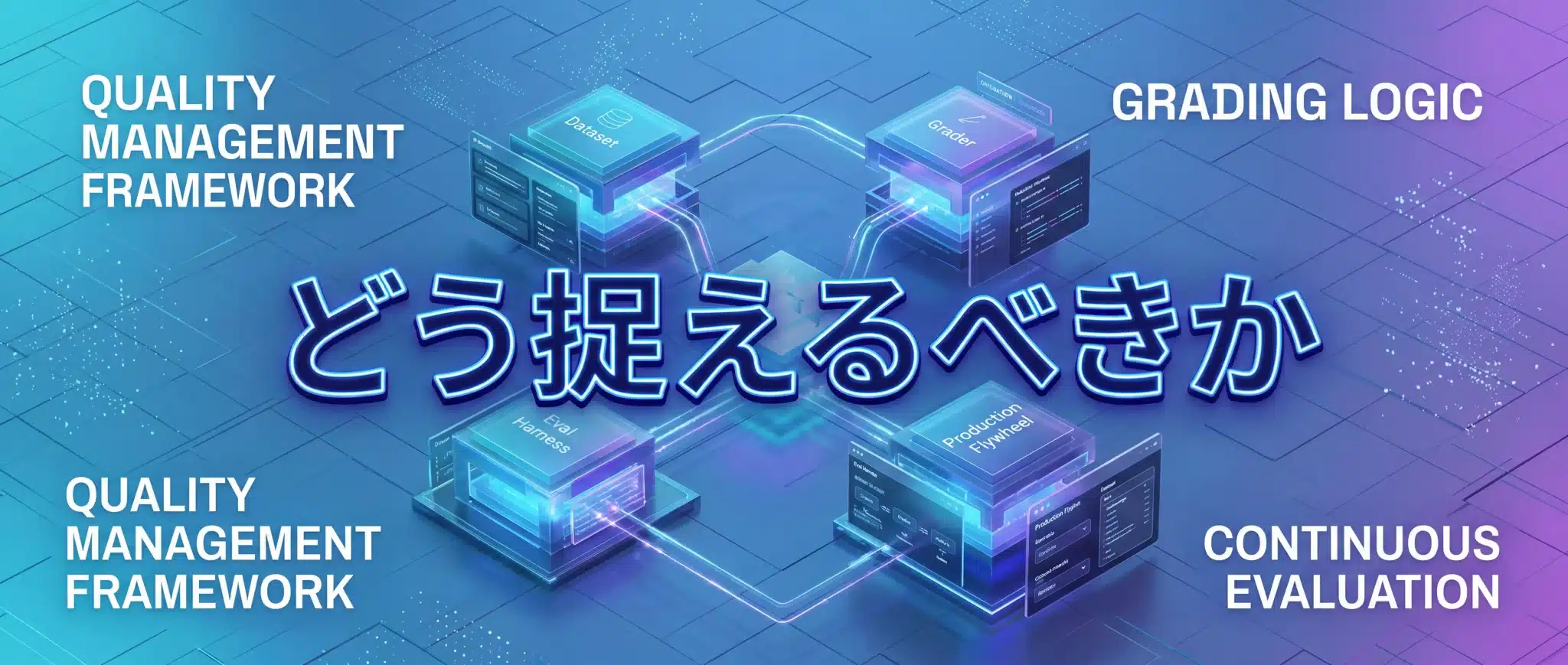

どう捉えるべきか

注目すべきはベンチマークの点数ではありません。AIの不確実さを運用可能な品質管理へ変えられるかどうかです。

Evalsを単なる採点と捉えると、本質を見誤ります。重要なのは「面白いAI」を探すことではなく、「任せられるAI」を育てることです。

本質的な見方

Anthropicの定義を借りれば、eval は「入力を与え、grading logic(採点ロジック)で成功を測るテスト」です。ここでいう本質は、感覚評価をやめて、採点ロジックを明示することにあります。FAQ応答なら正答性と出典一致率、営業支援なら次アクション提案の妥当性、エージェントならツール呼び出しの適切さや停止判断の妥当さなど、成功条件を先に言語化し、その後にAIを測るのがEvalsです。

何を評価すべきか

ここでありがちな誤解は、「正答率だけ見ればよい」という発想です。実務では、それだけでは足りません。見るべきなのは、少なくとも次の5つです。

- 業務成功率:そのAIは、与えられた仕事を最後まで完遂できたか。

- 誤実行の少なさ:誤ったツール実行や不要なアクションを起こしていないか。

- 安全性:確認が必要な場面で止まれるか、権限外の操作を試みないか。

- 再現性:同じ条件で、同程度の品質を保てるか。

- コストと遅延:精度が高くても、遅すぎる、あるいは高すぎるなら業務に乗らない。

たとえばRAGなら、検索結果が妥当か、回答が参照文書に忠実か、ユーザーの問いにちゃんと答えているか、というふうに評価軸を分けて考える必要があります。ここで押さえるべきなのは、RAGもEvalsの代表ユースケースのひとつだということです。詳細な指標やRAGASの議論は、RAG完全ガイドやRAGチャンキング最適化と評価へ譲るとして、Evals記事では「なぜ評価が必要か」「何を評価すべきか」の全体像を押さえることが重要です。

また、エージェント文脈では、回答がもっともらしく見えても、誤ったツールを実行したり、確認が必要な場面で勝手に進めたりするなら本番投入に耐えません。評価とは、正しさの確認であると同時に、危ない失敗をどう減らすかの設計でもあります。

限界と注意点

Evalsは万能ではありません。データセットが現実を映していなければ、採点がどれだけ精密でも意味は薄れます。grader(グレーダー)の設計が偏っていれば、改善は誤った方向へ進むかもしれません。また、RAGやAgentic RAGでは「検索」と「回答」を分けて考えなければ評価を誤ります。つまり、Evalsは導入すれば終わりの仕組みではなく、「評価そのものを設計する力」が問われる領域です。

| 要素 | 役割 | 具体例 | 実務上の注意点 |

|---|---|---|---|

| Dataset | AIに解かせる代表問題集 | FAQ、商談要約、RAG検索ケース | ベンチマーク用ではなく、自社業務を映したケースにする |

| Grader | 出力をどう採点するか | コード判定、モデル判定、人手評価 | 採点ロジックが曖昧だと改善も曖昧になる |

| Eval Harness | 評価を繰り返し回す実行基盤 | タスク並行実行、全ステップ記録、採点、結果集約 | 「前より良くなった気がする」で終わらせない |

| Production Flywheel | 本番の失敗を評価へ戻す循環 | 本番で発生した誤実行や失敗ケースを分析→定量化→評価データセットへ追加し、プロンプト改善を繰り返す | 本番ログからの学習を止めると評価が形骸化する |

| ※ 出典:OpenAI Realtime Eval Guide、Anthropic Demystifying evals for AI agents(2026年4月時点) | |||

実務ではどう判断するか

導入価値、運用現実、組織適合性で見るべきです。

Evalsを導入するかどうかは、理想論ではなく、どの業務で失敗コストが高いかを逆算することで判断しやすくなります。

判断基準

判断軸はこの3つです。費用対効果、運用負荷、既存システムとの整合性です。高精度でも評価運用が回らないなら定着しませんし、安くても危ない失敗を減らせないなら本番投入は危険です。

向いているケース

問い合わせ分類、社内ナレッジ検索、営業要約、RAG応答、エージェントによる定型ワークフローなど、成功条件を比較的定義しやすい業務から始めるのが現実的です。特に本番導入後の誤りコストが高い業務では、Evalsの価値が見えやすくなります。

向いていないケース

何をもって成功とするかを言語化できない状態で、いきなり全社展開するのは危険です。また、現場ログが取れない、ユースケースが広すぎる、責任分界が曖昧といった場合も、Evalsを回しても改善サイクルに乗りにくいです。

よくある失敗

失敗パターンは「正答率だけで安心してしまうこと」です。 実務では、もっともらしい誤回答よりも、誤ったツール実行や確認抜けのほうが深刻です。コストも見落とされやすく、評価なしで本番投入すると想定外のAPI呼び出しコストが静かに膨らむケースも多いです。また、RAGで retrieval と generation を分けずに評価したり、本番ログをデータセットに戻さなかったりすると、評価はすぐ形骸化します。

Evals導入前のセルフチェック

- そのAIの「成功」を、第三者に説明できる指標(KPI)で言語化できているか?

- 本番でAIが失敗した際、そのケースを「テストデータ」として即座に再利用する体制はあるか?

- 正答率以上に、ツール誤実行や安全性のコストを把握しているか?

実装や評価手法の詳細は、RAG完全ガイド、RAGチャンキング最適化と評価、Agentic RAG、AIエージェントROI完全ガイドでより詳しく整理しています。

一次情報からどこまで言えるか

事実と解釈は分けて書くべきです。

このテーマでは、一次情報がかなり重要です。なぜなら「Evals」という言葉は広く使われる一方で、各社が何をどこまで公式に整理しているかに差があるからです。

一次情報

OpenAIは Realtime Eval Guide で、dataset、graders、eval harness、production flywheel を軸に評価を整理しています。また evaluation best practices では、目的の設定、データ整備、指標定義、比較実行の反復を重視しています。Anthropicは、eval を「grading logic(採点ロジック)を適用して成功を測るテスト」と定義し、特に AI agents では harness と model を一体で評価する必要があると説明しています。

解釈

ここから言えるのは、2026年の競争軸が「モデルそのものの賢さ」だけではなく、賢さを測り続ける運用能力へ移っているということです。Evalsは単なる採点表ではなく、つないだAIを本番品質へ持ち込むための実務基盤です。Arpableとしては、この変化を「つなぐ」「守る」の次に来る「測る」のレイヤーとして捉えるのが自然です。

まとめ

読者が持ち帰るべきなのは情報ではありません。次に何を判断し、どう動くべきかです。

結論を再整理すると、Evalsは派手な機能ではありません。けれど、これを持たないAI導入は、メーターのない車で高速道路へ出るようなものです。見た目には動いていることと、安心して任せられることは違う。その差を埋めるのが評価設計です。2026年の差は、どのモデルを選んだかだけではなく、そのAIを測り続け、改善し続けられるかで開きます。

参考文献 / 出典

一次情報

- OpenAI – Evaluation Best Practices

- OpenAI – Working with Evals(汎用Evals APIガイド)

- OpenAI – Agent Evals Guide

- OpenAI – Realtime Eval Guide(音声・リアルタイムAI向け。production flywheelの設計参照)

- Anthropic – Demystifying evals for AI agents

二次情報

次に読むならこの3本

補足Q&A

Q1.

Evalsとは何ですか?

A1.

AIシステムに入力を与え、その出力を一定の基準で採点して成功を測るテストです。

Q2.

従来のソフトウェアテストと何が違いますか?

A2.

生成AIは出力が揺れるため、固定的な期待値テストだけでは足りません。

Q3.

AIエージェントの評価はなぜ難しいのですか?

A3.

最終回答だけでなく、途中のツール利用、状態変更、停止判断まで見る必要があり、さらに同じ入力でも出力が揺れ、複数の正解経路が存在するため、固定的な期待値テストが通用しないからです。

更新履歴

- 2026年4月28日:初版公開