LLM比較【2026年5月版】ChatGPT・Claude・Gemini・Meta AI・Grokの違いと選び方

主要LLMの違いは、単なる性能差ではなく、推論力、検索連携、料金、業務適性、そしてどの配布チャネルに組み込まれているかで決まります。この記事では、OpenAI・Anthropic・Google・Meta・xAIの最新フラッグシップモデルを、「推論力」「検索・SaaS連携」「料金」「業務への落とし込みやすさ」の4軸で比較し、それぞれの強み、向いている用途、企業や個人がどう選ぶべきかを整理します。

※最終更新:2026年5月。Claude Opus 4.7・GPT-5.5リリース後の動向を反映しています。本記事は一般ユーザーまたは一般企業が利用可能な主要LLMを中心に比較し、Claude Mythos Previewのような招待制研究プレビューは本文末で補足します。

A)LLMの導入判断(価格・基盤・運用):

【2025】企業向けLLMの選び方|価格・導入基盤・運用ガイド

C)LLMの思想と使い分け:

LLMと検索エンジンの未来|思想と使い分け戦略【2025】

この記事の結論:

- 要点1:GPT-5.5(Thinking / Pro)/Gemini 3.1 Pro/Claude Opus 4.7の登場で、知能は「既存アプリの一部機能を肩代わりする局面」へ。特にOpus 4.7は、コーディング・長期タスク・高解像度ビジョンを強化し、人間の代わりに仕事を続ける性能上限をさらに押し上げました。

- 要点2:Gemini 3.1 ProはARC-AGI-2(未知の論理課題への適応力を測る抽象推論ベンチ)で77.1%を記録し、Claude Opus 4.7は1Mトークンコンテキスト(GA)と高解像度ビジョン(最大3.75MP)で大規模資産の解釈を強化、GPT-5.5はTerminal-Bench 2.0で82.7%・SWE-bench Proで58.6%を達成し、エージェントコーディング最前線へ。選定軸は「IQ」から「実務代替力」へシフトしています。

- 要点3:SaaSを「選ぶ」時代から、LLMがSaaSを「部品として指揮する」時代へ。私たちはアプリのUIではなく、指揮者(オーケストレーター)に業務を委ね、再設計する能力が問われています。

📣 2026年4月の主要アップデート:GPT-5.5とClaude Opus 4.7で何が変わったか

2026年4月、OpenAIとAnthropicがそれぞれ主力モデルを刷新しました。この記事はその内容を反映しています。

| 観点 | GPT-5.5(4/23リリース) | Claude Opus 4.7(4/16リリース) |

|---|---|---|

| 前バージョン比の最大の変化 | トークン効率の向上。同タスクをより少ないトークンで完了しながら、レイテンシはGPT-5.4と同等を維持。 | 高解像度ビジョンの正式搭載。最大2,576px(3.75MP)に対応し、従来比で3倍以上の解像度を実現。 |

| コーディング性能 | SWE-bench Pro:58.6%(GPT-5.4の57.7%から向上) Terminal-Bench 2.0:82.7% |

Anthropic社内93タスクベンチでOpus 4.6比+13%。「最も難しいタスク」での改善が顕著。 |

| エージェント能力 | 複数ステップの自律実行が強化。曖昧な指示でも計画→ツール使用→検証までを一貫して実行。 | Task Budgets搭載により、長期エージェントループのトークン予算を「目安」として渡し、モデル側が探索の深さを自律的に調整できる設計になりました(厳密な強制上限ではない点に注意)。Adaptive Thinking(xhigh effortレベル追加)も正式搭載。 |

| 料金 | GPT-5.4より高価格(トークン効率向上で実質コストは抑制) | Opus 4.6と同額(入力$5/出力$25 per Mトークン) |

| 利用可能な環境 | ChatGPT有料プラン・Codex(4/23〜)、API(4/24〜) | Claude全製品・API・AWS Bedrock・Google Vertex AI・Microsoft Foundry(4/16〜) |

※詳細なベンチマーク比較・選び方は以下の比較表および各章を参照してください。

序章:アプリの「UI」からの解放と、背後で進化する「指揮者」

要約:かつての「アプリの機能を使いこなす」時代は終わり、LLMという「知能」が既存SaaSを背後で部品として操る「指揮者」へと進化した物語を解説します。

私たちの日常に、AIは急速に溶け込み始めています。2026年初頭、Mac/Windowsのデスクトップ環境で動き、法務を含む知識労働の具体ユースケースを前面に出したClaude Coworkが現れた瞬間、市場はひとつの事実を突きつけられました。――専門SaaSは、知能という巨大な重力に飲み込まれる「部品」へと姿を変えようとしている、ということです。

知能に語りかけると、AIが背後で複数のアプリやファイルを横断し、チェック・ドラフト作成から実行(承認・連携)までを担う。最後の一押しだけを人間が握る――そんな設計が現実味を帯びてきました。本記事では、この「SaaSの透明化」を加速させる5つの主要な「指揮者」(GPT-5.5, Gemini 3.1 Pro, Claude Opus 4.7, Muse Spark, Grok 4.20)を徹底比較・解剖します。その最前線を理解することは、ビジネスの「指揮権」を誰が握るかを見極める鍵となるでしょう。

主要LLMの比較表

要約:2026年5月時点の主要動向に基づき、5大LLMの推論性能、配布チャネル、SaaS指揮能力を一覧で比較します。

| 項目 | GPT-5.5 (OpenAI) | Gemini 3.1 Pro (Google) | Claude Opus 4.7 (Anthropic) | Muse Spark (Meta) | Grok 4.20 (xAI) |

|---|---|---|---|---|---|

| 開発元 | OpenAI(GPT-5.5でトークン効率と推論性能を同時向上。Codexとのエージェントコーディング統合を強化。GPT-5.4比で同等レイテンシを維持しながら性能を大幅更新) | Google DeepMind(Workspaceとの緊密な連携により、ブラウジング統合と業務導線を強化) | Anthropic(Amazon・Google支援。Opus 4.7でコーディング・ビジョン・長期エージェント能力を強化し、専門業務への浸透を加速) | Meta Superintelligence Labs(Meta AI app / meta.ai を起点に、WhatsApp・Instagram・Facebook・Messenger・AIグラスへ展開) | xAI(Xとの統合により、リアルタイム情報と速報性で差別化) |

| 最新モデル実績 | GPT-5.5(Thinking / Pro):2026/4/23(コードネーム「Spud」。GPT-5.4比でトークン効率が向上しレイテンシは同等を維持。ChatGPT有料プラン・Codexで提供開始、API提供は翌4/24〜) | Gemini 3.1 Pro:2026/2/19(前世代比2倍超の推論性能。順次ロールアウト中) | Claude Opus 4.7:2026/4/16(高解像度ビジョン対応〔最大2,576px/3.75MP〕、1Mトークン(GA)、Task Budgets・Adaptive Thinking搭載。料金はOpus 4.6と同額) | Muse Spark:2026/4/8(Meta AI app / meta.ai で稼働。一般企業が自由にAPI利用できる段階ではなく、APIは選定パートナー向けプライベートプレビュー。ただし、Meta製品群への配布力という観点では主要LLM比較に含める意義が大きい) | Grok 4.20:2026/3/10(xAI公式リリースノートにてGrok 4.20 / Grok 4.20 Multi-agentの提供開始が案内。リアルタイム検索・エージェントツールと結びついた速報性・実行性が強みとされます) |

| 強みの軸 | 総合。推論・事実性・コンピュータ操作を統合し、実務エージェントとしての汎用性が高い。「社内標準エージェントの本命候補」 | 統合。Google Workspaceや検索導線と結びついた業務実装力。「Google環境を使い倒す企業向け」 | 専門。長文理解と専門領域への深い適応力。「長文・専門職ワークの相棒」 | 配布。ネイティブなマルチモーダル推論を巨大なプロダクト面へ載せられること。「日常から自然発生的に浸透する知能」 | 速報。時事性、X連携、リアルタイム情報処理。「時事性・ストリームデータを扱う現場」 |

| コーディング評価(公表値ベース/ベンチマーク種別が異なるため単純な横比較ではなく、各モデルの得意領域を示す参考値) | 58.6% (GPT-5.5のSWE-bench Pro 公表値) 82.7% (Terminal-Bench 2.0 公表値) |

80.6% (Google Model Card公表値) | Opus 4.6比+13% (Anthropic社内93タスクベンチマーク公表値) ※SWE-bench Verified公式値はSystem Card確認後に追記 |

— | — |

| ARC-AGI-2 (抽象推論) | — | 77.1% (未知の論理課題への適応力。Google DeepMind公表) | — | — | — |

| SaaS指揮・代替能力 | 汎用。コマンドライン中心の「コンピュータ操作」ベンチ(Terminal-Bench 2.0で82.7%)を背景に、UIを介さない実行エージェントとして実験導入が進み始めています。 | 統合。Workspaceを自律操作し、既存業務導線の不可視化を狙う。 | 専門。法務等の専門領域プラグインでSaaS機能を肩代わり。 | 接点。Meta AIを通じて日常接点の中へ浸透し、マルチモーダル理解を広く展開。 | 速報。時事×並列エージェントによるリアルタイム情報実行。 |

Metaの最新動向:Muse Sparkをどう見るべきか

2026年4月、MetaはMeta Superintelligence Labsの新しいフラッグシップモデル「Muse Spark」を発表しました。Muse Sparkはまず Meta AI app と meta.ai から提供が始まり、今後 WhatsApp や Instagram、Facebook、Messenger、Ray-Ban Meta AI グラスなど Meta 製品へ順次ロールアウトされる計画が示されています(地域・機能ごとに提供範囲は段階的)。

Metaの強みは、モデル単体の性能だけではありません。数十億人規模の接点を持つ配布チャネルに、マルチモーダル推論を直接載せられる点にあります。そのため、2026年5月時点では、Llama 4単体の性能をどう評価するかよりも、Llama系オープンウェイトとは別に、Meta製品向けへ purpose-built されたMuse Sparkを、Metaがどこまで日常導線へ浸透させるかを見るほうが実務上は重要です。

補足:Claude Mythos Previewはなぜ比較表に入れていないのか

Anthropicは2026年4月、Project Glasswingの一環としてClaude Mythos Previewを公開しました。これは一般向けの通常モデルではなく、脆弱性の発見・悪用に転用しうる高い能力を持つため、防御的サイバーセキュリティ用途に限定された招待制の研究プレビューです。

そのため、本記事のような「今選べる主要LLM比較」には含めていません。位置づけとしては、一般提供モデルの外側にあるフロンティア到達点です。詳細は別記事Claude Mythos PreviewとProject Glasswingで解説しています。

📝 性能指標に関するポリシー

数値は「再現性と比較公平性」を担保するため、出典を明記しています。

各社の公式公表値は、独自の実行基盤(Scaffold)を含んでいる場合があり、同一手順での再測定なしに断定はできません。arpable.comでは、単なる数値よりも、その知能がいかに既存のSaaSや専門業務を「肩代わり可能な精度」まで引き上げたかという実務インパクトを重視します。

※SWE-bench Verifiedはscaffold(エージェント実行基盤)・試行回数・プロンプト条件で結果が変わり得るうえ、2026年時点ではベンチマーク汚染も指摘されています。フロンティアモデルの比較では、SWE-bench ProやOSWorldのような、より新しい評価指標もあわせて見るのが実務上のスタンダードです。

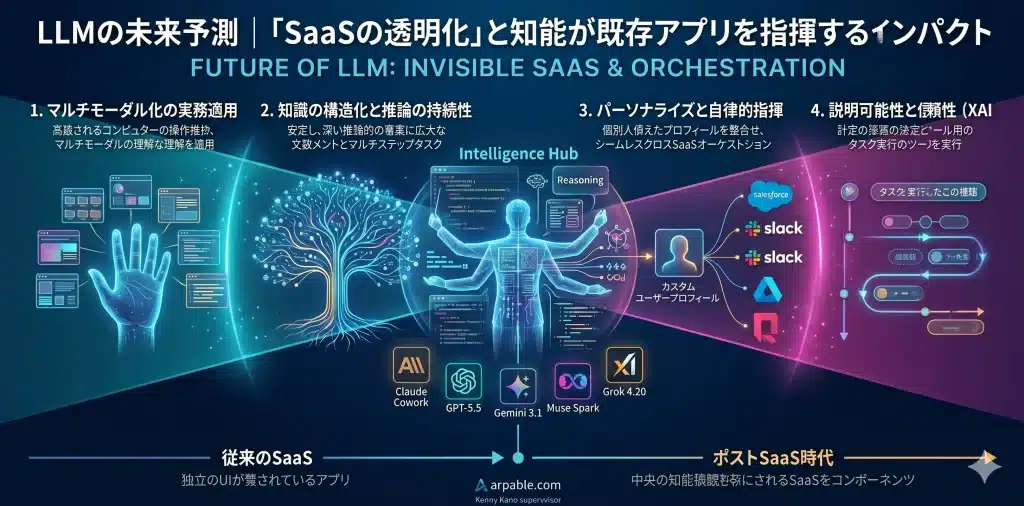

LLMの未来予測|「SaaSの透明化」と知能が既存アプリを指揮するインパクト

要約:「心臓部(基盤モデル)」は推論力と運用効率の両輪で進化し、私たちの「身体(エージェント)」は自動化の範囲と信頼性を拡張します。

AIの「心臓部」は今後どのように進化し、私たちの「身体(エージェント)」をどう変えていくのでしょうか。その本質は、単なる効率化を超えた「SaaSの透明化(Invisible SaaS)」にあります。

進化の方向性

1. マルチモーダル化の実務適用

テキスト×画像×音声×動画を前提に、PC操作・ブラウジング・ツール実行まで一連で扱えるようになった(例:GPT-5.4系とGPT-5.3-Codexの実行エージェント統合)。これにより、人間がアプリのUIを覚える必要性が薄れていきます。

2. 知識の構造化と推論の持続性

長時間・長文にわたる一貫した推論を安定化させる。Claude Opus 4.7は1Mトークンコンテキスト(GA)と高解像度ビジョン(最大3.75MP)を正式搭載し、大規模なコードベースや数百ページ規模の契約書群を扱いながら、業務文脈を崩しにくい設計が可能になりました。

3. パーソナライズと自律的指揮(Orchestration)

個人・組織プロファイルを安全に学習・反映。モデルが自ら複数のSaaSへアクセスし、情報を統合して「実行」まで責任を持つスタイルは、2026年春時点で先進チームから実装が進みつつあります。

4. 説明可能性と信頼性(XAI+評価)

出力根拠の提示に加え、agentic workflow(計画→tool use→実行→検証)全体を対象とした自動評価基盤が統合。reasoning特化モデルは、この「実行プロセスの監査」とセットで導入されます。

進化が拓く可能性:SaaSが「知能の部品」になる日

1. 研究・開発の加速

実験計画立案→文献要約→コード生成→結果解釈までを、LLMが自律的な指揮者として半自動でループ。

2. 専門職SaaSの代替と現実味

2026年初頭、Claude Cowork(デスクトップエージェント)が、法務を含む知識労働の具体ユースケースを前面に出したことで、市場は「専門職SaaSの一部機能までLLMが踏み込める」という現実を突きつけられました。事実、一部のリーガルテック銘柄ではAI関連ニュースに市場が強く反応する場面も見られ、経営者にとって「どこまでをSaaSに、どこからを知能(LLM)に任せるか」というラインの再定義が避けて通れないテーマとなっています。

3. SaaSビジネスモデルの再構築

AIエージェントの浸透は、従来のSaaSが依拠してきた「シート課金」を根本から変え、アプリそのものを「知能の部品」へと再編する可能性を秘めています。この地殻変動の詳細は、以下の記事で詳説しています。

🔗 AIエージェントが引き起こす「シート圧縮」|SaaSビジネスの危機と転換点

🔗 ポストSaaS時代の3つのモデル|AIエージェントがアプリを「部品」に変える未来

4. 教育の個別最適化

学習履歴に基づく出題・解説・口頭試問、学習計画の動的生成を、複数の教育SaaSを裏側で統合しながら実現。

5. 業務のエージェント化

調査→資料作成→社内承認→発注・請求などの「アプリを跨ぐ作業」を、LLMが指揮する一気通貫オートメーションへ。

乗り越えるべき課題

1. バイアスと安全性

AIが自律的にツールを動かす際の責任分界点。出典トレーサビリティと、重要な判断における人間の最終承認(HITL)の制度化。

2. プライバシー・機密

社外送信の最小化、暗号化RAG、あるいはLlama 4等のオープンウェイトを活用したセルフホストの選択。

3. 運用コストとSLA

100万トークンの長文推論に伴うTCO最適化。プロンプトキャッシュや、推論コストの優先順位付けがCxOの新たな課題となります。

4. 評価の標準化

SWE-bench等の外部ベンチに加え、自社KPI(SaaS操作成功率・業務短縮時間)での継続評価。

実装指針(6〜12か月の現実解)

1. 用途分解→モデル割当

生成、要約、コード、分析などを分離し、マルチLLM(指揮者の使い分け)で最適配席(例:長文・専門知能はClaude、エコシステム統合はGemini、コスト・実行力はGPT、データ主権はLlama)。

2. RAGの再設計

検索→要約→検証の二段RAGから、さらに一歩進んだ「自律的アクション(Orchestration)」への移行。

3. ガバナンス

役割ベース権限(RBAC)、機密ラベル検出、監査ログ、人間の最終承認(HITL)をワークフローに標準実装。

4. 評価・運用基盤

自動テスト(ベンチ+自社KPI)、レート制御、費用ダッシュボードによる「知能のポートフォリオ」管理。

AGIへの道筋

LLMは、人間のようにあらゆる知的タスクをこなすAGI(汎用人工知能)という目標に向かいながら、単なる回答者から、既存のソフトウェア世界を自律的に統治する「指揮者」へとその役割を変えつつあります。当面は、強い推論+安全なSaaS指揮能力+評価ガバナンスの三位一体が現実解。この”主導権の交代”をいち早く受け入れ、知能を中心に業務を再定義した企業だけが、次の圧倒的な生産性を手にします。

一文まとめ:知能の進化は、既存SaaSを「AIの部品」へと変える。勝敗を分けるのは、モデル性能ではなく「どの知能に自社の指揮権を委ねるか」という設計力の成否です。

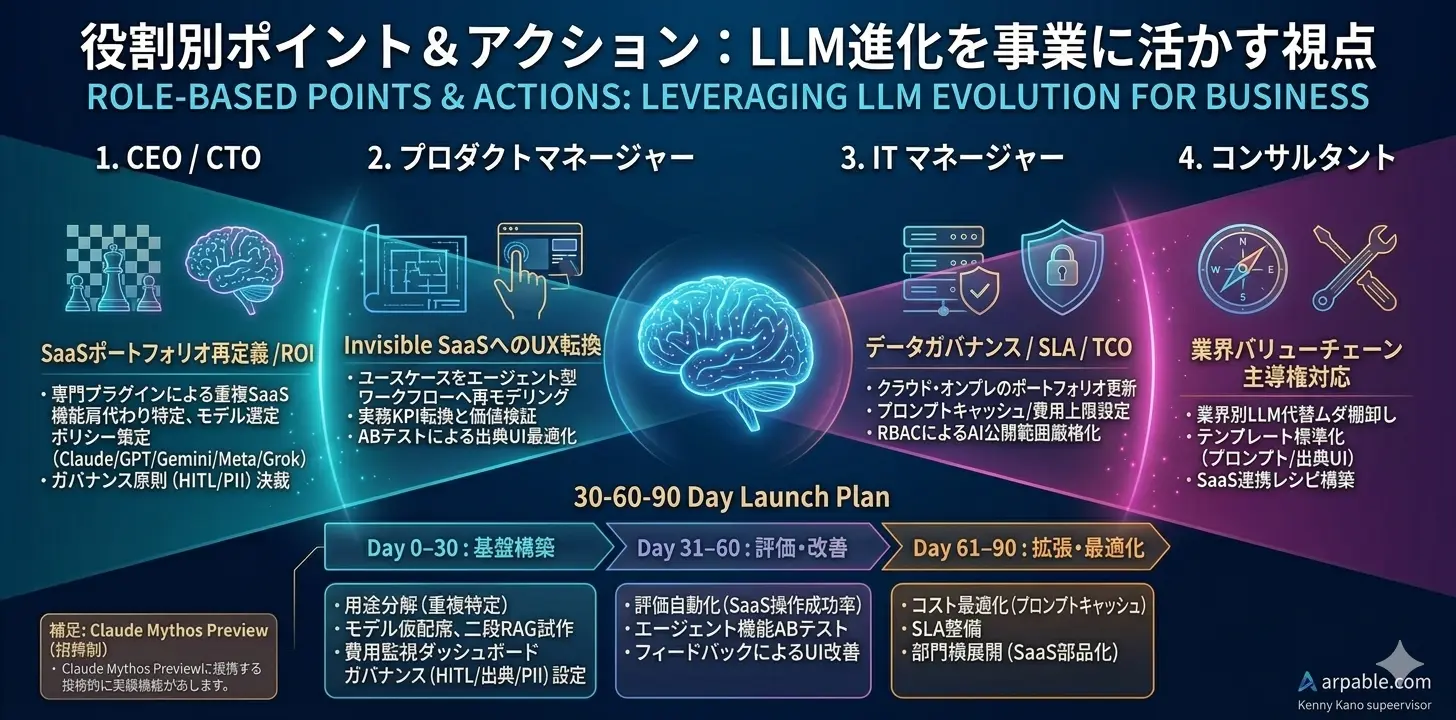

役割別ポイント&アクション:LLM進化を事業に活かす視点

要約:経営者からエンジニアまで、各役割が最新LLM(GPT-5.5 / Claude Opus 4.7 / Gemini 3.1 Pro等)を事業・業務へ落とし込むための具体アクションを提示します。

役割別 LLM活用ポイントとアクション

| 役割 | 注目ポイント | アクション(今すぐできること) |

|---|---|---|

| CEO / CTO | SaaSポートフォリオの再定義/投資対効果(ROI) |

|

| プロダクトマネージャー | 「Invisible SaaS」へのUX転換/価値検証 |

|

| ITマネージャー | データガバナンス/SLAとコスト(TCO) |

|

| コンサルタント | 業界別バリューチェーンの「主導権交代」対応 |

|

| 研究者・エンジニア | 評価の標準化/垂直統合の監視 |

|

30-60-90日 ローンチ計画(全社横断の現実解)

Day 0–30:基盤構築フェーズ

- 用途分解:現在のSaaS利用状況を棚卸し、LLMで代替可能な業務を特定

- モデル仮配席:各業務に最適なLLM(GPT-5.5 / Claude Opus 4.7 / Gemini 3.1 Pro)を割り当て

- 二段RAGの試作:検索→要約→検証のプロトタイプを構築

- 費用ダッシュボード設置:トークン使用量と費用をリアルタイム監視

- ガバナンス設定:HITL(人間による最終承認)、出典必須化、監査ログを実装

Day 31–60:評価・改善フェーズ

- 評価自動化:SaaS操作成功率を測定する仕組みを構築

- エージェント機能のABテスト:複数モデル・プロンプトを比較検証

- ユーザーフィードバックによるUI改善:利用者の声を反映し精度向上

Day 61–90:拡張・最適化フェーズ

- コスト最適化:プロンプトキャッシュ・トークン圧縮の実装

- SLA整備:応答速度・可用性の基準を定義

- 部門横展開:「SaaSの部品化」を加速させる横断展開を推進

測定すべきKPI(2026年基準)

- 品質:正答率、出典一致率、SaaS操作成功率、人間による訂正率。

- 速度:初回応答時間、エンドツーエンドのタスク完了時間。

- コスト:1000トークンあたり費用、エネルギー効率(W/Token)、キャッシュ命中率。

- 採用:MAU/WAU、AIエージェントへの業務委任率、NPS/CSAT。

- 安全:PIIヒット率、ブロック/警告件数、監査ログ網羅率。

リスクと対策(最低限のセーフティネット)

- 幻覚・誤実行: 出典リンク必須/重要判断・実行(決済等)は人間最終承認(HITL)を必須化。

- 市場の変動と依存性: 特定モデルへの過度な依存を避け、Llama 3.3系やDeepSeek系を含むポートフォリオで冗長化。

- データ漏えい: 機密ラベルの自動検出/外部送信禁止ルール/セルフホスト・暗号化RAGの選択。

Key Takeaways(持ち帰りポイント)

- AIの進化は心臓部(基盤モデル)×身体(実行)×神経系(指揮)の共進化として捉える。

- 2026年は「モデルがSaaSの前面から一歩後ろへ回り込み、見えないところで指揮をとり始める」動きが目に見えて加速する年です。

- 勝負を決めるのは、モデル性能の微差ではなく、「どの知能を中核に据えて業務を再設計するか」という意思決定と実装速度です。

参考:導入判断(価格・基盤・運用)は記事A、思想と使い分けは記事C、Claude Mythos Preview / Project Glasswingの詳細は関連記事をご参照ください。

まとめ

本記事では、2026年5月時点の主要動向を反映し、AI進化を支える5つの「指揮者」を解剖しました。Claude Opus 4.7が専門業務への浸透を強め、Gemini 3.1 Proが推論の壁を押し上げ、MetaはMuse Sparkで改めてフロントラインへの参戦を鮮明にしました。OpenAIもまた、GPT-5.5によって推論とエージェントコーディングをさらに統合し、実務エージェントの中核候補として存在感を高めています。こうした各社の動向が示すように、AIの進化はもはや「便利な機能の追加」ではありません。

「業務の主権が、アプリのUIから知能へと移る」という地殻変動は、現在進行形で進んでいます。専門職SaaSは「UIの王国」から、「知能の部品」へと再編されつつあります。この主導権交代の波が本格化する前に、自社の業務フローをどこまで知能中心に再構築するかが、これから数年の競争力を大きく左右するでしょう。

なお、AnthropicのClaude Mythos Previewは、防御的サイバーセキュリティ用途に限定した招待制の研究プレビューであり、一般提供モデルの比較表にそのまま並べるよりも、「比較対象外のフロンティアモデル」として別枠で捉えるのが適切です。

専門用語まとめ

- 大規模言語モデル(LLM)

- AIの「心臓部(基盤モデル)」。2026年には、言葉の生成を超え、OSやSaaSを部品として指揮する知能へと進化。

- Orchestration(指揮・統合)

- LLMが自律的に複数のSaaSやファイルへアクセスし、情報を統合して実行に迫る能力。2026年の最重要指標。

- Invisible SaaS(SaaSの透明化)

- 人間がSaaSのUIを操作する必要がなくなり、LLMの背後でデータソース(部品)として機能する状態。

よくある質問(FAQ)

Q1. Claude Coworkの専門機能は、Windowsユーザーでも使えますか?

Q2. 自社で「指揮者(Orchestrator)」を1つ選ぶとしたら、何から試すべきですか?

Q3. 専門家プラグインは今後主流になりますか?

Q4. ベンチマークの点数はそのまま業務性能に直結する?

参考サイト

- OpenAI|Introducing GPT-5.4

- OpenAI|Why we no longer evaluate SWE-bench Verified

- Meta|Introducing Muse Spark: MSL’s First Model, Purpose-Built to Prioritize People

- Meta AI|Introducing Muse Spark: Scaling Towards Personal Superintelligence

- Anthropic|Project Glasswing

- Anthropic|Claude Opus 4.6 System Card

- Anthropic|Introducing Claude Opus 4.7

- OpenAI|Introducing GPT-5.5

- Google DeepMind|Gemini 3.1 Pro Model Card

- xAI|Grok Models Overview(Grok 4.20)

更新履歴

- 初版公開

- 年末モデル刷新(GPT-5.2/Gemini 3/Claude 4.5)を反映。

- 最新アップデート(当時のGrok 4.2 Beta表記、Claude 4.6 / Gemini 3.1 Pro等)を反映。 「SaaSの部品化と指揮能力」という視点へ全面改訂。

- Meta Muse Spark発表後の動向を反映。 Claude Mythos Preview / Project Glasswingへの補足を追加。

- OpenAIのGPT-5.4 / GPT-5.3-Codex反映。 4月時点の比較指標と文言整合性を更新。

- Claude Opus 4.7(4/16)・GPT-5.5(4/23)リリースを反映。比較表・ベンチマーク値・序章・まとめを更新。

- タイトル・比較条件を2026年5月版に更新。Mythos記事への誘導リンク強化。Grok 4.20日付修正・Muse Spark API限定性明記・コーディング評価キャプション追記・表現精度向上。